LLMOpsとは?意味と使い方をわかりやすく解説

LLMOpsとは。

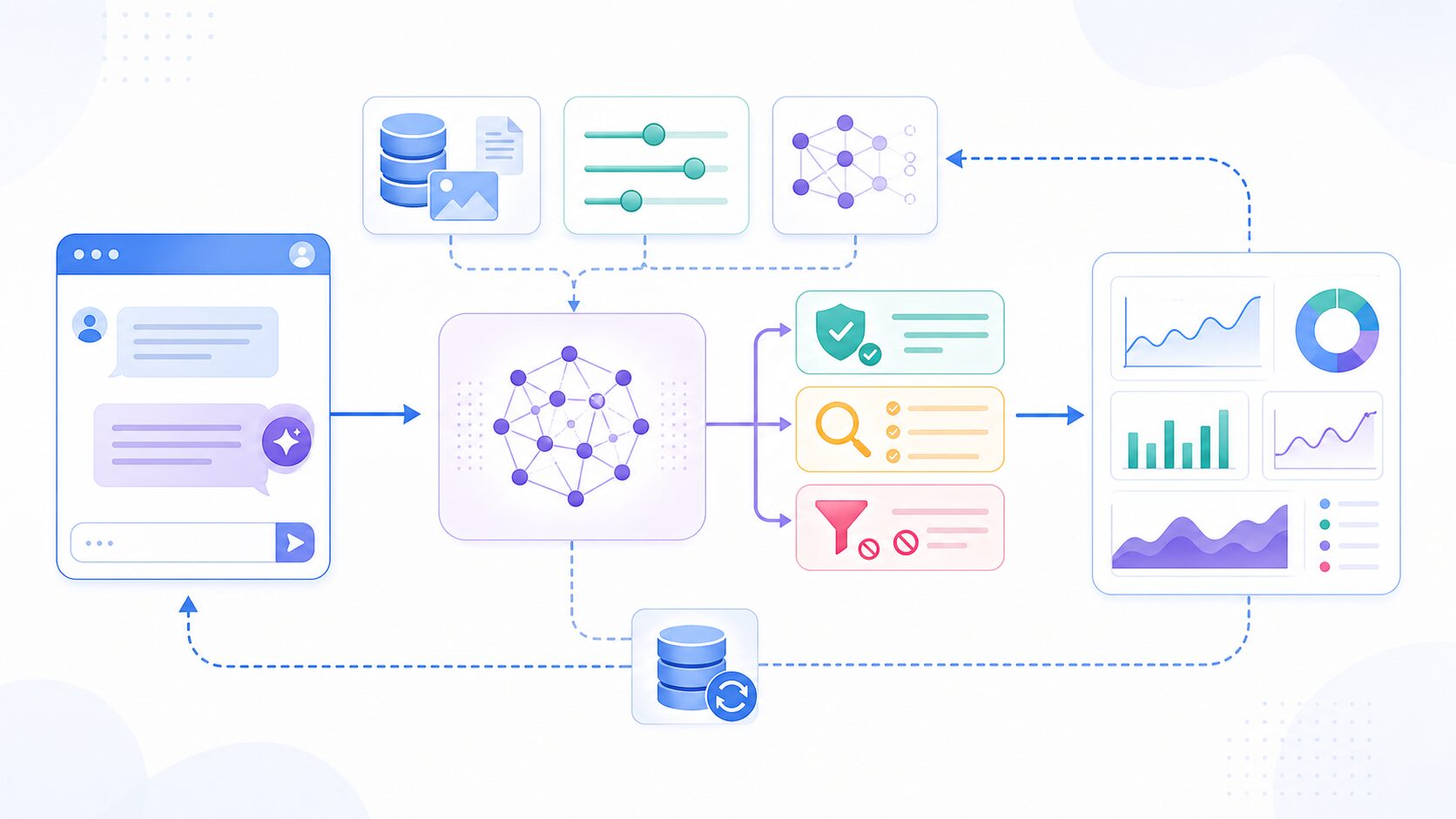

LLMOpsとは、Large Language Model Operationsの略で、大規模言語モデルを使ったAIアプリケーションを継続的に開発、評価、運用、改善するための取り組みを指します。生成AIを業務やサービスに組み込むとき、プロンプト、データ、評価、監視、セキュリティ、コストをまとめて管理する考え方です。

LLMは文章の作成、質問応答、要約、分類、コード生成など幅広い用途に使えます。ただし、公開したAIがいつも正確で安全な回答を返すとは限りません。入力される質問、参照するデータ、モデルの更新、プロンプトの変更によって、出力の内容は変わります。そこで必要になるのがLLMOpsです。

LLMOpsとは何をする考え方か

LLMOpsは、LLMを使ったシステムを「作る工程」だけでなく、「使い続ける工程」まで含めて管理します。たとえば社内FAQボットを作る場合、最初に質問に答えられる状態を作るだけでは不十分です。回答が古くなっていないか、個人情報を出していないか、根拠のない回答をしていないか、利用量が増えて費用が急に上がっていないかを継続して見る必要があります。

このようにLLMOpsでは、プロンプト管理、参照データの管理、回答品質の評価、ログ監視、改善サイクルをひとまとまりで扱います。生成AIを試作品から実用段階へ進めるための運用設計、と考えると理解しやすいでしょう。

LLMOpsが必要になった背景

従来のソフトウェアは、同じ入力に対して同じ処理結果を返す設計が中心でした。一方でLLMは、自然言語を扱うため、質問の言い方や文脈によって回答が変わります。さらに、モデル提供側の更新、利用する社内文書の変更、プロンプトの調整によって、昨日まで良かった回答が今日も同じ品質とは限りません。

たとえば問い合わせ対応にLLMを使う場合、ある日は丁寧で正確な回答をしていても、別の質問では存在しない仕様をもっともらしく答えることがあります。このような誤った生成はハルシネーションと呼ばれます。LLMOpsでは、こうしたリスクを前提に、テスト用の質問集、回答評価、監視ログ、改善手順を用意します。

LLMOpsで行う主な作業

LLMOpsの作業は、LLMアプリケーションのライフサイクルに沿って整理できます。まず、何のためにLLMを使うのかを決め、利用者の質問や業務フローを想定します。次に、モデル選定、プロンプト設計、必要に応じたRAGの構築、評価方法の設計を行います。RAGとは、外部の文書やデータベースを検索し、その情報をLLMの回答に活用する仕組みです。

運用段階では、回答ログ、エラー、利用者のフィードバック、応答時間、API利用料金などを確認します。問題が見つかったら、プロンプトを直す、参照データを更新する、回答ルールを追加する、評価データを増やすといった改善を行います。重要なのは、感覚だけで「良くなった」と判断せず、評価基準を決めて変更前後を比べることです。

| 作業 | 目的 |

|---|---|

| プロンプト管理 | 指示文の変更履歴を残し、回答品質への影響を確認する |

| データ管理 | RAGで参照する文書やナレッジを最新の状態に保つ |

| 評価 | 正確性、安全性、使いやすさをテスト質問で確認する |

| 監視 | 利用状況、エラー、応答時間、コスト、問題回答を把握する |

| 改善 | ログや評価結果をもとにプロンプトやデータを見直す |

MLOpsやDevOpsとの違い

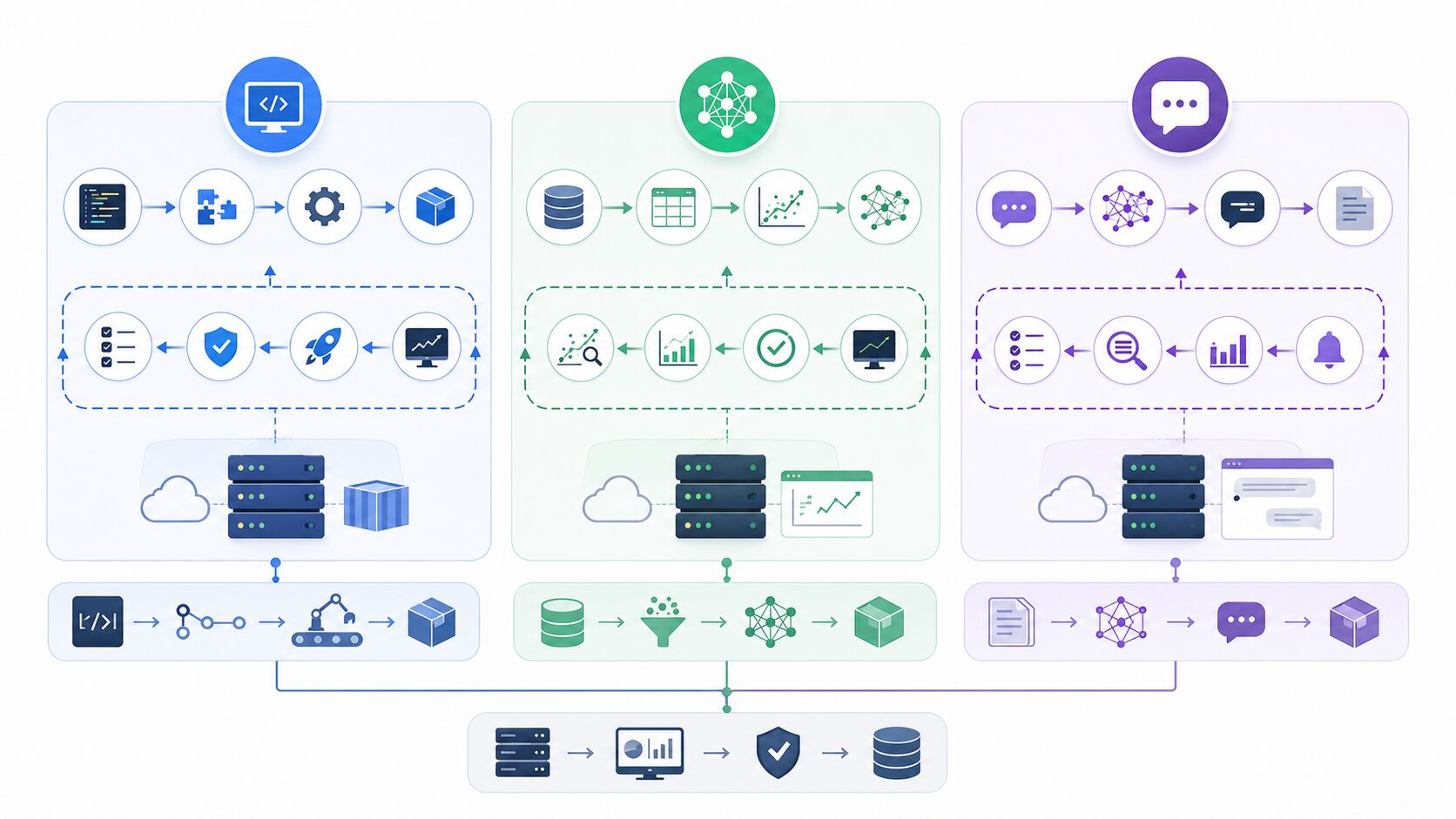

LLMOpsは、MLOpsやDevOpsと関連があります。DevOpsはソフトウェアの開発と運用をつなぎ、継続的に改善する考え方です。MLOpsは機械学習モデルの学習、評価、デプロイ、監視を管理します。LLMOpsはその流れを受け継ぎつつ、LLMアプリケーション特有の課題に焦点を当てます。

LLMでは、モデルそのものを自社で毎回学習するとは限りません。外部APIや既存モデルを使い、プロンプト、参照データ、出力制御、評価方法を工夫する場面が多くなります。そのためLLMOpsでは、モデルの精度だけでなく、回答の根拠、禁止すべき出力、利用者ごとの権限、生成コストなども重要な管理対象になります。

| 用語 | 主な対象 | 重視する点 |

|---|---|---|

| DevOps | ソフトウェア開発と運用 | リリース、監視、改善の効率化 |

| MLOps | 機械学習モデル | 学習データ、モデル評価、再学習、精度監視 |

| LLMOps | LLMを使った生成AIアプリ | プロンプト、RAG、回答評価、安全性、コスト、ログ改善 |

LLMOpsの具体例

身近な例として、社内規程に答えるAIチャットボットを考えてみましょう。最初に社内文書を読み込ませ、質問に答えられるようにします。しかし、規程が更新されたら参照データも更新しなければなりません。古い規程を根拠に回答すると、利用者の判断を誤らせる可能性があります。

また、回答が正しいかを確認するために、「有給休暇の申請方法は?」「経費精算の締切は?」「退職手続きに必要な書類は?」といったテスト質問を用意します。回答が規程に沿っているか、根拠を示しているか、不要な個人情報を出していないかをチェックします。こうした評価と監視を続けることで、AIを安心して業務に使いやすくなります。

初心者が注意したいポイント

LLMOpsを学ぶときは、特定のツール名だけを覚えるよりも、何を管理するための仕組みなのかを理解することが大切です。LLMアプリでは、プロンプトを少し変えただけで回答の雰囲気や正確性が変わることがあります。そのため、変更履歴を残し、変更前後で同じ質問を試し、問題が増えていないか確認する習慣が必要です。

もう一つの注意点は、生成AIの回答をそのまま正解として扱わないことです。業務で使う場合は、参照元の明示、回答できない質問への対応、個人情報や機密情報の扱い、利用者権限の設計が欠かせません。特に初心者は「AIが答えてくれる」ことに注目しがちですが、実務では間違った回答をどう検知し、どう直すかが重要になります。

LLMOpsを学ぶときの順番

初めてLLMOpsを学ぶなら、まずLLMの基本的な仕組みとプロンプトの役割を押さえましょう。次に、RAG、評価、ログ監視、セキュリティ、コスト管理へ進むと理解しやすくなります。いきなり大規模な運用基盤を作ろうとするより、小さなAIチャットや社内文書検索のような題材で、評価と改善の流れを体験するのがおすすめです。

学習では、成功例だけでなく失敗例も重要です。回答が曖昧になった、根拠のない説明をした、古い情報を返した、想定以上に費用が増えた、といった問題をどう見つけるかを考えると、LLMOpsの必要性が実感しやすくなります。

まとめ

LLMOpsとは、LLMを使った生成AIアプリケーションを継続的に運用・改善するための考え方です。プロンプトやRAGを作るだけでなく、回答品質、安全性、コスト、ログ、利用者のフィードバックを見ながら改善していく点に特徴があります。

生成AIは便利ですが、出力が常に正しいとは限りません。だからこそ、LLMOpsによって評価と監視の仕組みを整えることが大切です。初心者はまず、LLMOpsを「LLMを実務で安定して使い続けるための運用管理」と捉えると、関連用語との違いも理解しやすくなります。

更新履歴

| 日付 | 内容 |

|---|---|

| 2026年4月29日 | 初回公開 |