ラッソ回帰:スパースなモデル推定

AIの初心者

先生、「ラッソ回帰」ってよく聞くんですけど、普通の回帰分析と何が違うんですか?

AI専門家

良い質問だね。ラッソ回帰は、たくさんの説明変数の中から、本当に必要な変数だけを選び出すのに役立つ回帰分析の方法なんだ。不要な変数の影響を少なくすることで、予測の精度を上げることができるんだよ。

AIの初心者

へえ、どうやって選び出すんですか?

AI専門家

簡単に言うと、あまり重要でない変数の重みをゼロにしてしまうんだ。重みがゼロになった変数は、実質的に予測に使われなくなるんだよ。このおかげで、よりすっきりとした予測モデルを作ることができるんだ。

ラッソ回帰とは。

人工知能の分野で使われる「ラッソ回帰」という用語について説明します。ラッソ回帰とは、複数の要素が結果にどう影響するかを調べる「重回帰分析」という手法に、ある工夫を加えたものです。その工夫とは「L1正則化」と呼ばれるもので、簡単に言うと、分析の際に、結果への影響の度合いを示す数値(重み)の大きさをなるべく小さくするように調整する、ということです。

もう少し詳しく説明すると、L1正則化では、重みの絶対値の合計(マンハッタン距離とも呼ばれます)を、分析の目的となる関数に加えます。これにより、全体の重みを小さく抑え、特に、他のデータから大きく外れた一部のデータの影響をゼロにすることができます。つまり、本当に重要なデータだけを重視して分析できるようになるのです。これが「スパース性」を高めるという意味です。

ただし、ラッソ回帰には欠点もあります。L1正則化を用いた関数は、滑らかな曲線で表すことができないため、数学的な計算で直接答えを求めることができません。そのため、近似的な解を求めるための工夫が必要となります。

ラッソ回帰とは

{ラッソ回帰とは、統計学や機械学習の分野で、予測のために使われる手法です。}たくさんのデータから、ある値を予測したい時に役立ちます。例えば、家の広さや築年数から家の価格を予測したり、気温や湿度からアイスクリームの売上を予測したりするといった具合です。

ラッソ回帰は、重回帰分析という手法とよく似ています。重回帰分析では、予測したい値に影響を与える要素(説明変数)それぞれに、どれくらい影響力があるかを示す重み付けを行います。しかし、説明変数が多すぎると、重回帰分析では複雑すぎる予測モデルを作ってしまい、学習データにはよく当てはまるのに、新しいデータにはうまく当てはまらないという問題が起こることがあります。これは、まるで試験勉強で過去問だけを完璧に覚えて、新しい問題に対応できないような状態です。このような現象を過学習といいます。

ラッソ回帰は、この過学習を防ぐための工夫がされています。具体的には、重み付けの値をなるべく小さくするように調整します。不要な説明変数の重み付けはゼロに近づき、本当に必要な説明変数だけが残るため、予測モデルをシンプルにすることができます。これは、試験勉強で重要なポイントだけを絞って学習するようなものです。

このように、ラッソ回帰は過学習を防ぎ、新しいデータにも対応できる、汎化性能の高い予測モデルを構築するのに役立ちます。そのため、様々な分野で活用されているのです。

| 手法 | 説明 | メリット | デメリット |

|---|---|---|---|

| ラッソ回帰 | 予測のために使われる手法。重み付けの値を小さくすることで、過学習を防ぐ。 | 過学習を防ぎ、新しいデータにも対応できる汎化性能の高いモデル。 | – |

| 重回帰分析 | 予測したい値に影響を与える要素それぞれに重み付けを行う。 | – | 説明変数が多すぎると過学習を起こしやすい。 |

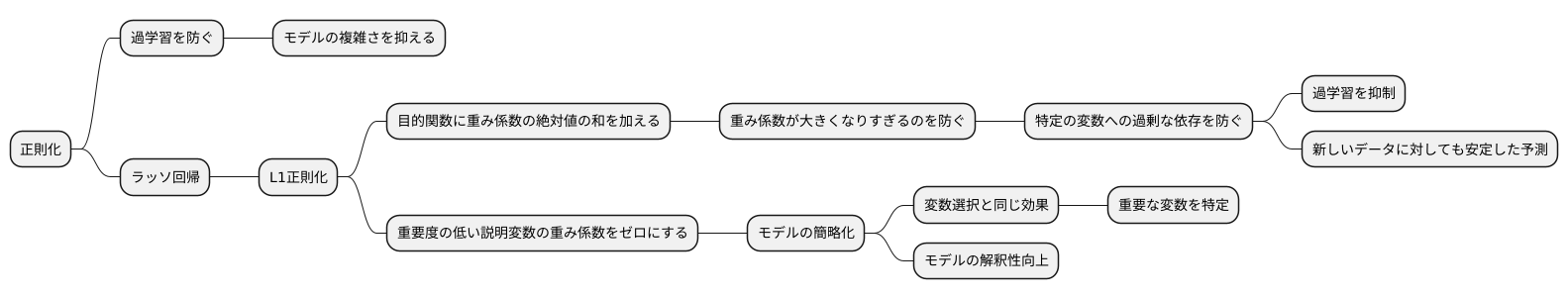

正則化による効果

予測モデルを作る際には、学習データに過剰に適合してしまう過学習という問題に注意する必要があります。過学習が起きると、学習データにはよく当てはまるものの、新しいデータにはうまく予測できないモデルになってしまいます。

この過学習を防ぐための有効な手段の一つが正則化です。正則化は、モデルの複雑さを抑えることで過学習を防ぐ技術です。ラッソ回帰では、L1正則化という手法を用いています。

L1正則化では、目的関数(モデルの予測誤差を表す関数)に、重み係数の絶対値の和を加えます。重み係数とは、それぞれの説明変数が予測にどの程度影響するかを示す数値です。この重み係数の絶対値の和を加えることで、重み係数が大きくなりすぎるのを防ぎます。

重み係数が大きいということは、その説明変数が予測結果に大きな影響を与えていることを意味します。もし、特定の変数の重み係数が不必要に大きくなると、モデルはその変数に過剰に依存してしまい、過学習につながりやすくなります。L1正則化によって重み係数が大きくなりすぎるのを防ぐことで、過学習を抑制し、新しいデータに対しても安定した予測ができるモデルを作ることができます。

さらに、L1正則化には、重要度の低い説明変数の重み係数をゼロにする効果があります。つまり、予測にあまり関係のない変数の影響を排除し、モデルを簡略化することができます。これは、変数を選択するのと同じ効果があり、どの変数が予測に本当に重要なのかを特定するのに役立ちます。モデルが簡略化されることで、解釈性も向上します。たくさんの変数が使われている複雑なモデルよりも、少数の重要な変数だけで作られたシンプルなモデルの方が、理解しやすく、説明しやすいからです。

スパース性とモデルの解釈

多くの説明変数の中から、本当に必要なものだけを選び出す方法のひとつに、ラッソ回帰と呼ばれる手法があります。このラッソ回帰は、予測に役立たない変数の重みをゼロにすることで、簡潔で分かりやすい予測モデルを作り上げます。これは、まるでたくさんの材料の中から、料理に欠かせないものだけを選び出すようなものです。

この、必要なものだけを選び出す性質を「スパース性」と呼びます。スパース性が高いモデルは、重みがゼロの説明変数が多く、まるで必要な材料だけが並んだ整理された調理台のようです。たくさんの説明変数の中から、本当に影響力のある変数だけを選び出すため、モデルの解釈が容易になります。例えば、数百種類の材料の中から、料理の味を決定づける主要な材料だけが分かれば、その料理の特徴を捉えやすくなりますよね。

さらに、スパース性は計算の負担を軽減する効果もあります。ゼロの重みを持つ変数は計算に影響を与えないため、計算量を減らすことができ、結果として計算にかかる時間が短縮されます。これは、たくさんの材料を扱うよりも、厳選された少数の材料で料理する方が、調理時間が短縮されることに似ています。

このように、ラッソ回帰によって得られるスパース性を持つモデルは、解釈のしやすさと計算効率の良さという2つの利点を持っています。そのため、大量のデータや複雑な現象を扱う際に、非常に役立つ手法と言えるでしょう。

| ラッソ回帰の性質 | 説明 | 例え |

|---|---|---|

| スパース性 | 予測に役立たない変数の重みをゼロにすることで、簡潔なモデルを作る。モデルの解釈が容易になり、計算の負担も軽減される。 | たくさんの材料から、料理に本当に必要なものだけを選び出す。 |

| 重みがゼロの説明変数が多い | 本当に影響力のある変数だけを選び出す。 | 必要な材料だけが並んだ整理された調理台。 |

| モデルの解釈が容易 | 影響力のある変数が明確になるため、モデルの理解が容易になる。 | 料理の味を決定づける主要な材料だけが分かる。 |

| 計算の負担を軽減 | ゼロの重みを持つ変数は計算に影響を与えないため、計算量が減り、計算時間が短縮される。 | 厳選された少数の材料で料理する方が、調理時間が短縮される。 |

計算方法の課題

計算式の難しさについて考えてみましょう。よく知られた計算方法である重回帰分析とは違い、ラッソ回帰と呼ばれる計算方法では、式を解いて直接答えを得ることができません。ラッソ回帰は、計算の中で特別な規則(L1ノルム)を用いるのですが、この規則が原因で、単純な計算では答えが出せないのです。 この規則は、いくつかの点で滑らかでないため、微分という方法が使えません。微分は、曲線の傾きを求めることで、最適な値を探す際に役立つ道具ですが、ラッソ回帰ではこの道具が使えないため、別の方法を考える必要があります。

そこで登場するのが、数値計算と呼ばれる方法です。これは、少しずつ答えに近づいていく方法で、何度も計算を繰り返すことで、真の答えに限りなく近い値を求めます。例えるなら、宝探しゲームで、少しずつヒントを頼りに宝に近づいていくようなものです。座標降下法や近接勾配法といった、様々な計算方法がありますが、どれも何度も計算を繰り返す必要があるため、計算に時間がかかってしまうことがあります。特に、扱うデータが膨大な量になると、計算時間は無視できない問題となります。

例えば、たくさんの商品の売れ行きデータから、売上に最も影響を与える要素を見つけ出す際に、ラッソ回帰を使うとします。商品の数が数万点、データが数千万件もある場合、計算に数日かかるかもしれません。そのため、ラッソ回帰を使う際には、計算にかかる時間についてもあらかじめ考えておく必要があります。計算方法の工夫や、計算機の性能向上など、様々な対策を検討することで、効率的に答えを求めることができるでしょう。

| 計算方法 | 特徴 | 問題点 | 解決策 |

|---|---|---|---|

| 重回帰分析 | 直接答えを得られる | – | – |

| ラッソ回帰 | L1ノルムを用いる、微分不可、数値計算が必要 | 計算に時間がかかる(データ量が多いほど顕著) | 計算方法の工夫、計算機の性能向上 |

他の回帰手法との比較

様々な予測手法の中で、回帰手法は数値を予測する際に広く使われています。その中でも、ラッソ回帰は特殊な性質を持つ手法として知られています。ここでは、ラッソ回帰と他の回帰手法を比較し、それぞれの特性や使い分けについて考えてみましょう。

まず、ラッソ回帰とよく似た手法に、リッジ回帰があります。リッジ回帰は、目的関数に正則化項として「L2ノルム」と呼ばれるもの加えます。これは、重み係数(説明変数の影響度合いを示す数値)をそれぞれ二乗して合計したものです。リッジ回帰を使うことで、重み係数の値が大きくなりすぎるのを防ぎ、モデルが複雑になりすぎるのを抑えることができます。つまり、過学習を防ぎ、未知のデータに対しても安定した予測ができるようになります。ただし、リッジ回帰では重み係数は小さくなりますが、ゼロにはなりません。

一方、ラッソ回帰は正則化項に「L1ノルム」を用います。これは、重み係数の絶対値の合計です。ラッソ回帰では、不要な重み係数をゼロにするという特徴があります。そのため、モデルを単純化し、解釈しやすくする効果があります。説明変数が多い場合、ラッソ回帰を用いることで、本当に重要な変数だけを選び出すことができます。これは、データの解釈や計算コストの削減に役立ちます。

さらに、ラッソ回帰とリッジ回帰の両方の利点を組み合わせた手法として、弾性ネットがあります。弾性ネットは、L1ノルムとL2ノルムの両方を正則化項として用います。これにより、リッジ回帰の安定性とラッソ回帰の変数選択能力をバランスよく実現できます。

このように、それぞれの回帰手法には異なる特性があります。予測の精度だけでなく、モデルの解釈のしやすさや計算コストなども考慮しながら、適切な手法を選ぶことが大切です。

| 手法 | 正則化項 | 特徴 | 効果 |

|---|---|---|---|

| リッジ回帰 | L2ノルム (重み係数の二乗和) | 重み係数を小さくする(ただし、ゼロにはならない) | 過学習を防ぎ、未知のデータに対しても安定した予測 |

| ラッソ回帰 | L1ノルム (重み係数の絶対値の和) | 不要な重み係数をゼロにする | モデルの単純化、解釈の容易化、重要な変数の選別 |

| 弾性ネット | L1ノルム + L2ノルム | リッジ回帰とラッソ回帰の利点を組み合わせる | リッジ回帰の安定性とラッソ回帰の変数選択能力の両立 |

様々な応用事例

ラッソ回帰は、多くの分野で活用されている強力な分析手法です。その応用範囲の広さは、様々なデータを扱う多くの業種に渡ります。

まず、医療分野では、ラッソ回帰を用いて病気の診断精度を高める取り組みが行われています。例えば、患者の様々な検査データや症状を入力することで、ラッソ回帰は特定の病気にかかっている確率を予測できます。さらに、ある治療法に対する患者の反応性を予測することも可能です。これにより、より適切な治療方針を立てるのに役立ちます。

次に、金融分野においてもラッソ回帰は重要な役割を果たしています。投資におけるリスク管理では、過去の市場データや経済指標を用いて、将来の市場変動を予測し、リスクを最小限に抑えるための投資戦略を立てるのに役立ちます。また、ポートフォリオ最適化にもラッソ回帰が活用されています。複数の金融商品を組み合わせたポートフォリオにおいて、リスクを抑えつつ、最大の利益を得られるような最適な組み合わせを導き出すことが可能です。

さらに、マーケティング分野では、ラッソ回帰を用いて顧客の行動を分析し、効果的な販売戦略を立てることができます。顧客の購買履歴や属性データから、将来どのような商品に興味を持つのかを予測し、個々の顧客に合わせた商品推薦を行うことが可能です。また、広告の効果測定や最適な広告配信戦略の策定にも役立ちます。

このように、ラッソ回帰は医療、金融、マーケティングといった多様な分野で、予測や最適化といった課題解決に活用され、データに基づいた意思決定を支援する強力な道具となっています。

| 分野 | ラッソ回帰の活用例 |

|---|---|

| 医療 |

|

| 金融 |

|

| マーケティング |

|