決定木の剪定:過学習を防ぐ賢い方法

AIの初心者

先生、「AI」の『剪定』ってどういう意味ですか?木を切るみたいに何かを削るんでしょうか?

AI専門家

良い質問ですね。AIの『剪定』は、まさに木を切るように不要な枝を落とすイメージです。具体的には、決定木と呼ばれる、データを分類するために木のように枝分かれした構造を簡略化する手法です。

AIの初心者

決定木を簡略化するって、どういうことですか?枝を落とすと何か困ることはないんですか?

AI専門家

決定木が複雑すぎると、未知のデータに対してうまく対応できないことがあります。そこで、重要でない枝を落とすことで、新しいデータにも対応できる、つまり汎化性能を高めるんです。もちろん、落とす枝を間違えると精度が下がってしまうので、慎重に行う必要があります。

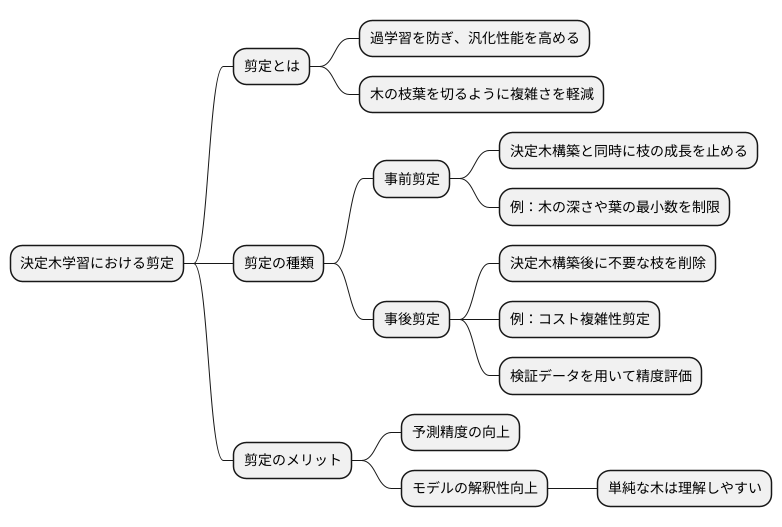

剪定とは。

人工知能の分野で使われる「枝切り」という手法について説明します。枝切りとは、決定木と呼ばれる木の形をしたデータ構造において、木の深さを制限する手法です。木の枝葉のように、あまり結果に影響を与えない部分を取り除くことで、データ全体の傾向をよりよく捉えることができ、新しいデータに対しても正しい結果を出しやすくなります。

剪定とは

木を育てるように、情報を整理して判断するための仕組みを育てることを考えてみましょう。この仕組みを「決定木」と呼びます。決定木は、まるで木の枝のように、様々な条件によってデータを分けていき、最終的に結論を導き出す方法です。たくさんの情報を与えると、決定木は枝分かれを繰り返して複雑になり、与えられた情報を完璧に説明できるようになります。しかし、これは一見良いことのように思えますが、落とし穴があります。

複雑になりすぎた決定木は、特定の情報に特化しすぎてしまい、新しい情報にうまく対応できなくなるのです。例えるなら、特定の気候だけで育った植物は、他の環境ではうまく育たないのと同じです。この状態を「過学習」と呼びます。

そこで登場するのが「剪定」です。庭師が木の不要な枝を切り落とすように、決定木においても、重要でない枝葉を切り落とすことで、過学習を防ぎます。具体的には、データの分割にあまり役立っていない部分や、複雑さを増すだけの部分を削除していきます。

剪定には様々な方法があります。不要な枝を一つずつ切り落としていく方法や、あらかじめ木の大きさを制限する方法など、状況に応じて最適な方法を選ぶ必要があります。剪定を行うことで、決定木はシンプルになり、新しい情報に対しても柔軟に対応できるようになります。つまり、様々な状況で役立つ、汎用性の高い仕組みになるのです。まるで、適切な剪定によって、木がより健やかに育つのと同じように、決定木も剪定によってより良いものへと変わっていくのです。

剪定の種類

木の枝を切り落とす作業、剪定。実はこの剪定にも様々なやり方があります。大きく分けて、木が育つ過程で剪定を行う「事前剪定」と、木がある程度育ってから剪定を行う「事後剪定」の二種類があります。

事前剪定は、例えるなら、木がある程度の高さになったらそれ以上は成長させないように、あらかじめ印をつけておくようなものです。木がまだ小さいうちに、今後の成長を見越して不要な枝を落とすことで、大きく育ちすぎるのを防ぎます。この方法は、木が大きくなってから剪定するよりも手間が省けるという利点があります。剪定にかかる時間や労力が少なく済むため、管理しやすいというわけです。しかし、木がまだ十分に育っていない段階で剪定を行うため、本当に必要な枝まで切り落としてしまう可能性も否定できません。結果として、木の形がいびつになったり、思うように育たなかったりする可能性も考えられます。

一方、事後剪定は、木が十分に成長した後に、不要な枝を剪定する方法です。木全体の形状を見ながら剪定を行うため、不要な枝だけを確実に切り落とすことができます。木の成長を最大限に活かしつつ、美しい形に整えることができるのです。しかし、すでに大きく育った木を剪定するには、多くの時間と労力が必要です。事前剪定に比べて、剪定作業の負担が大きくなってしまうことは避けられません。また、事後剪定の中でも、枝の切り方や残し方には様々な流派があります。木の大きさや形、剪定の目的に合わせて、最適な方法を選ぶ必要があります。例えば、全体の形を整えることを重視する剪定や、不要な枝を徹底的に取り除く剪定など、剪定の目的によって手法も様々です。それぞれの木の状態に合わせて、適切な剪定方法を選択することが重要です。

| 剪定の種類 | 説明 | メリット | デメリット |

|---|---|---|---|

| 事前剪定 | 木が育つ過程で剪定を行う。今後の成長を見越して不要な枝を落とす。 | 手間が省ける。管理しやすい。 | 必要な枝まで切り落としてしまう可能性がある。木の形がいびつになったり、思うように育たなかったりする可能性がある。 |

| 事後剪定 | 木が十分に成長した後に、不要な枝を剪定する。 | 不要な枝だけを確実に切り落とせる。木の成長を最大限に活かしつつ、美しい形に整えることができる。 | 時間と労力がかかる。剪定作業の負担が大きい。 |

剪定の利点

枝切りは、木を健やかに育てるための大切な作業と同じように、学習の模型にとっても良い効果をもたらします。この枝切りに当たるのが「剪定」と呼ばれる作業です。剪定を行うことで、学習の模型はより良いものへと変わっていきます。

まず、剪定は模型の「覚えすぎ」を防ぎます。学習の模型は、与えられた情報から規則性を見つけて覚えます。しかし、あまりに熱心に覚えすぎると、教えられた情報にだけ詳しくなり、新しい情報に対応できなくなってしまいます。これは、まるで特定の問題の解き方だけを暗記して、応用問題が解けないような状態です。剪定はこの「覚えすぎ」、つまり過学習を防ぎ、新しい情報にも対応できる柔軟な模型を作ります。

次に、剪定は模型を分かりやすくします。複雑に枝分かれした木は、全体像を把握するのが難しいのと同じように、複雑な模型は理解しにくく、どのように判断しているのか分かりづらいものです。剪定によって不要な部分を切り落とすことで、模型の構造がすっきりとして、どの情報が重要なのかが分かりやすくなります。これは、模型がなぜそのような結果を出したのかを説明する必要がある際に、特に役立ちます。

このように剪定は、模型の性能を向上させるだけでなく、その仕組みを分かりやすくする効果も持っています。模型をより使いやすく、信頼できるものにするために、剪定は欠かせない作業と言えるでしょう。

| 剪定の効果 | 説明 |

|---|---|

| 過学習の防止 | 教えられた情報にだけ詳しくなり、新しい情報に対応できなくなる「覚えすぎ」を防ぎ、柔軟な模型を作る。 |

| 模型の分かりやすさの向上 | 複雑な模型の構造をすっきりさせ、どの情報が重要なのかを分かりやすくする。 |

| 模型の性能向上と分かりやすさの両立 | 模型を使いやすく、信頼できるものにする。 |

剪定の実施方法

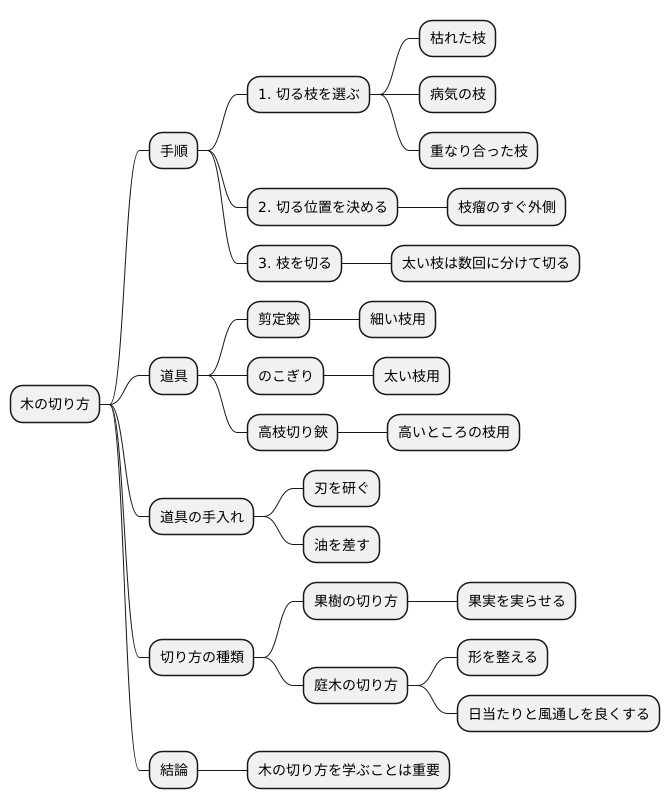

木の切り方は、不要な枝を切る作業のことで、木を健康に育てたり、美しい形に整えたりするのに欠かせません。多くの道具や切り方の種類があり、それらを適切に使うことで、より効果的に作業を進めることができます。

まず、木の切り方の手順ですが、最初に切る枝を選びます。枯れた枝や病気の枝、重なり合った枝など、木にとって良くない影響を与える枝を優先的に切ります。次に、切る位置を決めます。枝の付け根にある、少し膨らんだ部分を「枝瘤」と言いますが、この枝瘤のすぐ外側を切るのが基本です。枝瘤を傷つけると、木が病気になってしまうことがあるので注意が必要です。そして、選んだ枝を、選んだ位置で切ります。太い枝を切る場合は、一気に切ろうとせず、数回に分けて切るのがコツです。

木の切り方には様々な道具が使われます。代表的なものとして、剪定鋏、のこぎり、高枝切り鋏などがあります。剪定鋏は、細い枝を切るのに適しています。のこぎりは、太い枝を切るのに使います。高枝切り鋏は、高いところにある枝を切るのに便利です。これらの道具は、切れ味が悪くなると、木を傷つける原因になります。ですから、道具の手入れは大切です。こまめに刃を研いだり、油を差したりして、常に良い状態を保つようにしましょう。

木の切り方は、木の種類や目的によって様々です。例えば、果樹の切り方は、果実を実らせるための大切な作業です。不要な枝を切ることで、果実に栄養が行き渡りやすくなり、より多くの実を収穫することができます。また、庭木の切り方は、木の形を整えるだけでなく、日当たりや風通しを良くする効果もあります。木の切り方を適切に行うことで、木を健康に保ち、美しい景観を維持することができます。そのため、木の切り方について学ぶことは重要です。

剪定と他の正則化手法との比較

機械学習において、モデルが訓練データに過剰に適合してしまう過学習は、しばしば精度低下の原因となります。この過学習を防ぐために、様々な手法が用いられます。その一つが剪定で、不要な枝葉を刈り込むようにモデルの構造を単純化することで、過学習を抑制します。しかし、剪定以外にも過学習を防ぐ有効な手段が存在します。それが正則化です。

正則化は、モデルのパラメータにペナルティを課すことで、モデルが複雑になりすぎるのを防ぎます。例えるなら、複雑な迷路を作るのに、曲がり角の数に制限を加えるようなものです。代表的な正則化手法として、L1正則化とL2正則化が挙げられます。L1正則化は、パラメータの絶対値の和をペナルティとして加え、不要なパラメータをゼロに近づけます。一方、L2正則化はパラメータの二乗和をペナルティとして加え、パラメータの値を全体的に小さく抑えます。これらの正則化手法は、決定木のような木構造モデルだけでなく、線形回帰やニューラルネットワークなど、様々なモデルに適用可能です。

剪定と正則化は、どちらも過学習という同じ課題に対処するための手法ですが、そのアプローチは異なります。剪定は、木を剪定するようにモデルの構造そのものを直接変更します。一方、正則化は、パラメータの値を調整することで間接的にモデルの複雑さを制御します。例えるなら、剪定は建物の部屋数を減らすようなもので、正則化は各部屋の大きさを調整するようなものです。どちらの手法が最適かは、扱うデータの特性や使用するモデルの種類によって異なります。そのため、データとモデルの特徴を良く理解し、状況に応じて適切な手法を選択することが重要です。場合によっては、剪定と正則化を組み合わせて用いることで、より効果的に過学習を防ぐことも可能です。

| 手法 | 概要 | 効果 | 適用モデル | アナロジー |

|---|---|---|---|---|

| 剪定 | モデルの構造を単純化 | 過学習の抑制 | 決定木など | 建物の部屋数を減らす |

| 正則化 | モデルのパラメータにペナルティを課す | モデルが複雑になりすぎるのを防ぐ | 決定木、線形回帰、ニューラルネットワークなど | 各部屋の大きさを調整する |

| L1正則化 | パラメータの絶対値の和をペナルティとして加える | 不要なパラメータをゼロに近づける | 様々なモデル | – |

| L2正則化 | パラメータの二乗和をペナルティとして加える | パラメータの値を全体的に小さく抑える | 様々なモデル | – |

まとめ

決定木は、データをいくつかの集団に段階的に分けて予測を行う手法です。しかし、学習データに過剰に適合してしまうと、未知のデータに対する予測精度が下がってしまうことがあります。これを過学習といいます。この過学習を防ぎ、新しいデータに対しても高い予測精度を維持するために、剪定という手法が用いられます。剪定は、木の枝葉を切るように、決定木の複雑さを軽減することで、汎化性能を高める役割を果たします。

剪定には、大きく分けて事前剪定と事後剪定の二種類があります。事前剪定は、決定木の構築と同時に、ある基準に基づいて枝の成長を途中で止める手法です。これにより、最初から複雑になりすぎないように木を育てます。一方、事後剪定は、一度完全に決定木を構築した後で、不要な枝を削除していく手法です。具体的な方法としては、検証データを用いて剪定後の木の性能を評価し、精度が最も高くなるように枝を剪定します。

それぞれの手法には、様々な方法があります。例えば、事前剪定では、木の深さや葉の最小数などを制限する方法が一般的です。事後剪定では、コスト複雑性剪定と呼ばれる手法がよく用いられます。これは、木の複雑さと予測誤差のバランスを考慮して、最適な木の大きさを決定する手法です。

剪定を行うメリットは、予測精度を高めるだけではありません。木の大きさを小さくすることで、モデルの解釈性も向上します。複雑な木は理解するのが難しいですが、単純な木であれば、どの変数が重要なのか、どのように予測が行われているのかを容易に理解することができます。これは、特に説明責任が求められる分野では大きな利点となります。

このように、剪定は決定木学習において非常に重要なテクニックです。データの性質や目的に合わせて適切な剪定手法を選択し、より精度が高く、理解しやすいモデルを構築していくことが、機械学習を効果的に活用する上で不可欠と言えるでしょう。