AIの予期せぬ行動とその対処

AIの初心者

先生、「予期しない振る舞いへの対処」って、結局何をすればいいんですか?具体的にイメージが湧きません。

AI専門家

そうだね。例えば、さっき話したアマゾンの採用AIのような問題が起こってしまった時の対処法だよ。意図しない差別的な結果になってしまった場合、どうすればいいか、って話だね。

AIの初心者

ああ、そういうことですね。でも、具体的に何をすればいいんでしょう?

AI専門家

まず、なぜそうなったのかをきちんと調べて、問題点を明らかにする。そして、利用者に「意図したものではない」と誠実に謝罪し、すぐに利用を中止する。その後、再発防止策をきちんと考えて、実行する必要があるね。

予期しない振る舞いへの対処とは。

人工知能について、『想定外の動きへの対応』について説明します。人工知能の学習において、計算の手順に偏りがあると、人工知能が想定外の動きをしてしまうことがあります。これは、学習データに偏りがあると、偏った人工知能ができてしまうためです。

過去にアマゾン社では、男性の履歴書がほとんどを占める学習データを使って採用のための人工知能を学習させた結果、女性であるというだけで点数を低くつけてしまうことがありました。アマゾン社の開発チームには「男性を女性よりも優先的に採用しよう」という意図はなかったにもかかわらず、結果として差別的な採用人工知能ができてしまったのです。その後、アマゾン社は謝罪し、すぐに採用人工知能の使用を中止しました。

問題が大きくなってしまった場合は、意図していなかった動きであることを利用者に伝え、誠実に謝罪することが大切です。

はじめに

近頃、人工知能(じんこうちのう)という言葉をよく耳にするようになりました。機械がまるで人間のように考え、判断する技術は、想像をはるかに超える速さで進化し、私たちの暮らしにも深く入り込み始めています。買い物をする際に商品をお勧めしてくれたり、言葉で指示するだけで色々な作業をしてくれたり、生活を便利にしてくれる場面も増えています。

しかし、人工知能はまだ発展途上の技術です。まるで魔法のように何でもできるわけではなく、時には期待とは違う動きをすることもあります。これは、人工知能が学習に使うデータに偏りがある場合に起こりやすく、専門用語で「アルゴリズムバイアス」と呼ばれています。

例えば、大量の画像データを使って猫を認識する人工知能を訓練するとします。もし、学習データに白い猫ばかり写っていたとしたらどうでしょうか。その人工知能は、白い猫はきちんと猫だと認識できるようになるでしょう。しかし、黒い猫や三毛猫を見せても、猫だと認識できないかもしれません。このように、学習データの偏りが、人工知能の判断を歪めてしまうのです。

この偏りは、思わぬ問題を引き起こす可能性があります。例えば、採用担当者が使う人工知能が、過去の採用データに基づいて学習していたとします。もし、過去の採用者に男性が多かった場合、人工知能は男性を採用する方が良いと判断するかもしれません。これは性別による不公平な選考につながり、社会的な問題を引き起こす可能性があります。

このように、人工知能の予期しない振る舞いは、私たちが注意深く対処していく必要があります。人工知能がどのように学習し、どのような判断基準を持っているのかを理解することが大切です。そして、偏りのあるデータではなく、多様性を持ったバランスの取れたデータで学習させることで、より公平で信頼できる人工知能を開発していくことができるでしょう。本稿では、人工知能の予期しない振る舞いへの対処法について、具体的な事例を交えながら詳しく説明していきます。

| 人工知能の現状 | 課題 | 対策 |

|---|---|---|

| 急速に進化し、生活に浸透 例:商品推薦、音声操作 |

発展途上で、期待と異なる動作をする (アルゴリズムバイアス) 例:学習データに偏りがある場合、正しく認識できない |

人工知能の学習方法や判断基準を理解する 多様性のあるバランスの取れたデータで学習させる |

| 学習データの偏りが判断を歪める 例:白い猫のデータで学習→黒い猫を認識できない |

||

| 社会問題を引き起こす可能性 例:過去の採用データに男性が多い→男性有利な選考 |

学習データの偏り

人工知能の学習には、膨大な量の資料が必要です。まるで人間の学習と同じように、多くのことを学ぶためには多くの経験が必要です。しかし、その学習資料に偏りがあると、人工知能はその偏りをそのまま学習してしまい、偏った結果を出力してしまいます。これは、まるで偏った考えを持つ先生から教えを受けた生徒が、同じように偏った考えを持つようになるのと似ています。

例えば、過去の採用資料に男性が多く含まれているとします。これは、以前の社会状況や会社の状況を反映している可能性があります。このような資料で人工知能を学習させると、人工知能は男性を優遇する傾向を持つ可能性があります。つまり、男性を採用した方が良いと判断してしまうのです。これは、人工知能が資料の偏りをそのまま反映しているだけであり、開発者が意図的に男性を優遇するようにプログラムしたわけではない場合がほとんどです。人工知能自身は善悪の判断や男女の区別も理解しておらず、ただ資料に基づいて判断を下しているに過ぎません。

この問題は、採用活動だけでなく、様々な場面で発生する可能性があります。例えば、犯罪の発生率予測システムが特定の地域を危険地域と判断したり、ローン審査システムが特定の属性の人々に対して不利な審査結果を出力したりする可能性があります。このような偏った結果は、社会的な不平等を助長する可能性があり、大きな問題となります。

資料の偏りは、人工知能の予期しない動作の主な原因の一つです。そのため、人工知能を開発する際には、学習資料の偏りを認識し、その影響を軽減するための対策を講じることが非常に重要です。資料の偏りを修正したり、人工知能の学習方法を工夫したりすることで、より公平で信頼性の高い人工知能を開発することが可能になります。人工知能が社会にとって有益な存在となるためには、この資料の偏り問題への対策が不可欠です。

| 問題点 | 具体例 | 原因 | 対策 |

|---|---|---|---|

| 学習資料の偏りによるAIの偏った出力 |

|

過去のデータや社会状況を反映した学習資料の偏り。AIは善悪の判断や男女の区別を理解せず、資料に基づいて判断。 |

|

アマゾン社の事例

世界的に有名な買い物仲介業者であるアマゾン社で、人を採用するための人工知能が作られました。これは、過去に採用した人たちの資料を基にして学習する仕組みでした。ところが、そのもととなる資料には、男性の資料が圧倒的に多く含まれていました。そのため、学習した人工知能は、女性だというだけで評価を下げ、女性を不採用にするようになってしまったのです。アマゾン社としては、女性を差別するつもりは全くありませんでした。しかし、学習に使った資料の偏りのせいで、意図しない差別を生み出してしまいました。

この人工知能は、履歴書に書かれた言葉や表現を分析し、評価していました。過去の資料では、男性が使う言葉や表現が多く含まれていたため、人工知能はそれを高く評価するようになりました。たとえば、「実行力」や「指導力」といった言葉は男性の履歴書に多く、人工知能はそれらを高く評価しました。逆に、女性の履歴書に多く見られる言葉や表現は、評価が低くなってしまいました。

結果として、人工知能は女性からの応募を自動的に排除するようになってしまいました。これは、アマゾン社が目指していた公平な採用とは全く異なるものでした。アマゾン社はこの問題に気づき、人工知能の使用を中止しました。この出来事は、人工知能を作る上で、学習させる資料の偏りをなくすことの大切さを世界中に知らしめました。人工知能は便利な道具ですが、使い方を間違えると、思わぬ結果につながることがあります。人工知能を正しく使うためには、偏りのない、公平な資料を使って学習させることが必要です。そして、常に人工知能が出す結果を注意深く確認し、問題があればすぐに修正することが重要です。

| 項目 | 内容 |

|---|---|

| 問題 | Amazon社が採用にAIを導入したが、学習データの偏りにより女性差別が発生した。 |

| 原因 | 学習データに男性の資料が多く含まれていたため、AIが男性を有利に評価するようになった。 |

| 結果 | AIが女性からの応募を自動的に排除するようになった。 |

| 対策 | Amazon社はAIの使用を中止し、学習データの偏りをなくすことの重要性を認識した。 |

| 教訓 | AIは学習データの質に大きく影響されるため、偏りのないデータを使用し、結果を注意深く確認する必要がある。 |

予期しない行動への対応

人工知能が私達の思い描いた通りに動いてくれない、そんな想定外の事態に直面した時は、迅速かつ的確な対応が求められます。慌てずに、まずは落ち着いて問題の根本原因を探ることから始めましょう。なぜそのような行動に至ったのか、その原因を突き止める事が、二度と同じ問題を繰り返さないための第一歩となります。原因が学習に使った情報の偏りにある場合は、情報の集め方やその情報の整理方法を再検討する必要があります。例えば、特定の属性を持つ情報ばかりを集めていたならば、もっと多様な情報を集める必要があるでしょう。また、集めた情報の質にも注意を払い、不適切な情報が混ざっていないかを確認する必要があります。

人工知能が出した結果を常に注意深く見守り、少しでもおかしいなと感じたらすぐに対応できるような仕組み作りも大切です。これは、まるで車の運転中に常に周囲に気を配り、危険を察知したらすぐにブレーキを踏むのと同じです。早期発見、早期対応こそが、大きな問題に発展するのを防ぐ鍵となります。

そして忘れてはいけないのが、人工知能を使う人々への丁寧な説明です。人工知能には得意な事、不得意な事があり、時には思わぬ落とし穴があるという事を、きちんと伝える必要があります。包み隠さず情報を公開することで、利用者も安心して人工知能を使う事ができるようになります。人工知能は私達にとって便利な道具ですが、使い方を間違えると危険な道具にもなり得ます。だからこそ、正しく理解し、適切に使う事が重要なのです。まるで包丁のように、料理を作る際には無くてはならない便利な道具ですが、使い方を誤れば怪我をする危険性もあるのと同じです。人工知能を使う私達一人一人が、その事をしっかりと認識し、責任ある行動を心がける必要があるでしょう。

謝罪と説明

近頃、人工知能が私たちの暮らしに深く入り込み、様々な場面で活躍しています。しかし、時として、予測できない行動を起こし、社会に波紋を広げることがあります。そのような事態に直面した場合、開発者はどのような対応を取るべきでしょうか。何よりもまず、心からの謝罪と、なぜそのような問題が起きたのかを丁寧に説明する責任があります。 隠したり、言い訳をしたりするのではなく、真摯に事実を明らかにし、何が原因で問題が起きたのかを徹底的に究明する姿勢を示すことが重要です。

例えば、ある大手通販会社が開発した採用支援の人工知能が、過去のデータに基づき、女性を不利に扱うという問題を起こした事例があります。この時、会社側は問題を認識するとすぐに人工知能の使用を停止し、公式な場で謝罪を行いました。そして、再発防止に向け、どのような対策を講じるのかを具体的に説明しました。このように、問題が起きた際に迅速かつ誠実な対応をすることは、社会からの信頼を失わずに済むだけでなく、将来的な技術開発への理解と協力を得る上でも非常に大切です。

逆に、問題を隠蔽したり、責任逃れをしたりするような対応は、事態を悪化させるばかりです。社会からの批判はより激しくなり、企業の信用は地に落ち、取り返しのつかない事態を招く可能性もあります。また、問題の根本的な解決が遅れ、同様の事態が繰り返される危険性も高まります。

人工知能は発展途上の技術であり、予期せぬ問題が発生する可能性は常に存在します。だからこそ、開発者は常に責任ある行動を心がけ、問題が発生した際には誠実な対応を第一に考えるべきです。 そうすることで、人工知能と人間社会がより良い形で共存していく未来を築くことができるでしょう。

| 状況 | 開発者の対応 | 結果 |

|---|---|---|

| AIが予測できない行動を起こし、社会に波紋を広げる |

|

|

| AIが問題を起こす |

|

|

今後の展望

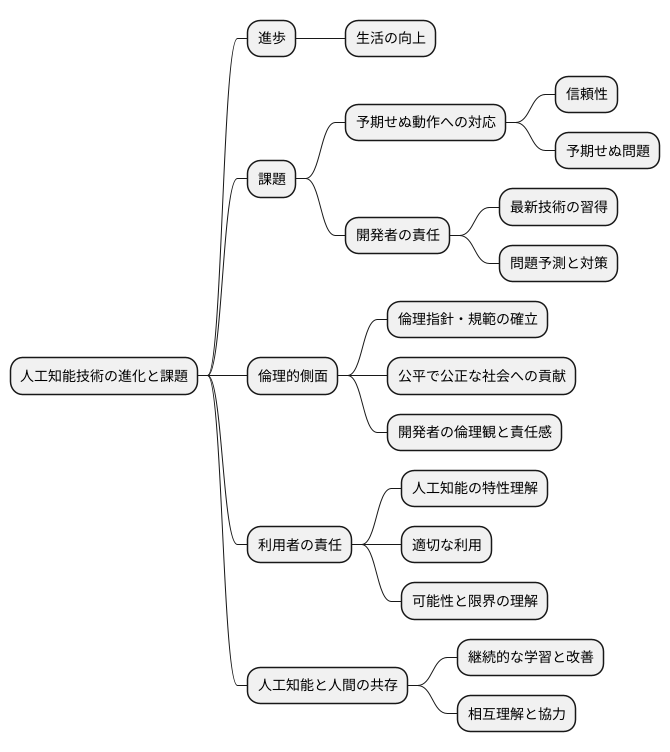

人工知能技術は日進月歩で進化を続けており、その進歩は私たちの生活をより豊かにする可能性を秘めています。しかし、同時に予測できない動作への対応も大きな課題として常に存在しています。人工知能が時として期待とは異なる反応を示すことは、技術の信頼性を揺るがすだけでなく、予期せぬ問題を引き起こす可能性も懸念されます。そのため、開発者は常に変わり続ける技術の進歩に遅れを取ることなく、最新の知見と技術を取り入れ、起こりうる問題を事前に予測し、適切な対策を講じる必要があります。

さらに、人工知能技術の発展に伴い、倫理的な側面に関する議論もますます重要性を増しています。人工知能が私たちの社会に深く浸透していく中で、その利用における倫理的な指針や規範の確立が急務となっています。開発者は、倫理的な観点を常に念頭に置き、責任ある人工知能開発に取り組むことが求められています。これは単に技術的な問題だけでなく、社会全体にとっての責任でもあると言えるでしょう。人工知能が公平で公正な社会の実現に貢献するためにも、開発者は高い倫理観と責任感を持つ必要があります。

また、人工知能を利用する私たちも、その特性を正しく理解し、適切に利用していく必要があります。人工知能はあくまでも道具であり、その利用方法次第で良い結果にも悪い結果にもなり得ます。そのため、利用者は人工知能の持つ可能性と限界を理解し、責任ある利用を心がける必要があります。人工知能と人間がより良い形で共存していくためには、継続的な学習と改善が不可欠です。技術の進歩とともに変化する課題に対応するため、開発者だけでなく利用者も常に学び続け、人工知能との適切な関わり方を模索していく必要があるでしょう。人工知能と人間が共に進化し、より良い未来を築いていくためには、相互の理解と協力が欠かせません。