AIプロジェクトの体制構築

AIの初心者

先生、「プロジェクト体制の構築」って、具体的にどんなことをすればいいのでしょうか?

AI専門家

いい質問だね。AIプロジェクトでは、チームを作る段階でいくつか気をつけないといけないことがあるんだ。例えば、チームのメンバーの人種や性別が偏ってしまうと、AIにもその偏りが反映されてしまうことがある。だから、多様な人材でチームを作るのが大切なんだよ。

AIの初心者

多様な人材って、どうして必要なんですか?

AI専門家

例えば、過去にアメリカで使われていた「COMPAS」というAIは、人種によって犯罪を起こす確率が違うという偏った判断をしてしまったんだ。これは、開発チームの多様性が足りなかったことが原因の一つと考えられているんだよ。他にも、個人情報の保護についても、システムを作る最初の段階から考えておく必要がある。これを「プライバシー・バイ・デザイン」というんだよ。

プロジェクト体制の構築とは。

人工知能を使った事業を始めるにあたって、準備しておくべきことがあります。まず、人工知能は開発に関わる人の偏見の影響を受けやすい性質を持っています。そのため、開発チームを作る際には、人種や性別など、様々な人が参加できるようにすることが大切です。アメリカの裁判で使われた「コンパス」という人工知能は、肌の色が白い人よりも、そうでない人の再犯率を高く予想してしまい、問題になりました。また、個人情報の保護については、運用が始まってから考えるのではなく、システムを作り始める段階から対策をしっかりと考えておく必要があります。これは「プライバシー・バイ・デザイン」という考え方です。

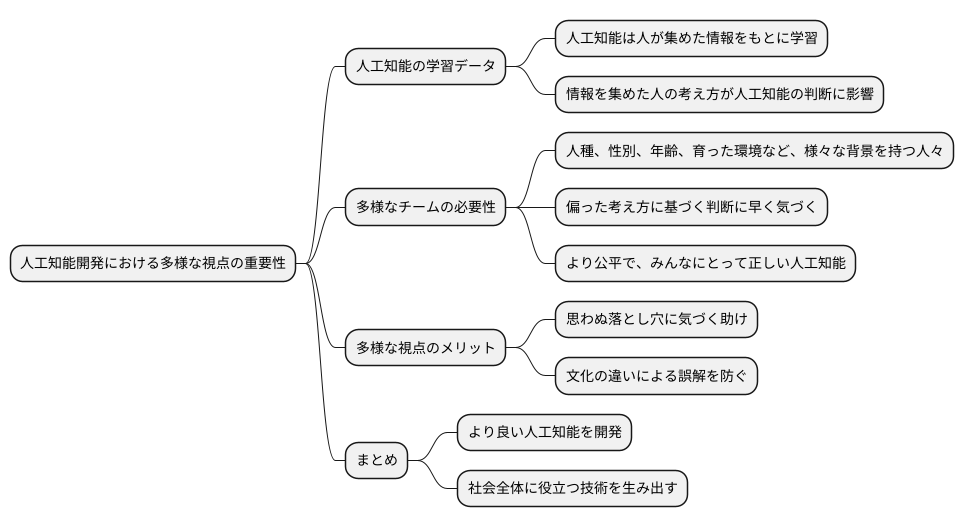

多様な視点を持つチームの重要性

人工知能を作る仕事は、様々な考えを持つ人々が集まることがとても大切です。なぜなら、人工知能は人が集めた情報をもとに学ぶため、その情報を集めた人たちの考え方が、人工知能の判断に影響してしまうことがあるからです。もし、人工知能を作る人々の背景が似通っていると、ある特定の人々にとって不公平な結果を生み出す人工知能ができてしまうかもしれません。

過去に、アメリカの裁判で使われていた人工知能を例に考えてみましょう。この人工知能は、犯罪を犯した人が再び罪を犯す可能性を予測するために使われていましたが、人種によって予測結果に違いが出てしまうという問題がありました。このような問題を防ぐためには、人工知能を作るチームに、人種、性別、年齢、育った環境など、様々な背景を持つ人々を入れることが必要です。

様々な考えを持つ人々が集まれば、偏った考え方に基づく判断に早く気づくことができます。そうすることで、より公平で、みんなにとって正しい人工知能を作ることができるのです。異なる背景を持つ人々がそれぞれの視点を持ち寄り、話し合うことで、より多くの人にとって使いやすい人工知能を作ることが可能になります。

多様な視点は、人工知能を作る上での、思わぬ落とし穴に気づく助けになります。例えば、ある国でよく使われる言葉や表現が、他の国では違う意味を持つことがあります。このような文化の違いを理解していなければ、誤解を生む人工知能ができてしまうかもしれません。多様なチームであれば、このような問題にも事前に気づき、対応することができます。

このように、多様な視点を持つチームを作ることは、より良い人工知能を開発し、社会全体に役立つ技術を生み出すために欠かせないのです。

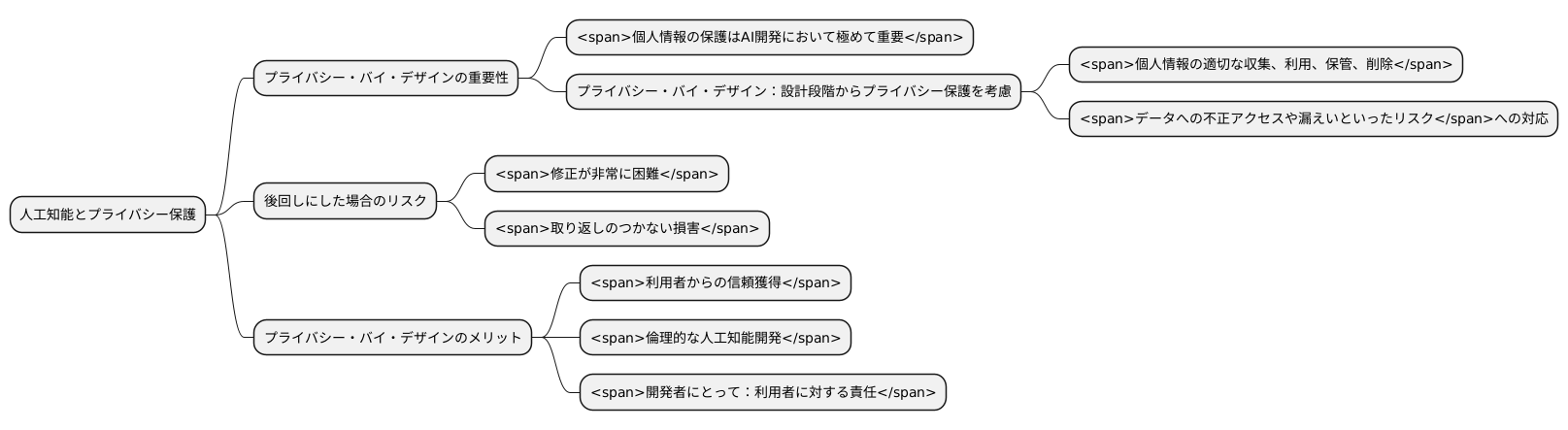

プライバシー保護の必要性

近頃、様々な分野で人工知能が活用され、私たちの暮らしをより便利で豊かにしています。しかし、人工知能は多くの場合、膨大な量の個人情報を含むデータを扱います。そのため、個人情報の保護は人工知能開発において極めて重要な要素となっています。人工知能システムが適切に個人情報を扱うようにするためには、開発の初期段階からプライバシー保護の観点を組み込むことが不可欠です。これを「プライバシー・バイ・デザイン」といいます。

プライバシー・バイ・デザインとは、システムやサービスの設計段階からプライバシー保護を考慮するという考え方です。人工知能の開発において、プライバシー・バイ・デザインを採用することは、個人情報の適切な収集、利用、保管、そして削除といった一連の流れを確実なものにします。また、データへの不正アクセスや漏えいといったリスクにも、あらかじめ対応策を講じることができます。

もしプライバシー保護の対策を後回しにして、システムが完成した後に対応しようとすると、修正が非常に困難になり、多大な費用と時間がかかる場合があります。さらに、一度流出した個人情報は完全に回収することは難しく、取り返しのつかない損害につながる可能性があります。開発当初からプライバシー保護を考慮することで、このような事態を未前に防ぐことができます。

プライバシー・バイ・デザインは、利用者からの信頼獲得にもつながります。個人情報の保護に配慮した人工知能システムは、利用者にとって安心して利用できるシステムと言えるでしょう。開発者は、プライバシー保護を単なる義務ではなく、利用者に対する責任と捉え、開発に取り組む必要があります。プライバシー・バイ・デザインは、倫理的な人工知能開発の基盤となる重要な考え方です。

倫理的な側面への配慮

人工知能技術の進歩は目覚ましいものがあり、私たちの暮らしを大きく変えようとしています。それと同時に、倫理的な側面への配慮もこれまで以上に重要になっています。人工知能は様々な恩恵をもたらす可能性を秘めている一方で、意図しない結果を引き起こす可能性も否定できません。

人工知能を使った事業を進める際には、倫理的な指針を定め、開発に携わる全員がそれを理解し共有することが必要不可欠です。例えば、人工知能が倫理的に問題のある判断を下した場合、誰が責任を負うのか、どのような対応策を取るのかなどを前もって明確にしておく必要があります。また、人工知能の判断の過程を分かりやすく示し、なぜそのような判断に至ったのかを説明できるようにすることも大切です。責任の所在を明らかにし、説明できる仕組みにすることで、社会からの信頼を得ることができ、安心して人工知能技術を利用できる環境づくりにつながります。

人工知能の倫理的な側面を考える際には、公平性、透明性、説明責任、プライバシー保護、安全性といった様々な要素を考慮する必要があります。例えば、人工知能が特定の人々を差別するような判断を下さないように、開発段階からデータの偏りなどを注意深くチェックする必要があります。また、個人情報保護の観点からも、データの収集、利用、保管方法などを適切に管理する必要があります。人工知能が社会にとって真に役立つものとなるためには、技術的な進歩だけでなく、倫理的な側面への深い理解と配慮が不可欠です。そのためには、開発者だけでなく、利用者、そして社会全体で議論を深め、より良い人工知能技術の活用方法を探っていく必要があります。人工知能技術は今後も進化し続けると考えられます。だからこそ、倫理的な側面への継続的な配慮と改善を怠ることなく、責任ある技術開発と活用を進めていくことが、私たち皆の責任です。

| 人工知能開発における倫理的配慮の必要性 | 具体的な取り組み | 期待される効果 |

|---|---|---|

| 倫理的に問題のある判断への対応策を明確化 | 責任の所在、対応策を事前に決定 判断過程を分かりやすく示し、説明可能にする |

社会からの信頼獲得 安心して利用できる環境づくり |

| 様々な倫理的要素への配慮 | 公平性:データの偏りなどをチェック 透明性:判断過程を明確化 説明責任:責任の所在を明確化 プライバシー保護:データの適切な管理 安全性:意図しない結果への対策 |

社会にとって真に役立つ人工知能の実現 |

| 継続的な配慮と改善 | 開発者、利用者、社会全体で議論を深める | 責任ある技術開発と活用 |

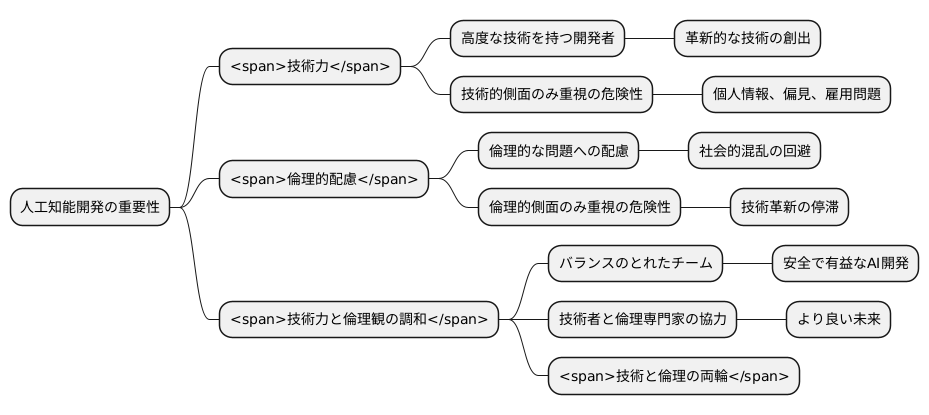

技術力と倫理観のバランス

近頃、様々な分野で人工知能の活用が進み、私たちの暮らしは大きく変わりつつあります。こうした技術革新の波に乗り遅れまいと、多くの企業が人工知能開発に力を注いでいます。真に役立つ人工知能を生み出すには、高い技術力はもちろんのこと、倫理的な配慮も欠かせません。

高度な技術を持つ開発者たちは、人工知能の可能性を最大限に引き出し、革新的な技術を生み出すことができます。しかし、技術的な側面ばかりに目を奪われてしまうと、思わぬ落とし穴にはまってしまうかもしれません。例えば、個人情報の取り扱い、偏見の助長、雇用への影響など、人工知能には様々な倫理的な問題が潜んでいます。これらの問題を軽視すれば、社会に大きな混乱を招きかねません。

反対に、倫理的な側面ばかりを重視しすぎると、技術革新の足を引っ張ってしまう恐れがあります。人工知能には大きな可能性が秘められており、正しく使えば私たちの暮らしを豊かにすることができます。過度な規制や倫理的な懸念によって技術開発のスピードが落ちてしまうと、せっかくの機会を逃してしまうかもしれません。

大切なのは、技術力と倫理観の調和です。両方の視点をバランスよく持ち合わせたチームを作ることで、初めて安全で有益な人工知能を開発できるのです。技術者は倫理的な問題について学び、倫理の専門家は技術的な知識を深める必要があります。互いに協力し、議論を重ねることで、より良い未来を築くための技術を生み出せるはずです。人工知能は道具であり、その使い方は私たち人間が決めるのです。だからこそ、技術と倫理の両輪を大切にしながら、人工知能の開発を進めていく必要があるのです。

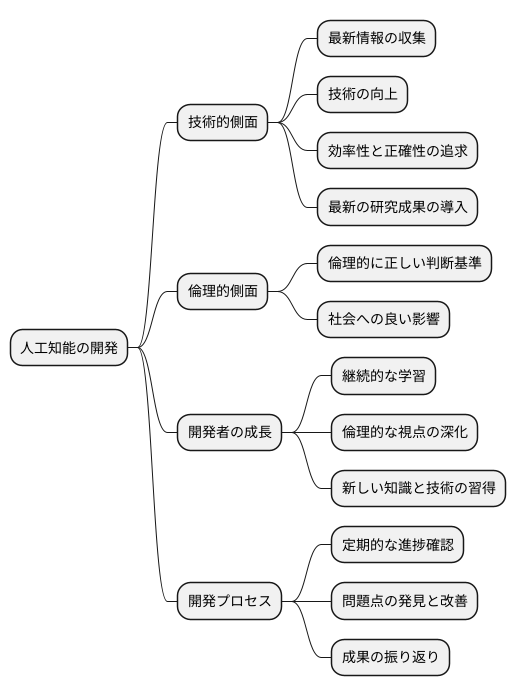

継続的な学習と改善

人工知能の技術は、まるで生き物のように、常に変化し、新しいものへと姿を変えています。次々と生まれる新しい技術や考え方は、この変化の証です。人工知能を作る私たちは、まるで探検家のように、常に最新の情報を集め、技術を磨き、倫理的な視点を養う必要があります。学び続け、改善していくことは、質の高い人工知能を作り、社会の変化に対応するために欠かせないのです。

人工知能を作る過程では、定期的に進み具合や成果を振り返り、問題点を見つけ、改善していくことが大切です。例えば、人工知能が何かを判断する時、その判断基準が倫理的に正しいか、社会にとって良い影響を与えるかを常に確認しなければなりません。また、技術的な面でも、最新の研究成果を取り入れ、より効率的で正確な人工知能を作る努力を続ける必要があります。

人工知能技術の進歩と同時に、私たち自身も成長し続けることが重要です。新しい知識や技術を学び、倫理的な視点を深めることで、より良い人工知能を開発することができます。まるで植物が成長していくように、私たちも学び続け、変化していくことで、社会にとってより良い人工知能を生み出すことができるのです。人工知能を作る私たちもまた、学び続けることで、人工知能と共に成長し、より良い未来を築くことができるでしょう。