大規模言語モデルのスケーリング則

AIの初心者

先生、「スケーリング則」って一体何ですか?なんか難しそうでよくわからないです…

AI専門家

そうですね、一見難しそうに聞こえますが、簡単に言うと「模型を大きくするとどうなるか」の法則のようなものです。例えば、言葉を扱うAIのモデルを大きくすると、性能がどれくらい良くなるかを予測できる法則なんです。

AIの初心者

AIのモデルを大きくする、というのは具体的にどういうことですか?

AI専門家

AIモデルは、たくさんの計算式を組み合わせたものと考えてください。大きくするというのは、この計算式の数を増やすことや、AIが学習するデータの量を増やすことを指します。模型を大きくするように、AIモデルの規模を大きくすると性能が向上することが多いのですが、その関係性を示すのがスケーリング則です。

スケーリング則とは。

人工知能の言葉で「規模の法則」というものがあります。(規模の法則という言葉は、物理や生物などの分野にもありますが、ここでは、人工知能、特に言葉の処理における規模の法則について説明します。)

はじめに

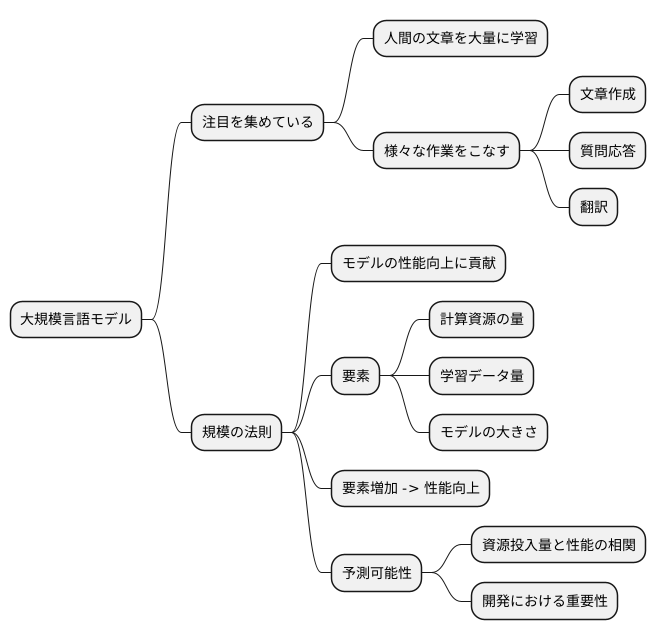

近ごろ、人工知能、とりわけ言葉を扱う技術の分野では、大規模言語モデルが大きな注目を集めています。この大規模言語モデルとは、人間が書いた文章を大量に学習させることで、まるで人間のように文章を書いたり、質問に答えたり、翻訳したりと、様々な作業をこなせるようになる技術です。まるで魔法の箱のようです。この魔法の箱の性能を向上させる鍵となるのが、「規模の法則」です。

この規模の法則は、モデルの性能が、計算に使う資源の量、学習に使う文章の量、そしてモデル自体の大きさといった要素に、どのように関係しているかを示す経験的な法則です。簡単に言うと、これらの要素を大きくすればするほど、モデルの性能が良くなるという法則です。まるで、植物に水をやればやるほど大きく育つように、モデルも大きく育てれば育てるほど賢くなるのです。しかも、この成長は予測可能です。どれだけの資源を投入すれば、どれだけの性能が得られるか、ある程度見当をつけることができます。この予測可能性が、大規模言語モデルの開発において非常に重要です。限られた資源を効率的に使い、目標とする性能を達成するために、この規模の法則はなくてはならない羅針盤のような役割を果たしているのです。次の章では、この規模の法則について、さらに詳しく見ていくことにしましょう。

法則の解明

物事の仕組みや成り立ちを探る法則の解明について考えてみましょう。近年、様々な分野で注目を集めている法則に、規模の拡大則というものがあります。これは、ある仕組みの性能が、計算に使った資源の量、集めた情報の量、そして仕組み自体の大きさの、それぞれを掛け合わせた値で決まるという考え方です。具体的に言うと、これらの要素を同じ割合で増やせば、性能も同じ割合で向上する、というものです。この関係を、それぞれを対数で表したグラフに描くと、直線的な関係として見ることができます。

この規模の拡大則の発見は、特に言葉を取り扱う大きな仕組みの開発に大きな影響を与えました。なぜなら、この法則を用いることで、仕組みの性能を前もって予測し、開発に必要な資源を見積もることができるからです。例えば、ある程度の性能を達成するためには、どれだけの計算の力が必要か、どれだけの情報量が必要かを予測できます。そして、この予測に基づいて、無駄なく資源を割り当て、開発を進めることができます。

さらに、この規模の拡大則は、今後の開発の方向性を示唆する重要な役割も担っています。例えば、より高い性能を目指すためには、計算資源を増やす、情報を増やす、仕組みを大きくするという三つの選択肢があります。規模の拡大則は、これらの選択肢が性能にどう影響するかを示すため、最適な開発戦略を立てるための指針となります。資源の制約や開発期間などを考慮しながら、どの要素をどれだけ増やすかを決定することで、効率的に目標性能を達成することが可能になります。このように、規模の拡大則は、物事の仕組みの解明を通して、様々な分野の進歩に貢献しているのです。

| 法則 | 説明 | 影響 |

|---|---|---|

| 規模の拡大則 | ある仕組みの性能が、計算に使った資源の量、集めた情報の量、仕組み自体の大きさの掛け合わせで決まる法則。これらの要素を同じ割合で増やすと、性能も同じ割合で向上する。 |

|

法則の応用

物事の法則をうまく活用すれば、ただ結果を予想するだけでなく、計画や実践にも役立てることができます。例えば、模型を作ることを考えてみましょう。模型の出来栄えを左右する要素は、模型の大きさ、材料の量、そして作業時間です。これらの要素の間には法則性があり、法則を理解することで、望み通りの模型を作るために、大きさ、材料、作業時間の最適な組み合わせを見つけ出すことができます。

同じように、近頃話題の大きな言語模型を作る際にも、法則が重要な役割を果たします。この言語模型は、規模が大きく複雑であるため、その性能を左右する要素も模型の大きさ、学習データの量、そして計算量といったものになります。これらの要素間の関係性を示す法則を「規模の法則」と呼びます。この規模の法則を用いることで、目標とする性能を達成するために必要な模型の大きさ、データ量、計算量を見積もることが可能になります。例えば、ある性能を達成したい場合、規模の法則に基づいて、計算量を増やすよりもデータ量を増やす方が効果的である、といった判断ができるわけです。

規模の法則は、今後の研究の指針となるという点でも重要です。例えば、現在の規模の法則には限界があることが分かっています。この限界はどこにあるのか、そして限界を突破するためにはどのような方法が必要なのか、といった課題は、今後の研究の重要なテーマとなります。また、規模の法則をより精密なものにするためには、どのような工夫が必要なのかも探求していく必要があります。これらの研究は、より高性能な大きな言語模型の開発につながり、ひいては人工知能の発展に大きく貢献するものと期待されます。

| 対象 | 要素 | 法則の活用 |

|---|---|---|

| 模型製作 | 大きさ、材料の量、作業時間 | 望み通りの模型を作るための最適な組み合わせを見つける |

| 大きな言語模型 | 模型の大きさ、学習データの量、計算量 | 目標性能達成に必要な資源を見積もる (例: 計算量よりデータ量を増やす方が効果的) |

| 今後の研究 | 規模の法則の限界、精密化のための工夫 | 高性能な言語模型開発、人工知能の発展 |

今後の展望

大規模言語モデルの将来を考える上で、規模の拡大に伴う性能向上の法則、いわゆるスケーリング則は重要な発見です。しかし、現状ではこの法則は未解明な部分が多く、更なる探求が必要です。

まず、スケーリング則がなぜ成り立つのか、その仕組みは完全には理解されていません。現状では、法則が成立する背景にある理論的な根拠が不足しており、経験的な観測に基づいた推測の域を出ていません。この仕組みの解明は、スケーリング則をより効果的に活用する上で不可欠であり、今後の研究における重要な課題と言えるでしょう。

次に、現在のスケーリング則は、既存のモデル構造や学習方法に依存しているという点も課題です。近年、様々な新しいモデル構造や学習方法が提案されていますが、これらの革新的な技術とスケーリング則の関係性は未知数です。将来、より優れたモデル構造や学習方法が開発された場合、現在のスケーリング則がそのまま適用できる保証はありません。むしろ、新たな技術に対応した新しいスケーリング則の発見が必要となる可能性もあります。

これらの課題を克服することで、スケーリング則への理解が深まり、より高性能な大規模言語モデルの開発につながると期待されます。スケーリング則の背後にある仕組みを解明できれば、モデルの性能向上をより正確に予測できるようになるでしょう。また、新しいモデル構造や学習方法とスケーリング則を組み合わせることで、現在のスケーリング則の限界を超える、更なる性能向上が実現するかもしれません。これらの研究は、人工知能の発展に大きく貢献するでしょう。

| 課題 | 詳細 | 将来への影響 |

|---|---|---|

| スケーリング則の仕組みの未解明 | なぜスケーリング則が成り立つのか、理論的な根拠が不足しており、経験的な観測に基づいた推測の域を出ていない。 | 仕組みの解明は、スケーリング則をより効果的に活用する上で不可欠。 |

| 既存技術への依存 | 現在のスケーリング則は、既存のモデル構造や学習方法に依存しており、新しい技術との関係性は未知数。 | 新たな技術に対応した新しいスケーリング則の発見が必要となる可能性がある。 |

| モデルの性能向上をより正確に予測できるようになる。現在のスケーリング則の限界を超える性能向上が実現するかもしれない。 |

まとめ

この記事では、大規模言語モデルの性能向上に欠かせない「規模の法則」について説明しました。この法則は、モデルの性能が、計算に使う資源の量、学習に使うデータの量、そしてモデル自体の大きさの3つの要素に、どのように関係しているのかを示すものです。この関係性を理解することは、モデルの性能を予測したり、開発に必要な資源を適切に割り当てたりする上で非常に重要です。

規模の法則を理解することで、大規模言語モデルの開発をより効率的に進めることができます。そして、この法則に基づいた研究を進めることで、今よりももっと性能の良いモデルが生まれることが期待されます。規模の法則は、ただの実験的な発見にとどまらず、大規模言語モデルがどのように学習しているのか、そして人工知能の限界はどこにあるのかを探るための重要な手がかりにもなります。

今後の研究によって、規模の法則の謎がさらに解き明かされ、その成果が人工知能の発展に役立てられることが期待されます。より複雑な作業をこなし、より人間に近い振る舞いをする人工知能を実現するために、規模の法則は重要な役割を担っていくでしょう。例えば、人間のように言葉の意味を理解し、文脈に沿った適切な応答を生成する、高度な会話能力を持つ人工知能の開発が期待されます。また、大量のデータから知識を抽出し、新しい情報を生成する能力も、規模の法則に基づいたモデルによって飛躍的に向上する可能性があります。これらの発展は、私たちの生活の様々な場面で革新的な変化をもたらすでしょう。