説明可能なAIとは?

AIの初心者

「説明できるAI」って、どういう意味ですか?難しくてよくわからないです。

AI専門家

簡単に言うと、AIが出した答えの理由がわかるAIのことだよ。たとえば、AIが「今日は雨が降る」と予想したとき、なぜそう考えたのか、その根拠がわかるように説明してくれるんだ。

AIの初心者

なるほど。理由がわかるのとわからないのでは、何が違うんですか?

AI専門家

理由がわかれば、AIの判断が正しいのかどうかを私たち人間がチェックできるし、AIの予測をより信頼できるようになるよね。それに、AIが間違った判断をした場合、その原因を突き止めて改善することもできるんだよ。

Explainable AIとは。

人工知能は、物事の本質を見抜き、結果を予測するのが得意です。しかし、それと同じくらい大切なのは、なぜそのような結論に至ったのか、その理由を理解することです。結論に至るまでの過程が説明できることは、結果に与える影響や、理解を深めること、信頼関係を築くこと、そして最良の判断をする上で欠かせません。しかし、すべての機械学習の仕組みが説明できるわけではありません。そのため、仕組みを選ぶ際には、どのような状況で判断が下されるのかを考え、説明できるかどうかを判断する必要があります。説明できないと、ビジネス上の判断に思わぬ偏りが生まれるかもしれません。

説明可能なAIの重要性

近頃、様々な分野で人工知能がめざましい成果を上げています。膨大な量の情報を処理し、そこから隠れた知識を見つけ出し、未来を予測する力は驚くべきものです。しかし、人工知能がどのようにしてその結論にたどり着いたのか、その過程を理解することは、予測の正確さと同じくらい、あるいはもっと重要だと言えるでしょう。人工知能の判断の理由が分からなければ、その結果を信用し、大切な決定に使うことは難しいからです。

そこで注目されているのが、説明できる人工知能、つまり説明可能な人工知能です。これは、人工知能のブラックボックス、まるで中身の見えない箱のような状態を解き明かし、その思考過程を人が理解できるようにすることを目指しています。人工知能がどのように情報を処理し、どの情報が最終的な判断に大きく影響したのかを明らかにすることで、人はその結論を納得し、安心して受け入れることができます。これは、人工知能の信頼性を高め、より効果的に活用するために欠かせない要素です。

例えば、医療の現場で人工知能が病気を診断する場合を考えてみましょう。診断結果だけを提示されても、医師はすぐにはそれを受け入れることはできません。人工知能がどのような根拠に基づいてその診断に至ったのか、どの検査データが重要だったのかを知ることで、医師は診断の妥当性を判断し、治療方針を決定することができます。また、人工知能が誤った判断をした場合でも、その原因を特定し、改善につなげることが可能になります。

このように、説明可能な人工知能は、人工知能をより信頼性が高く、安全なものにするために不可欠です。今後、様々な分野で人工知能の活用が進むにつれて、説明可能な人工知能の重要性はますます高まっていくでしょう。人が人工知能と協調してより良い社会を築くためには、人工知能の思考過程を理解し、信頼関係を築くことが何よりも重要なのです。

説明可能なAIの利点

説明できる人工知能は、技術的な興味を満たす以上のものです。様々な良い点があり、仕事や社会全体に大きな影響を与えます。

まず、人工知能がどのように判断したのかが分かれば、その結果への信頼感が増します。これは、人工知能を使う上で大きな壁となる「よく分からないから怖い」という気持ちをなくし、もっと積極的に人工知能を使えるようにするでしょう。人工知能が出した答えが、なぜそうなのか分からなければ、使うのをためらってしまいます。しかし、その理由が分かれば、安心して使えるようになります。これは、人工知能を様々な分野で活用していく上で、とても大切なことです。

また、説明できる人工知能は、人工知能の考え方に潜む偏りや間違いを見つける助けになります。人工知能は、大量のデータから学習します。もし、そのデータに偏りがあれば、人工知能も偏った考えをするようになってしまいます。説明できる人工知能であれば、どのように考えてその答えを出したのかが分かるので、偏りや間違いを発見し、修正することができます。これは、公平さや倫理的な面からも非常に重要です。誰もが安心して使える人工知能を作るためには、偏りや間違いのないようにすることが不可欠です。

さらに、人工知能の思考過程を理解することで、人は新しい発見をし、より良い判断ができるようになります。人工知能は、人間とは異なる視点で物事を考えます。人工知能の思考過程を理解することで、人間は今まで気づかなかった視点や考え方に触れることができます。これは、新しい発想や発見に繋がり、より良い判断をするための助けとなるでしょう。人工知能は、単なる道具ではなく、人と協力して共に成長していくための大切な仲間となるでしょう。人工知能と人が協力することで、より良い未来を築いていくことができると期待されます。

| メリット | 説明 |

|---|---|

| 信頼感の向上 | AIの判断根拠が理解できるため、AIへの信頼感が向上し、利用への抵抗感が減少する。 |

| 偏りや間違いの発見 | AIの思考過程が明らかになることで、学習データの偏りやAIの判断ミスを発見・修正できる。 |

| 新しい発見とより良い判断 | AIの思考過程を理解することで、新たな視点や考え方に触れ、より良い判断が可能になる。 |

説明可能なAIとそうでないAI

人工知能には、その判断の理由が分かりやすいものと、分かりにくいものがあります。分かりやすい人工知能は、まるで人間の思考過程をたどるかのように、どのような根拠でその結論に至ったのかを明確に示すことができます。例えば、健康診断の結果から病気を予測する人工知能があるとします。この人工知能が、特定の血液検査の値が基準値を超えていることや、過去の病歴などを根拠に診断結果を提示すれば、私たちは人工知能の判断過程を理解し、その結論に納得することができます。このような人工知能は、判断の透明性が高く、利用者の信頼を得やすいという利点があります。

一方、判断の理由が分かりにくい人工知能もあります。これは、まるでブラックボックスのように、入力データから出力結果に至るまでの過程が複雑で、人間には理解しにくい構造をしています。例えば、大量の画像データから猫を識別する人工知能があるとします。この人工知能が、どのような特徴に基づいて猫を識別しているのかを人間が理解することは非常に困難です。このような人工知能は、高い精度で猫を識別できたとしても、その判断根拠が不明瞭であるため、利用者は不安を感じることがあります。特に、医療診断や金融取引など、人の人生に大きな影響を与える可能性のある分野では、人工知能の判断根拠を理解することは非常に重要です。

人工知能を導入する際には、その目的や状況に応じて、分かりやすさと正確さのバランスを考える必要があります。例えば、商品の推薦システムなど、多少の誤りが許容される場合は、高い精度を持つ人工知能を優先しても良いでしょう。しかし、自動運転や医療診断など、高い信頼性が求められる分野では、判断根拠が分かりやすい人工知能を選択することが重要になります。人工知能の技術は日々進歩しており、高い精度と分かりやすさを両立した人工知能の開発も進められています。私たちは、それぞれの特性を理解し、適切な人工知能を選択していく必要があります。

| AIの種類 | 説明 | 例 | メリット | デメリット | 適した用途 |

|---|---|---|---|---|---|

| 判断根拠が分かりやすいAI | 人間の思考過程のように、結論に至った根拠を明確に示すAI | 健康診断の結果から病気を予測するAI | 透明性が高く、利用者の信頼を得やすい | 必ずしも高精度とは限らない | 自動運転、医療診断など、高い信頼性が求められる分野 |

| 判断根拠が分かりにくいAI | 入力データから出力結果に至るまでの過程が複雑で、人間には理解しにくいAI | 大量の画像データから猫を識別するAI | 高い精度を実現できる | 判断根拠が不明瞭なため、利用者に不安を与える可能性がある | 商品の推薦システムなど、多少の誤りが許容される場合 |

アルゴリズム選択の重要性

人工知能を使う上で、どの計算手順を選ぶかはとても大切です。まるで料理を作る際に、材料に合わせて調理法を選ぶように、人工知能の計算手順も目的や状況に合わせて適切に選ばなければなりません。

計算手順の良し悪しは、結果の正確さだけで決まるものではありません。もちろん、人工知能が出す答えがどれだけ正確かは重要です。しかし、人工知能がどのようにしてその答えを出したのか、その過程が分かることも同じくらい重要になってきています。

例えば、病気の診断やお金の取引など、人の暮らしに大きく関わる場面で人工知能を使うことを考えてみましょう。もし人工知能が誤った判断を下した場合、その理由が分からなければ、適切な対策を立てることができません。また、人工知能の判断根拠が分からなければ、人々は人工知能を信頼して使うことが難しくなります。

そのため、計算手順を選ぶ際には、結果の正確さだけでなく、その過程が分かりやすいかどうかも考慮する必要があります。分かりやすい計算手順であれば、人工知能が誤った判断をした場合でも、その原因を特定し、改善することができます。また、人々も人工知能の判断根拠を理解し、安心して使うことができます。

場合によっては、結果の正確さが少し劣っていても、過程が分かりやすい計算手順を選ぶ方が良いこともあります。特に、人の暮らしに大きな影響を与える分野では、透明性と信頼性が何よりも重要です。人工知能を使う目的や、誤った判断がもたらす危険性をよく考えて、計算手順を選ぶ必要があります。人工知能は便利な道具ですが、魔法の杖ではありません。その特徴を理解し、上手に使いこなすことが大切です。

| 項目 | 説明 |

|---|---|

| 計算手順の重要性 | 料理の調理法のように、目的や状況に合わせて適切に選ぶ必要がある |

| 評価基準 | 結果の正確さだけでなく、過程の分かりやすさも重要 |

| 過程の分かりやすさのメリット | 誤った判断の原因特定と改善、利用者の信頼感向上 |

| 透明性と信頼性 | 特に人の暮らしに大きな影響を与える分野では最優先事項 |

| 計算手順の選択基準 | 目的、誤判断のリスク、透明性、信頼性を考慮 |

説明可能なAIの未来

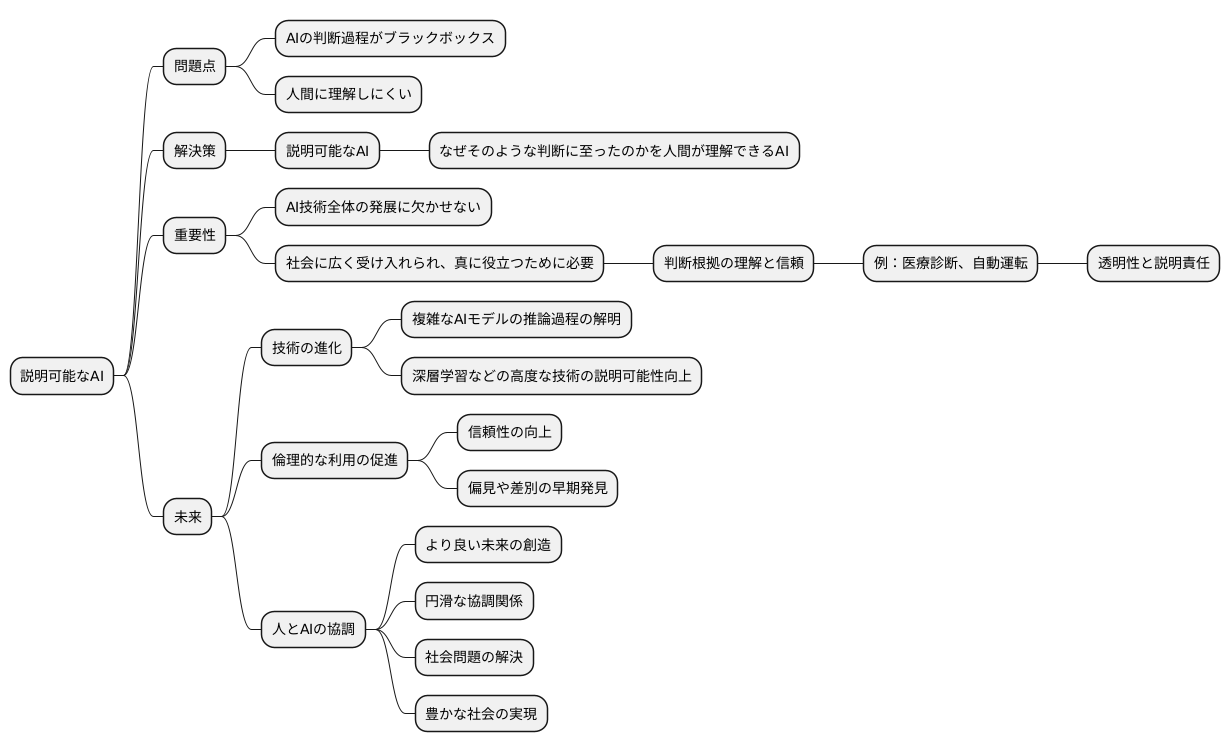

人工知能は急速に発展を遂げていますが、その複雑な判断の過程はしばしばブラックボックスと呼ばれ、人間には理解しにくいという問題を抱えています。この問題を解決するために注目されているのが、説明可能な人工知能、つまり、なぜそのような判断に至ったのかを人間が理解できる人工知能です。

説明可能な人工知能の未来は、人工知能技術全体の発展に欠かせない重要な要素です。人工知能が社会に広く受け入れられ、真に役立つものとなるためには、その判断の根拠を人間が理解し、信頼できることが必要です。人工知能がどのように結論を導き出したのかが分からなければ、たとえその結論が正しかったとしても、安心して利用することは難しいでしょう。例えば、医療診断や自動運転といった分野では、人工知能の判断が人命に関わるため、透明性と説明責任は特に重要です。

今後、説明可能な人工知能技術はますます進化し、より複雑な人工知能モデルの推論過程も解明されるようになると期待されます。これにより、これまでブラックボックスとされてきた深層学習などの高度な技術も、人間が理解できる形で説明できるようになる可能性があります。また、説明可能な人工知能は、人工知能の倫理的な利用を促進し、人工知能に対する信頼を高めることにも貢献するでしょう。人工知能がどのように判断しているのかを理解することで、偏見や差別などの倫理的な問題を早期に発見し、適切な対策を講じることが可能になります。

説明可能な人工知能は、人工知能と人間の協調を実現し、より良い未来を創造するための重要な鍵となるでしょう。人工知能が人間の思考過程を理解し、人間が人工知能の判断根拠を理解することで、より円滑な協調関係を築くことができます。人工知能の進化と共に、人間と人工知能の相互理解を深める努力が、より一層重要になっていくと考えられます。人工知能と人間が互いに理解し合い、協力することで、様々な社会問題の解決や、より豊かな社会の実現に向けて大きな進歩を遂げることが期待されます。

偏りを防ぐ

人工知能は、私たちに多くの恩恵をもたらす一方で、思わぬ落とし穴も潜んでいます。過去の情報に基づいて学習するため、その情報に偏りがあれば、人工知能も同じように偏った考え方を身につけてしまうのです。例えば、過去の採用データに男性が多く含まれていると、人工知能は男性を採用する方が良いと判断するかもしれません。これは男女の能力差ではなく、データの偏りが原因です。このような偏った判断は、社会における不平等を助長する可能性があり、大きな問題となります。

この問題に対処するために、「説明可能な人工知能」という考え方が重要になります。これは、人工知能がどのように判断を下したのか、その理由を人間が理解できるようにする技術です。人工知能の思考過程が分かれば、偏りが生じている原因を特定し、修正することができます。例えば、採用判断で男性が有利になっている理由がデータの偏りだと分かれば、その偏りを修正したデータで人工知能を再学習させることができます。

人工知能の判断根拠を明らかにすることで、私たちは偏りを防ぎ、より公平で公正なシステムを作ることができます。これは、人工知能を倫理的に活用するための重要な一歩です。人工知能は便利な道具ですが、使い方を誤ると社会に悪影響を与える可能性があります。だからこそ、常に倫理的な視点を持ち、人工知能が公正な判断を下せるように注意を払う必要があります。人工知能の力を正しく使い、より良い社会を作るためには、私たち自身の責任も問われているのです。人工知能はあくまでも道具であり、その使い方を決めるのは私たち人間です。説明可能な人工知能は、私たちが責任を持って人工知能を活用するための、強力な助けとなるでしょう。