AMSBound:学習の安定化を目指す

AIの初心者

先生、「AMSBound」って、AMSGradの学習の速さを調整するものって理解で合っていますか?

AI専門家

おおむね合っています。AMSBoundは、AMSGradの学習率に上限と下限を設けることで、学習の速さを調整しようとしたものですね。AMSGradはAdamの改良版で、Adamは最初こそ学習が速いものの、なかなか落ち着かないという欠点がありました。これを改善しようとしたのがAMSGradですが、今度は学習率が小さくなりすぎて、Adamとあまり変わらない結果になってしまったのです。

AIの初心者

なるほど。Adamは速すぎる、AMSGradは遅すぎる、それをちょうど良くしようとしたのがAMSBoundなんですね。Adamにも同じような調整をしたAdaBoundってものもあるんですか?

AI専門家

その通りです。AMSBoundはAMSGradに、AdaBoundはAdamに、同じような制限を加えたものですね。学習率の調整は機械学習においてとても重要で、様々な工夫が凝らされています。

AMSBoundとは。

ある計算機学習の用語、「エーエムエスバウンド」について説明します。エーエムエスバウンドは、「エーエムエスグラッド」という手法を改良しようとして生まれたものです。まず、「エーエムエスグラッド」について説明します。エーエムエスグラッドは「アダム」という学習方法の欠点を直そうとしたものです。アダムは学習の最初の頃は速いものの、最終的な答えにたどり着くのが遅いという問題がありました。そこでエーエムエスグラッドは学習の速さを調整することでこの問題を解決しようとしました。しかし、速すぎを防ぐことはできたものの、今度は遅すぎるせいでアダムと同じくらいの精度しか出なくなってしまいました。ここでエーエムエスバウンドは、エーエムエスグラッドの学習の速さに上限と下限を設けることで、この問題を解決しようとしたのです。ちなみに、アダムにも同じような制限を加えた「アダバウンド」という手法もあります。

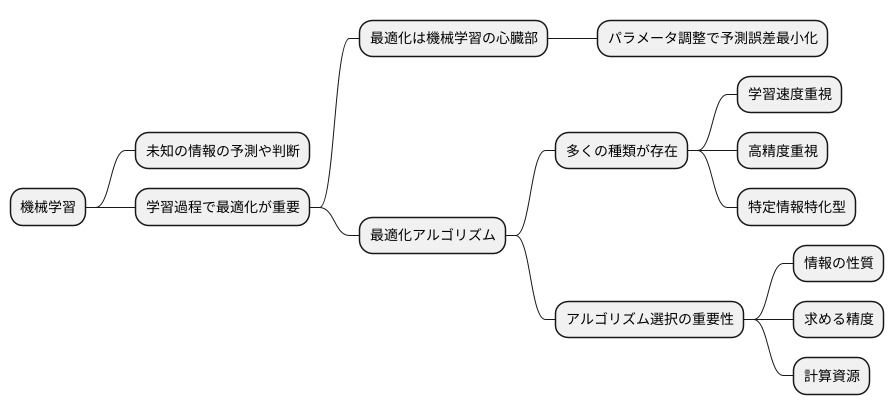

機械学習における最適化

機械学習とは、たくさんの情報から法則や繋がりを見つけ出し、まだ知らない情報に対しても予測や判断を可能にする技術です。この学習を進める過程で、予測の正確さを高めるために最適化と呼ばれる手順が欠かせません。最適化は、いわば機械学習の心臓部と言えるでしょう。

最適化は、学習の道筋を決める重要な役割を担います。具体的には、機械学習モデルの中には様々な調整できる数値(パラメータ)が存在しますが、最適化はこのパラメータを調整することで、予測の誤りを最小限にすることを目指します。ちょうど、職人が道具を微調整して最高の作品を作り上げるように、最適化もまた、パラメータを細かく調整することで、機械学習モデルの性能を最大限に引き出します。

最適化を行うための手順を最適化アルゴリズムと呼びます。様々な種類のアルゴリズムが存在し、それぞれに特徴があります。例えば、あるアルゴリズムは学習の速度が速い反面、最終的な精度はそれほど高くならないかもしれません。逆に、学習に時間はかかるものの、非常に高い精度を実現するアルゴリズムも存在します。その他にも、特定の種類の情報に特化したアルゴリズムなど、多種多様なアルゴリズムが開発されています。

どのアルゴリズムを選ぶかは、扱う情報の性質や、求める精度、そして利用できる計算資源などによって異なります。そのため、機械学習を行う際には、目的に最適なアルゴリズムを選択することが重要です。適切なアルゴリズムを選ぶことで、学習の効率を高め、より精度の高い予測を実現できるようになります。最適化アルゴリズムは、まさに機械学習の性能を左右する重要な要素と言えるでしょう。

広く使われているAdamの課題

広く使われている最適化手法の一つであるAdamは、その優れた性能から多くの機械学習の場面で採用されています。Adamは、勾配の情報を効率的に利用することで、学習の速度を向上させる工夫が凝らされています。具体的には、過去の勾配の平均と、過去の勾配の二乗の平均をそれぞれ保存し、それらを用いてパラメータの更新量を調整します。

学習の初期段階では、まだ最適なパラメータから遠い段階であるため、Adamは大きな更新量でパラメータを調整し、素早く最適な値に近づこうとします。学習が進むにつれて、最適なパラメータに近づくにつれ、Adamは更新量を徐々に小さくしていきます。こうすることで、最適なパラメータの周辺で振動することなく、滑らかに収束させることを目指します。

しかし、Adamはこの優れた特性を持つ一方で、収束性に関する課題も指摘されています。具体的には、Adamは学習の初期段階では非常に速く最適なパラメータに近づきますが、最終的には最適なパラメータに完全に収束せず、その周辺で振動を繰り返してしまう可能性があります。この振動は、Adamが過去の勾配情報を用いて更新量を調整する際に、過去の情報の偏りの影響を受けてしまうことが原因の一つと考えられます。

特に、学習データの性質が複雑であったり、モデルが複雑な場合、Adamの収束性の問題は顕著に現れる可能性があります。そのため、Adamを用いる際には、学習率や他のハイパーパラメータの調整、またはより安定した最適化手法の検討が必要となる場合があります。Adamの特性を理解し、適切に用いることで、より効果的な学習を実現できるでしょう。

| 項目 | 説明 |

|---|---|

| 概要 | 広く使われている最適化手法。勾配の平均と二乗の平均を用いてパラメータ更新量を調整し、学習速度を向上させる。 |

| 学習初期段階 | 最適なパラメータから遠い段階では大きな更新量で調整し、素早く最適値に近づこうとする。 |

| 学習進行時 | 最適なパラメータに近づくにつれ、更新量を徐々に小さくし、滑らかに収束させることを目指す。 |

| 課題 | 収束性に関する課題があり、最終的に最適なパラメータに完全に収束せず、周辺で振動を繰り返す可能性がある。 |

| 課題の原因 | 過去の勾配情報の偏りの影響を受けてしまうためと考えられる。 |

| 課題の顕著化 | 学習データやモデルが複雑な場合、収束性の問題は顕著に現れる可能性がある。 |

| 対策 | 学習率や他のハイパーパラメータの調整、またはより安定した最適化手法の検討が必要となる場合がある。 |

改良版AMSGradとその限界

広く使われている最適化手法であるAdamは、その高い学習速度にもかかわらず、特定の問題において適切な解に収束しない、つまり最適なパラメータを見つけられないという欠点がありました。この問題に対処するために、改良版としてAMSGradが提案されました。

AMSGradは、Adamが抱える収束性の問題を、過去の勾配の二乗の移動平均を用いることで解決しようと試みました。具体的には、過去の勾配の二乗の移動平均の最大値を記録しておき、それを利用して学習率を調整する仕組みを導入しました。この仕組みにより、学習率が大きくなりすぎるのを防ぎ、より安定した学習過程を実現し、最適な解への収束を促すことを目指しました。過去の勾配情報を考慮することで、現在のパラメータ更新に適した学習率を動的に決定し、発散や振動といった不安定な挙動を抑える効果が期待されました。

しかしながら、AMSGradは実際には期待されたほどの性能向上は見られず、多くの場合、Adamと同程度の精度しか達成できませんでした。これは、AMSGradが学習率を過剰に小さくしてしまう傾向があることが原因だと考えられます。学習率が小さすぎると、パラメータの更新幅が非常に小さくなり、最適なパラメータへ到達するまでに非常に長い時間を要するか、あるいは最適なパラメータに辿り着く前に学習が実質的に停止してしまう可能性があります。

つまり、AMSGradはAdamの収束性の問題を完全に解決したわけではなく、新たな課題を生み出してしまいました。学習率を適切に制御しながら安定した学習を実現する、より高度な最適化手法の開発が依然として重要な課題として残されています。より効果的な学習率調整機構の探求や、AMSGradの改良といった今後の研究の進展が期待されます。

| 手法 | 概要 | 利点 | 欠点 |

|---|---|---|---|

| Adam | 広く使われている最適化手法。高い学習速度。 | 学習速度が速い。 | 特定の問題において最適解に収束しない場合がある。 |

| AMSGrad | Adamの改良版。過去の勾配の二乗の移動平均の最大値を利用して学習率を調整。 | 学習の安定化を目指した。 | 期待された性能向上は見られず、Adamと同程度の精度。学習率を過剰に小さくする傾向がある。 |

AMSBoundによる更なる改良

学習の停滞を防ぎ、より効率的な最適化を目指す手法として、エイエムエスバウンドが開発されました。これは、先行手法であるエイエムエスグラッドが抱えていた課題を解決するために考案されたものです。エイエムエスグラッドは、学習の進み具合を調整する学習率が小さくなりすぎる問題を抱えていました。学習率は、学習の歩幅を調整する重要な要素であり、小さすぎると学習の進みが遅くなり、最適な解にたどり着くまでに時間がかかりすぎてしまいます。

エイエムエスグラッドでは、この学習率の小さくなりすぎを防ぐために、学習率の上限のみを制限していました。しかし、これだけでは不十分な場合があり、学習が停滞してしまうことがありました。そこで、エイエムエスバウンドでは、学習率に下限も設けるという改良を加えました。学習率に下限を設定することで、学習率が極端に小さくなることを防ぎ、学習の停滞を回避することができます。これにより、より良い解の探索が可能となります。

エイエムエスバウンドは、エイエムエスグラッドの優れた点である学習の安定性を維持しつつ、アダムのような積極的な探索も可能にすることで、最適化性能の向上を実現しています。アダムは、学習率を状況に応じて大きく変化させることで、より早く最適な解を見つけ出す手法ですが、学習が不安定になる場合もありました。エイエムエスバウンドは、アダムのように積極的に探索しつつも、学習率の下限を設定することで、安定した学習を実現しています。

似た手法として、エイダバウンドも挙げられます。エイダバウンドもアダムと同様に学習率に制限を加えることで、学習の安定性と効率性を高める手法です。これらの手法は、学習率の適切な調整が、機械学習の性能向上にとって非常に重要であることを示しています。適切な学習率の設定は、学習の速度と安定性を両立させる鍵であり、今後の更なる研究が期待されています。

| 手法 | 学習率 | 特徴 | 課題 |

|---|---|---|---|

| エイエムエスグラッド | 上限のみ制限 | 学習の安定性 | 学習率が小さくなりすぎ、学習が停滞 |

| エイエムエスバウンド | 上限と下限を制限 | 学習の安定性と積極的な探索 | – |

| アダム | 状況に応じて大きく変化 | 積極的な探索 | 学習が不安定になる場合あり |

| エイダバウンド | 制限あり | 学習の安定性と効率性 | – |

今後の展望と期待

機械学習の分野では、学習を効率的に進めるための手法である最適化手法の研究が盛んに行われています。より速く、より正確に学習を進めるために、様々な手法が提案され続けています。その中で、新たに注目を集めているのが「AMSBound」と呼ばれる手法です。AMSBoundは、学習の進み具合を調整する「学習率」という値に対して、上限と下限を同時に設定することで、学習の安定性と精度の向上を両立させることを目指しています。

従来の最適化手法では、学習率の設定が難しく、適切な値を見つけるのに試行錯誤が必要でした。学習率が大きすぎると、学習が不安定になり、最適な結果にたどり着かないことがあります。逆に小さすぎると、学習に時間がかかりすぎてしまい、実用的ではありません。AMSBoundは、学習率の上限と下限を定めることで、これらの問題を解決し、より安定した学習を実現する可能性を秘めています。上限を設定することで、学習が不安定になることを防ぎ、下限を設定することで、学習が停滞することを防ぎます。

今後の課題としては、様々な種類の学習モデルやデータの組み合わせに対して、AMSBoundの性能を検証していく必要があります。これにより、AMSBoundが実際にどの程度有効なのかを確かめることができます。また、AMSBoundの理論的な仕組みをより深く掘り下げていくことも重要です。理論的な解析によって、なぜAMSBoundが有効なのかを理解し、更なる改良のヒントを得ることができると期待されます。

機械学習の進歩には、最適化手法の進化が欠かせません。AMSBoundのような新しい手法の登場は、機械学習全体の進歩を加速させる重要な一歩となるでしょう。今後、更なる研究と改良によって、AMSBoundが機械学習の様々な分野で活躍することを期待します。

| 手法名 | 特徴 | メリット | 課題 |

|---|---|---|---|

| AMSBound | 学習率に上限と下限を設定 | 学習の安定性と精度の向上、学習速度の最適化 | 様々なモデル・データでの性能検証、理論的解析 |