位置エンコーディングとは?Transformerに順序を教える仕組み

AIの初心者

先生、「位置エンコーディング」って何ですか? Transformerで使うと聞きました。

AI専門家

位置エンコーディングは、文章の中で各単語やトークンが何番目にあるのかを、モデルに伝えるための数値情報だよ。Transformerは単語同士の関係を見るのが得意だけれど、そのままだと順番の情報を持ちにくい。そこで位置情報を足してあげるんだ。

AIの初心者

単語の意味だけでは足りないんですね。

AI専門家

その通り。「犬が猫を追う」と「猫が犬を追う」は同じ単語を使っていても意味が違うよね。位置エンコーディングは、こうした語順の違いをモデルが扱えるようにするための重要な部品なんだ。

位置エンコーディングとは

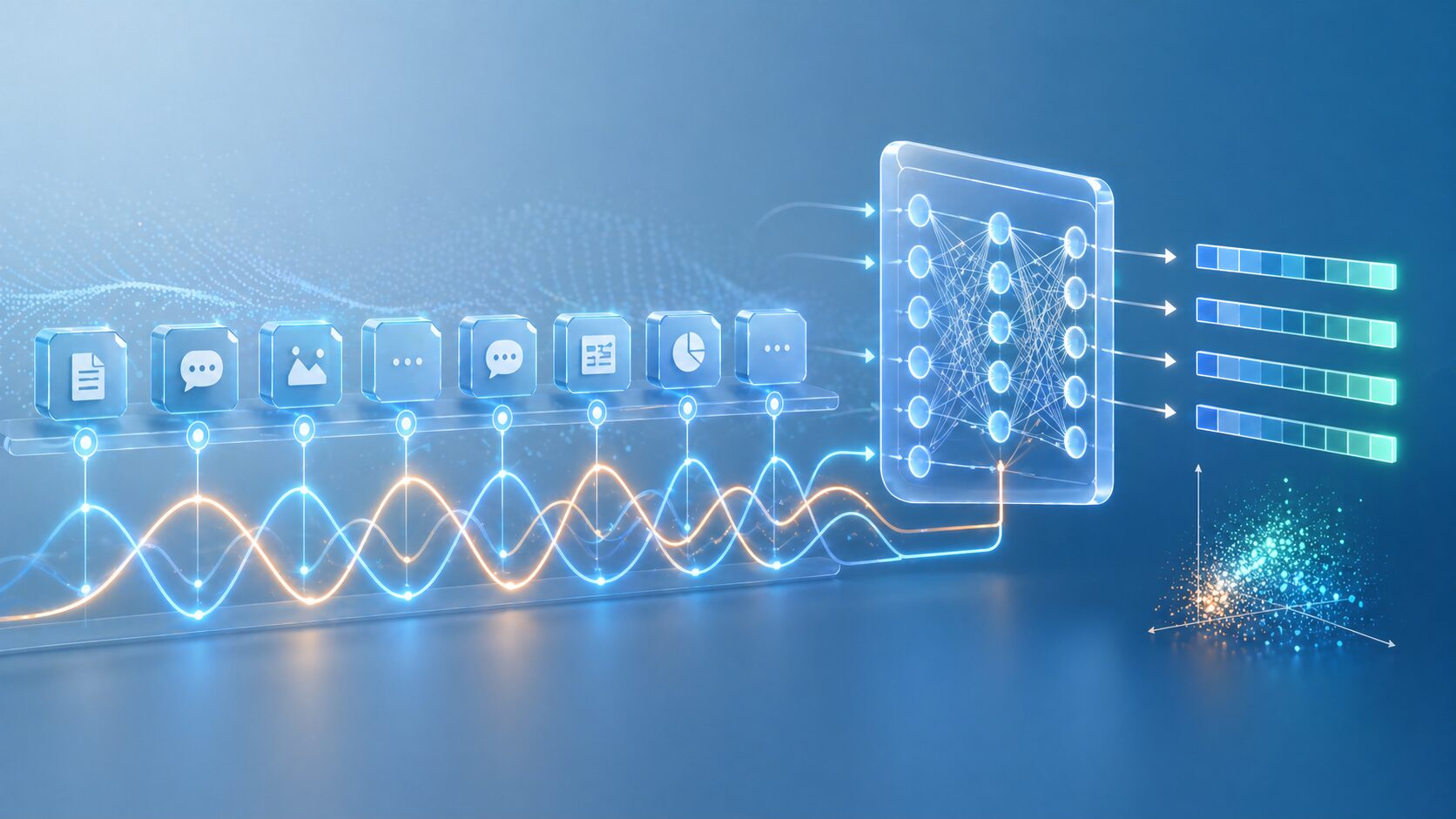

位置エンコーディングとは、文章や系列データの中で、各トークンがどの位置にあるかを数値ベクトルとして表す仕組みです。TransformerはSelf-Attentionによってトークン同士の関係を計算しますが、そのままでは並び順の情報が弱くなります。そこで、単語の意味を表す埋め込みベクトルに位置情報を加え、語順や距離を考慮できるようにします。

なぜ位置情報が必要なのか

文章の意味は、単語の種類だけでなく並び順にも左右されます。「太郎が花子を助けた」と「花子が太郎を助けた」では、同じ単語が使われていても、助けた人と助けられた人が入れ替わります。言語モデルが文章を正しく扱うには、単語の意味だけでなく、どの順番で現れたかも理解する必要があります。

従来のRNNやLSTMは、系列を左から右へ順番に処理するため、構造上、順序情報を扱いやすいモデルでした。一方、TransformerはSelf-Attentionを使って、文章中のトークン同士の関係を並列に計算します。並列に処理できるのは大きな利点ですが、単語を順番に読む構造ではないため、別途位置情報を与える必要があります。

位置エンコーディングは、その不足を補うための仕組みです。各トークンの埋め込みベクトルに位置を表すベクトルを加えることで、モデルは「この単語は文頭に近い」「この単語は前の単語から2つ離れている」といった情報を利用できるようになります。

| 観点 | 位置情報がない場合 | 位置情報がある場合 |

|---|---|---|

| 語順 | 同じ単語の集合を区別しにくい。 | 単語の並び順を考慮できる。 |

| 文法関係 | 主語・目的語などの関係を誤りやすい。 | 前後関係から役割を判断しやすい。 |

| 長い文 | 離れた単語同士の距離感を扱いにくい。 | 位置や距離を手がかりに文脈を扱える。 |

| Transformer | Self-Attentionだけでは順序情報が弱い。 | Attentionに語順の手がかりを加えられる。 |

単語埋め込みとの関係

自然言語処理では、単語やトークンをそのまま文字列として扱うのではなく、ベクトルと呼ばれる数値の列に変換します。これを単語埋め込み、またはトークン埋め込みと呼びます。単語埋め込みは、単語の意味や使われ方を数値で表したものです。

ただし、単語埋め込みだけでは、その単語が文章のどこに出てきたかは分かりません。同じ「猫」という単語は、文頭にあっても文末にあっても、基本的には同じ意味ベクトルになります。そこで、位置エンコーディングを加えます。

Transformerでは、一般にトークン埋め込みと位置エンコーディングを足し合わせたベクトルを入力として使います。これにより、モデルは「何の単語か」と「どこにある単語か」を同時に扱えるようになります。

| 情報 | 表すもの | 例 |

|---|---|---|

| トークン埋め込み | 単語や記号の意味・特徴。 | 「猫」「走る」「。」などが持つ意味情報。 |

| 位置エンコーディング | 系列内の位置や順序。 | 1番目、2番目、直前からの距離など。 |

| Transformerへの入力 | 意味情報と位置情報を組み合わせたもの。 | 「3番目に出てきた猫」のような情報を表せる。 |

代表的な種類

位置エンコーディングにはいくつかの方式があります。代表的なのは、固定された数式で位置ベクトルを作る方法と、学習によって位置ベクトルを調整する方法です。また、トークンの絶対的な位置を見る方式と、トークン同士の相対的な距離を見る方式もあります。

初期のTransformerで有名なのは、サイン関数とコサイン関数を使う固定型の位置エンコーディングです。これは、位置ごとに異なる波形の値を作り、各トークンに加える方法です。学習しなくても位置ベクトルを作れるため、仕組みが明確で、長さの違う系列にも一定の対応力があります。

一方、学習型の位置埋め込みでは、位置ごとのベクトルをモデルが学習します。タスクやデータに合わせて柔軟に調整できる反面、学習時に見ていない長さの系列への対応には注意が必要です。近年は、相対位置エンコーディングやRoPEのように、位置関係をより扱いやすくする方式も広く使われています。

| 方式 | 特徴 | 向いている場面 |

|---|---|---|

| 固定型位置エンコーディング | サイン・コサインなどの数式で位置情報を作る。 | 仕組みを明確にし、学習パラメータを増やしたくない場合。 |

| 学習型位置埋め込み | 位置ごとのベクトルを学習で最適化する。 | 学習データの長さやタスクに合わせて調整したい場合。 |

| 絶対位置エンコーディング | 文頭から何番目かを表す。 | 固定長に近い入力や、位置そのものが重要なタスク。 |

| 相対位置エンコーディング | トークン同士の距離や前後関係を表す。 | 長文や、相対的な距離が重要なタスク。 |

| RoPE | 回転行列の考え方で相対的な位置関係を扱う。 | 近年の大規模言語モデルで長い文脈を扱う場合。 |

サイン・コサイン方式の考え方

サイン・コサイン方式では、位置ごとに異なる波の値を作ります。文章中の1番目、2番目、3番目といった位置に対して、複数の周期を持つ波の値を組み合わせ、位置を表すベクトルを作ります。低い周波数の波は大まかな位置を、高い周波数の波は細かな位置の違いを表しやすくなります。

この方式の利点は、位置が数式で決まることです。学習データから位置ベクトルを覚えるのではなく、任意の位置に対して計算できます。また、波の性質により、位置同士の距離や関係をモデルが学習しやすいという利点があります。

ただし、実務でモデルを使うときに、利用者がこの数式を毎回意識する必要はありません。重要なのは、位置エンコーディングが単語の意味ベクトルに順序の手がかりを足しているという点です。数式はそのための一つの実装方法です。

| 要素 | 意味 |

|---|---|

| 位置 | トークンが系列の何番目にあるか。 |

| 次元 | 位置ベクトルの各要素。複数の波を組み合わせるために使う。 |

| サイン波・コサイン波 | 位置によって変化する値を作るための関数。 |

| 周波数 | 大まかな位置と細かな位置の違いを表すために変化させる。 |

どんなタスクで重要か

位置エンコーディングは、文章を扱う多くのタスクで重要です。機械翻訳では、語順が変わると主語や目的語が入れ替わることがあります。文章要約では、前半で説明された内容と後半の結論の関係を理解する必要があります。質問応答では、質問に対応する根拠が文書のどこにあるかが重要になります。

文章生成でも、位置情報は欠かせません。生成済みの単語と次に生成する単語の関係を把握するには、これまでの語順を考慮する必要があります。位置情報が弱いと、文のつながりが不自然になったり、長い文章で前後関係を見失ったりしやすくなります。

また、位置エンコーディングの考え方は、テキスト以外にも応用されます。画像をパッチに分けて処理するVision Transformerでは、各パッチが画像のどこにあるかを伝える必要があります。音声や時系列データでも、時点の順序や距離を扱うために位置情報が重要になります。

| タスク | 位置情報が必要な理由 |

|---|---|

| 機械翻訳 | 語順や係り受けを考慮して訳す必要がある。 |

| 文章要約 | 文章全体の流れや、重要情報の位置を扱う必要がある。 |

| 文章生成 | これまで生成した単語の順序をもとに次を予測する。 |

| 質問応答 | 質問と根拠文書の該当箇所を対応づける。 |

| 画像・音声・時系列 | 空間上の位置や時間上の順序を表す必要がある。 |

理解するときの注意点

位置エンコーディングは、「単語に番号を振るだけ」の仕組みではありません。番号をそのまま足すのではなく、モデルが扱いやすいベクトルとして位置情報を表現します。これにより、単語の意味情報と同じ空間で位置情報を扱えるようになります。

また、位置エンコーディングには複数の方式があり、どれが常に最適というわけではありません。固定型、学習型、相対位置、RoPEなどは、それぞれモデル構造や扱う文脈長によって向き不向きがあります。大規模言語モデルでは、長い文脈を扱うために位置表現の工夫が特に重要です。

さらに、位置情報を入れれば文脈理解が完全になるわけでもありません。語順は重要な手がかりですが、意味理解には学習データ、モデルサイズ、Attentionの設計、推論方法なども関係します。位置エンコーディングは、Transformerが系列を扱うための基礎的な部品として理解するとよいでしょう。

まとめ

位置エンコーディングとは、文章や系列の中で各トークンがどの位置にあるかを、モデルに伝えるための数値表現です。TransformerはSelf-Attentionでトークン同士の関係を並列に計算しますが、そのままでは語順の情報が弱いため、位置情報を加える必要があります。

代表的な方式には、サイン・コサインを使う固定型、学習によって位置ベクトルを調整する学習型、トークン同士の距離に注目する相対位置エンコーディング、RoPEなどがあります。いずれも、モデルに「何があるか」だけでなく「どこにあるか」を伝えるための仕組みです。

位置エンコーディングを理解すると、Transformerがなぜ文章の順序を扱えるのか、機械翻訳や文章生成でなぜ語順が重要なのかを把握しやすくなります。現代の自然言語処理や生成AIを理解するうえで、押さえておきたい基本概念です。

更新履歴

| 日付 | 内容 |

|---|---|

| 2026年4月2日 | 位置エンコーディングの定義、Transformerで必要な理由、種類、サイン・コサイン方式、活用例を中心に本文を全面的に見直しました。 |