強化学習におけるQ値の重要性

AIの初心者

先生、「Q値」ってなんですか?難しそうでよくわからないです。

AI専門家

そうだね、少し難しいけど、簡単に言うと「ある行動をとった時の良さの値」だよ。例えば、ゲームで敵を倒す時、剣で攻撃するのと魔法で攻撃するのとどちらが良いか、それぞれの行動に点数をつけると考えよう。その点数がQ値だよ。

AIの初心者

なるほど。点数がQ値なんですね。じゃあ、高い方が良いんですか?

AI専門家

その通り!Q値が高いほど、その行動が良い行動だと判断できるんだ。AIは学習を通して、Q値が最大になる行動を見つけるように学習していくんだよ。

Q値とは。

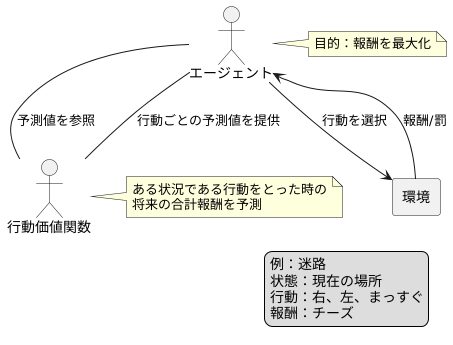

人工知能の分野で、特に強化学習においては「行動価値関数」というものが重要になります。この関数は、ある行動をとったときの価値を数値で表すもので、式の頭文字をとって「Q値」と呼ばれています。このQ値が最大になるように調整できれば、最適な行動が取れたと言えるのです。

行動価値関数

学び続ける機械である強化学習は、試行錯誤を通して賢くなります。この学習の主人公であるエージェントは、周りの環境の中で様々な行動を選びます。そして、選んだ行動の結果に応じて、ご褒美をもらったり、罰を受けたりします。このご褒美を最大にするための、一番良い行動の選び方を学ぶことが、強化学習の目的です。

では、エージェントはどうやって一番良い行動を見つけるのでしょうか?ここで登場するのが「行動価値関数」です。

行動価値関数は、ある状況で特定の行動をとった時に、将来にわたってどれだけの合計のご褒美がもらえるかを予想する関数です。例えば、迷路にいるネズミを想像してみてください。ネズミは、現在の場所(状態)で、右に行く、左に行く、まっすぐ行く(行動)などの選択肢の中から一つを選びます。行動価値関数は、それぞれの選択肢に対して、将来どれだけのチーズ(ご褒美)を食べられるかを予測します。右に行けば10グラム、左に行けば5グラム、まっすぐ行けば1グラムといった具合です。

エージェントは、この行動価値関数の予測値に基づいて行動を選びます。つまり、最も多くのチーズを食べられると予測される方向へ進むわけです。もちろん、最初の予測は外れることもあります。しかし、エージェントは何度も迷路に挑戦し、実際にもらえたチーズの量と、行動価値関数の予測値を比較することで、予測の精度を上げていきます。

このように、行動価値関数をより正確に予測できるように調整していくことで、エージェントはどの行動が一番良いかを判断し、最適な行動の選び方を学習していくのです。まさに、強化学習の中核を担う重要な考え方と言えるでしょう。

Q値の定義

{「行動価値関数」とは、ある状況と行動の組み合わせに対して、将来どれだけの報酬が得られるかを予測した数値のことです。この数値こそが「Q値」と呼ばれるものです。言い換えれば、Q値とは、特定の状況で特定の行動をとった場合に、最終的に得られると予想される報酬の合計値です。

たとえば、迷路ゲームを考えてみましょう。現在の状況(自分の位置)と行動(上下左右の移動)の組み合わせごとに、Q値が計算されます。ゴールに近い場所ほど、ゴールに向かう行動のQ値は高くなります。逆に、ゴールから遠ざかる行動のQ値は低くなります。

Q値は、状況「s」と行動「a」を使って、「Q(s, a)」と表記されます。これは、状況「s」において行動「a」をとった場合の価値を意味します。「強化学習」と呼ばれる学習方法は、このQ値をより正確に推定、あるいは近似することを目的としています。

もしも、すべての状況と行動の組み合わせについて、完全に正確なQ値が分かれば、迷路の例では、常にゴールまでの最短経路を選択できます。つまり、どのような状況でも、最も高いQ値を持つ行動を選択することで、最終的に最大の報酬を得ることができるのです。このように、強化学習においてQ値は、エージェントが最適な行動を決定するための重要な指標となっています。

| 用語 | 説明 | 表記 | 例(迷路ゲーム) |

|---|---|---|---|

| 行動価値関数 | ある状況と行動の組み合わせに対して、将来どれだけの報酬が得られるかを予測した数値。 | – | – |

| Q値 | 特定の状況で特定の行動をとった場合に、最終的に得られると予想される報酬の合計値。行動価値関数と同義。 | Q(s, a) | ゴールに近い場所ほど、ゴールに向かう行動のQ値は高くなる。ゴールから遠ざかる行動のQ値は低くなる。 |

| s | 状況 | – | 迷路における自分の位置 |

| a | 行動 | – | 上下左右の移動 |

| 強化学習 | Q値をより正確に推定、あるいは近似することを目的とした学習方法。 | – | – |

Q値の最適化

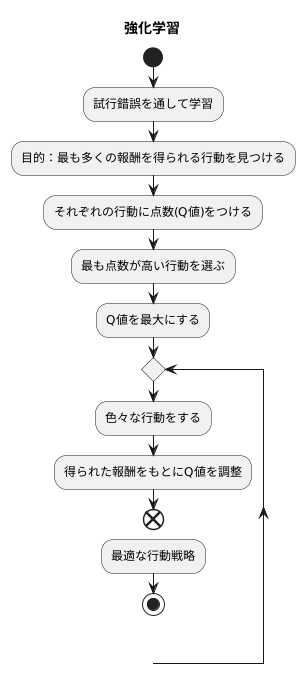

強化学習とは、試行錯誤を通して学習する仕組みのことです。目的は、最も多くの報酬を得られる行動を見つけることです。どのようにして行動を決めるかというと、それぞれの行動に点数をつけ、最も点数が高い行動を選びます。この点数のことをQ値と呼びます。

Q値を最大にすることが、強化学習の目標とも言えます。なぜなら、Q値が最大になっている状態は、あらゆる場面で最も多くの報酬を得られる行動を選んでいる状態だからです。

では、どのようにしてQ値を最大にするのでしょうか。Q学習と呼ばれる手法では、実際に色々な行動をしてみて、その結果得られた報酬をもとにQ値を調整していきます。行動の結果、多くの報酬が得られればQ値を高くし、逆に報酬が少なければQ値を低くします。

このQ値の調整は、繰り返し行われます。まるで、迷路の中で出口を探すように、最初は手探りで行動しますが、徐々にどの道が正解に近づくのかを学習していくのです。そして最終的には、どの場面でも最も高いQ値を持つ行動を選べるようになり、最適な行動戦略を手に入れることができます。

このように、環境とのやり取りの中で得られた報酬を手がかりに、Q値を繰り返し調整していくことで、まるで人間が経験を通して学習するように、機械も最適な行動を学習していくことができるのです。

適切な行動の選択

私たちは日々、様々な状況で選択を迫られています。朝ごはんは何を食べるか、どの服を着ていくか、どの道を通って仕事に行くかなど、大小様々な決定を繰り返しています。これらの選択の中で、より良い結果に繋がる行動を選ぶためには、過去の経験や知識に基づいて判断することが重要です。

人工知能の世界では、この適切な行動の選択を「強化学習」という方法で実現しています。強化学習では、ある状況における行動の価値を「価値関数」という数値で評価します。この価値関数を最大化する行動を選ぶことで、目的とする結果を得ようとするのです。

価値関数の代表的な例として「Q値」というものがあります。Q値は、特定の状況で特定の行動をとった場合に、将来どれだけの報酬が得られるかを予測した値です。例えば、ゲームで敵に遭遇した状況を考えましょう。この時、「攻撃する」「逃げる」「防御する」といった選択肢があるとします。それぞれの行動に対するQ値が高いほど、その行動が成功に繋がり、高い得点を得られる可能性が高いことを意味します。

強化学習では、試行錯誤を通じてQ値を学習し、最適な行動を導き出します。最初はランダムな行動をとり、その結果得られた報酬に基づいてQ値を更新していきます。成功体験を繰り返すことで、Q値の高い行動が強化され、失敗体験を通じてQ値の低い行動は修正されていきます。

Q値が最適化されれば、どんな状況でも最も効果的な行動を自動的に選択できるようになります。ゲームのプレイだけでなく、自動運転やロボット制御など、様々な分野で応用が期待されています。適切な行動を選択する能力は、人工知能がより高度な問題を解決するための鍵となるでしょう。

| 概念 | 説明 | 例 |

|---|---|---|

| 日常の選択 | 日々様々な状況で選択を迫られている | 朝ごはん、服装、通勤経路 |

| 良い選択 | 過去の経験や知識に基づいて判断 | |

| 強化学習 | AIが適切な行動を選択する方法 | |

| 価値関数 | ある状況における行動の価値を数値化したもの | |

| Q値 | 特定の状況と行動における将来の報酬予測値 | ゲームで敵に遭遇した時、「攻撃」「逃げる」「防御」 |

| Q値の学習 | 試行錯誤を通じてQ値を更新、最適な行動を導出 | |

| Q値の最適化 | どんな状況でも最も効果的な行動を自動選択 | ゲーム、自動運転、ロボット制御 |

Q学習

「キュー学習」は、人工知能が試行錯誤を通じて学習する「強化学習」の中でも、特に代表的な学習方法です。この学習方法は、将来得られるであろう報酬を予測し、その予測値を基に行動を決定する方法です。この予測値は「キュー値」と呼ばれ、現在の状態と、その状態で行う行動の組み合わせごとに、どれだけの報酬が期待できるかを示しています。

キュー学習は、「時間差分学習」という考え方に基づいています。これは、現在の状態での行動の良し悪しを、次の状態での予測に基づいて判断するというものです。具体的には、ある行動をとった後、次の状態に遷移し、そこで得られる報酬と、その次の状態での最も高いキュー値を使って、現在の状態でのキュー値を更新します。

たとえば、迷路を解くロボットを想像してみてください。ロボットは、各交差点で、上下左右のどの道に進むかを選択できます。キュー学習では、各交差点でどの道を選ぶべきかを判断するためにキュー値を使います。ロボットが道を選択し、次の交差点に進んだとき、そこで得られる報酬(例えば、ゴールに近づけば高い報酬、遠ざかれば低い報酬)と、その次の交差点における最も高いキュー値を用いて、一つ前の交差点での選択した道のキュー値を更新します。つまり、将来の予測に基づいて過去の判断を修正していくのです。

この学習過程を何度も繰り返すことで、キュー値は徐々に最適な値に近づいていきます。最終的には、各状態でどの行動をとれば最も多くの報酬を得られるかを、正確に予測できるようになります。キュー学習の大きな利点は、「モデルフリー」であるという点です。つまり、迷路全体の形や、ゴールまでの道筋など、環境の全体像を知らなくても学習できるということです。そのため、様々な状況に柔軟に対応できる、汎用性の高い学習方法と言えます。

| キュー学習 | 強化学習の一種で、試行錯誤を通じて学習する。将来の報酬予測(キュー値)に基づいて行動決定を行う。 |

|---|---|

| キュー値 | 現在の状態と行動の組み合わせごとに期待される報酬の予測値。 |

| 時間差分学習 | 現在の行動の良し悪しを次の状態の予測に基づいて判断する学習方法。 |

| 学習プロセス | 1. ロボットが行動を選択 2. 次の状態に遷移し報酬を得る 3. 次の状態の最高のキュー値と報酬を用いて、前の状態でのキュー値を更新 4. この過程を繰り返し、キュー値を最適化 |

| 利点 | モデルフリーであるため、環境の全体像を知らなくても学習可能。様々な状況に柔軟に対応できる。 |

強化学習における重要性

強化学習とは、試行錯誤を通じて学習する機械学習の一種です。あたかも動物が報酬を得る行動を繰り返すように、学習主体である「エージェント」が環境と相互作用しながら、報酬を最大化する行動方針を学習します。この学習過程において、中心的な役割を果たすのが「行動価値関数」、すなわちQ値です。

Q値は、特定の状態において、特定の行動をとった場合に、将来にわたって得られるであろう累積報酬の期待値を表します。言い換えれば、ある状況でどの行動を選ぶのが最も良いかを数値化したものと言えるでしょう。エージェントは、このQ値を基に、現状で最も価値の高い行動を選択するのです。

Q値を最適化することで、エージェントは最適な行動戦略を学習できます。最適なQ値が分かれば、どの状態でも、どの行動をとれば最も多くの報酬を得られるかが分かるからです。例えば、ロボットの制御では、Q値を用いることで、ロボットは転倒せずに効率的に移動する方法を学習できます。ゲームプレイでは、高得点を得るための戦略を学習できます。資源管理では、限られた資源を最大限に活用する方法を学習できます。

このように、強化学習はロボット制御、ゲームプレイ、資源管理など、様々な分野で応用されています。これらの応用において、Q値は最適な行動決定を行うための基礎となります。Q値を深く理解することは、強化学習の仕組みを理解する上で非常に重要です。さらに、より高度な強化学習の仕組みを考え出すことにも繋がります。そのため、強化学習を学ぶ上では、Q値の概念をしっかりと理解することが不可欠と言えるでしょう。

| 強化学習 | 試行錯誤を通じて、報酬を最大化する行動方針を学習する機械学習の一種。 |

|---|---|

| エージェント | 学習主体。環境と相互作用しながら学習する。 |

| 行動価値関数(Q値) | 特定の状態と行動における、将来にわたって得られる累積報酬の期待値。どの行動が最も良いかを数値化したもの。 |

| Q値の役割 | エージェントが現状で最も価値の高い行動を選択するための基準。最適化することで最適な行動戦略を学習できる。 |

| 応用例 |

|

| Q値の重要性 | 強化学習の仕組みを理解し、より高度な仕組みを考え出すための基礎。 |