確率的勾配降下法:機械学習の要

AIの初心者

先生、「確率的勾配降下法」って、結局どういう意味ですか?難しくてよくわからないです。

AI専門家

そうですね、少し難しいですね。簡単に言うと、AIの学習方法の一つで、データを使ってAIの性能を少しずつ良くしていく方法です。山を下ることを想像してみてください。頂上から一番早く下るには、常に一番急な斜面を下ればいいですよね。この一番急な斜面を探すのに、確率的勾配降下法を使うんです。

AIの初心者

なるほど。でも、どうして「確率的」なんですか?

AI専門家

それは、全てのデータを使うと大変だから、毎回ランダムに選んだデータだけを使って、どの向きに進むべきか(勾配)を決めているからです。ランダムに選ぶことで、計算が速くなるし、より良い結果にたどり着く可能性も高くなるんですよ。

確率的勾配降下法とは。

人工知能の分野でよく使われる『確率的勾配降下法』について説明します。これは、一番急な坂を下るようにして最適な値を探す『最急降下法』の仲間です。

最急降下法は、全てのデータを使って毎回坂の傾きを計算し、最適な値に近づけていきます。しかし、この方法だと、一番低い谷(最適な値)ではなく、途中の小さな谷(局所解)に捕まってしまうことがあります。

一方、確率的勾配降下法は、ランダムに選んだ一つのデータだけを使って坂の傾きを計算し、最適な値に近づけていきます。この作業をデータの数だけ繰り返します。ランダムにデータを選ぶので、たとえ途中の小さな谷に捕まっても、次のデータによってそこから抜け出せる可能性があります。

また、一度に一つのデータしか使わないので、計算量も少なくて済みます。

はじめに

機械学習とは、大量のデータから規則性やパターンを見つけ出し、それを元に未知のデータに対する予測や判断を行う技術です。まるで人間が経験から学ぶように、機械もデータから学習し、賢くなっていくのです。この学習プロセスで重要な役割を担うのが、確率的勾配降下法と呼ばれる手法です。

膨大なデータから最適な予測モデルを作るためには、まずモデルの良し悪しを評価する必要があります。この評価指標は損失関数と呼ばれ、損失関数の値が小さいほど、精度の高いモデルと言えます。確率的勾配降下法は、この損失関数の値を最小にするために、モデルのパラメータを少しずつ調整していく手法です。

具体的には、ランダムに選んだ一部のデータを使って損失関数の勾配を計算し、その勾配が示す方向とは反対の方向にパラメータを更新します。これを何度も繰り返すことで、徐々に損失関数の値が小さくなり、最適なパラメータに近づいていきます。この手法は、全てのデータを使う最急降下法に比べて計算量が少なく、効率的に学習を進められるという利点があります。

しかし、確率的勾配降下法は、ランダムにデータを選ぶため、更新ごとに最適な方向からずれる可能性があります。そのため、学習過程が安定せず、最適な解にたどり着くまでに時間がかかる場合もあります。それでも、計算効率の良さから、大規模なデータセットを扱う現代の機械学習においては、非常に重要な手法となっています。

このように、確率的勾配降下法は、機械学習の基盤を支える重要な技術です。この手法を理解することで、機械学習の仕組みをより深く理解し、その可能性を最大限に引き出すことができるでしょう。

| 用語 | 説明 |

|---|---|

| 機械学習 | 大量のデータから規則性やパターンを見つけ出し、それを元に未知のデータに対する予測や判断を行う技術 |

| 確率的勾配降下法 | 損失関数の値を最小にするために、モデルのパラメータを少しずつ調整していく手法 |

| 損失関数 | モデルの良し悪しを評価する指標。値が小さいほど、精度の高いモデル。 |

| 確率的勾配降下法の利点 | 全てのデータを使う最急降下法に比べて計算量が少なく、効率的に学習を進められる。 |

| 確率的勾配降下法の欠点 | ランダムにデータを選ぶため、更新ごとに最適な方向からずれる可能性があり、学習過程が安定せず、最適な解にたどり着くまでに時間がかかる場合もある。 |

| 確率的勾配降下法の重要性 | 計算効率の良さから、大規模なデータセットを扱う現代の機械学習においては、非常に重要な手法。 |

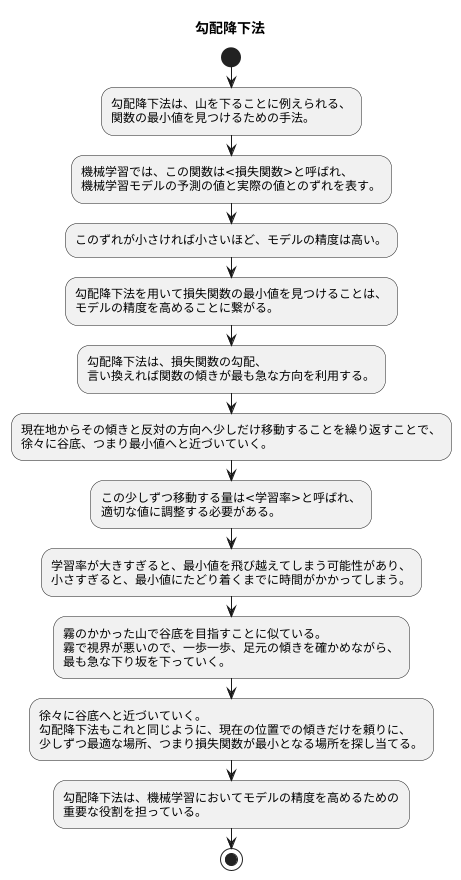

勾配降下法の仕組み

勾配降下法は、山を下ることに例えられる、関数の最小値を見つけるための手法です。機械学習の分野では、この関数は損失関数と呼ばれ、機械学習モデルの予測の値と実際の値とのずれを表します。このずれが小さければ小さいほど、モデルの精度は高いと言えます。つまり、勾配降下法を用いて損失関数の最小値を見つけることは、モデルの精度を高めることに繋がります。

では、どのようにして最小値を見つけるのでしょうか。勾配降下法は、損失関数の勾配、言い換えれば関数の傾きが最も急な方向を利用します。現在地からその傾きと反対の方向へ少しだけ移動することを繰り返すことで、徐々に谷底、つまり最小値へと近づいていきます。この少しずつ移動する量は学習率と呼ばれ、適切な値に調整する必要があります。学習率が大きすぎると、最小値を飛び越えてしまう可能性があり、小さすぎると、最小値にたどり着くまでに時間がかかってしまいます。

この一連の動作は、霧のかかった山で谷底を目指すことに似ています。霧で視界が悪いので、一歩一歩、足元の傾きを確かめながら、最も急な下り坂を下っていきます。そして、徐々に谷底へと近づいていくのです。勾配降下法もこれと同じように、現在の位置での傾きだけを頼りに、少しずつ最適な場所、つまり損失関数が最小となる場所を探し当てます。このように、勾配降下法は、機械学習においてモデルの精度を高めるための重要な役割を担っています。

確率的勾配降下法の利点

確率的勾配降下法は、機械学習のモデルを訓練する際に広く用いられる強力な手法です。この手法は、勾配降下法を改良したもので、モデルのパラメータを調整することで、予測の誤差を最小化することを目指します。勾配降下法では、全ての訓練データを一度に用いてパラメータの更新量(勾配)を計算しますが、確率的勾配降下法はランダムに選んだ一つのデータだけを用います。

この違いが、確率的勾配降下法の大きな利点につながります。まず、計算量が大幅に削減されます。訓練データ全体を毎回処理する必要がないため、特に大規模なデータセットを扱う場合、計算時間と計算資源を節約できます。膨大なデータの処理が必要な現代の機械学習では、この効率性の高さは非常に重要です。

さらに、確率的勾配降下法は、局所最適解に陥りにくいという特性も持ちます。局所最適解とは、全体で見れば最適ではないものの、その近傍では最適に見える点のことです。勾配降下法は、この局所最適解に捕らわれやすい傾向があります。一方、確率的勾配降下法は、ランダムにデータを選択するため、パラメータの更新にランダム性が生じます。このランダム性のおかげで、局所最適解から抜け出し、より良い大域的最適解に近づく可能性が高まります。

このように、計算の効率性と局所最適解からの脱出という二つの大きな利点を持つ確率的勾配降下法は、複雑なデータのパターンを学習する上で非常に強力な手法と言えるでしょう。

| 手法 | データ使用 | 計算量 | 局所最適解 | その他 |

|---|---|---|---|---|

| 勾配降下法 | 全データ | 大 | 陥りやすい | – |

| 確率的勾配降下法 | ランダムに選んだ1データ | 小 | 陥りにくい | ランダム性、強力な手法 |

確率的勾配降下法の欠点

確率的勾配降下法は、機械学習の分野で広く使われている最適化手法です。たくさんの利点がある一方で、いくつか欠点も抱えています。以下、その欠点について詳しく説明します。

第一に、パラメータ更新の不安定さが挙げられます。確率的勾配降下法は、毎回一つのデータ、もしくは少数のデータだけを使って勾配を計算します。そのため、計算された勾配には、データの偏りによる「雑音」が多く含まれることになります。この雑音の影響で、パラメータの更新方向が最適な方向からずれてしまい、学習の過程でパラメータの値が大きく振動してしまうことがあります。まるででこぼこ道を進む自転車のように、目標値にまっすぐ近づけず、何度も行ったり来たりを繰り返してしまうのです。この不安定さは、学習の効率を悪くするだけでなく、最終的に得られるモデルの精度にも悪影響を及ぼす可能性があります。

第二に、学習の進み具合が不均一になる可能性があります。確率的勾配降下法は、毎回ランダムに選ばれたデータを使って学習を進めます。そのため、データの選び方によっては、ある時期は学習が早く進み、別の時期は学習が遅くなってしまう、といった状況が発生することがあります。これは、まるで栄養バランスの悪い食事を摂るように、モデルの成長を阻害する要因となります。

第三に、局所最適解に陥りやすいという問題も挙げられます。複雑なモデルでは、最適解が複数存在するケースがあります。確率的勾配降下法は、雑音の影響を受けやすいので、真の最適解ではなく、局所的な最適解に捕まってしまう可能性があります。一度局所最適解に陥ってしまうと、そこから抜け出すことは難しく、モデルの性能が向上しにくくなります。

これらの欠点を軽減するために、様々な改良手法が提案されています。例えば、ミニバッチ勾配降下法は、一度に複数のデータを使って勾配を計算することで、雑音の影響を小さくし、学習の安定化を図っています。また、モーメンタム法やAdamなどの最適化手法は、過去の勾配情報を活用することで、振動を抑制し、より効率的に最適解へと近づける工夫が凝らされています。

| 欠点 | 説明 | 例え |

|---|---|---|

| パラメータ更新の不安定さ | 1データずつ、または少数のデータで勾配計算するため、データの偏りによる”雑音”で更新方向が最適値からずれてパラメータ値が大きく振動する。 | でこぼこ道を進む自転車のように目標値にまっすぐ近づかず、行ったり来たりを繰り返す。 |

| 学習の進み具合が不均一 | ランダムに選ばれたデータで学習するため、データの選び方によっては学習速度にムラが出る。 | 栄養バランスの悪い食事を摂るように、モデルの成長を阻害する。 |

| 局所最適解に陥りやすい | 雑音の影響を受けやすいので、真の最適解ではなく局所最適解に捕まり、抜け出せなくなる。 | (例えなし) |

最急降下法との違い

最急降下法は、谷底を目指す登山家のように、全体を見渡しながら慎重に下山していく方法と言えるでしょう。目的地までの道のりは、現在地点から見て最も急な坂道を下ることで見つけ出します。この坂道の傾き具合は、全てのデータを使って計算されます。つまり、登山家の周りの景色全体をくまなく調べて、最適な一歩を決定するようなものです。このため、確実に谷底へと近づいていくことができます。しかし、景色全体を調べるには時間がかかります。データの数が膨大になると、一歩踏み出すまでに多くの計算が必要となり、学習に時間がかかってしまうのです。

一方、確率的勾配降下法は、目隠しをした登山家が、ランダムに一歩ずつ跳びはねるように下山していく方法と言えるでしょう。一歩踏み出す方向は、ランダムに選んだ一つのデータだけを見て決めます。全体を見ていないため、進む方向が必ずしも谷底へと向かっているとは限りません。時には、谷底から遠ざかる方向に進んでしまうこともあります。しかし、一歩踏み出すための計算は非常に軽く済みます。データ全体を調べる必要がないため、最急降下法に比べてはるかに速く下山を進めることができます。ただし、進む方向がランダムであるため、学習の過程は不安定になりやすく、谷底にたどり着くまでに紆余曲折を経る可能性があります。

このように、最急降下法と確率的勾配降下法は、それぞれ異なる特徴を持っています。最急降下法は安定した学習が可能ですが計算に時間がかかり、確率的勾配降下法は計算が速いものの学習が不安定になりやすいのです。どちらの方法が良いかは、データの量や性質、そして求める精度の高さなどによって異なります。状況に応じて適切な方法を選ぶことが、効率的な学習の鍵となるでしょう。

| 手法 | イメージ | 特徴 | メリット | デメリット |

|---|---|---|---|---|

| 最急降下法 | 谷底を目指す登山家のように、全体を見渡しながら慎重に下山 | 全てのデータを使って傾きを計算 | 安定した学習が可能 | 計算に時間がかかる |

| 確率的勾配降下法 | 目隠しをした登山家が、ランダムに一歩ずつ跳びはねるように下山 | ランダムに選んだ一つのデータだけを見て方向を決定 | 計算が速い | 学習が不安定になりやすい |

まとめ

機械学習の分野では、膨大な量の情報を処理して規則性やパターンを見つけることが求められます。この学習過程で重要な役割を果たすのが、確率的勾配降下法と呼ばれる手法です。この手法は、目的関数の最小値を探すための効率的な手段として広く利用されています。

確率的勾配降下法の大きな利点は、計算の負担が軽いことです。全ての情報を一度に処理するのではなく、一部の情報をランダムに抽出して処理を行います。このため、大規模な情報を取り扱う場合でも、計算時間を大幅に短縮できます。また、このランダムな抽出が、局所的な最適解に陥ることを防ぐ効果も持っています。局所的な最適解とは、全体で見れば最適ではないものの、その近辺では最適に見えるような状態のことです。確率的勾配降下法は、ランダムな動きによって、より良い最適解を見つけ出す可能性を高めます。

しかし、確率的勾配降下法には欠点も存在します。ランダムに情報を抽出するため、学習の過程が不安定になりやすいのです。学習の進み具合が振動したり、最適な状態に収束するまでに時間がかかったりすることがあります。そのため、適切な設定値を選ぶことが重要になります。例えば、一度にどれだけの情報を処理するかを決める設定や、学習の進み具合を調整する設定など、様々な設定を適切に調整する必要があります。

近年では、確率的勾配降下法の欠点を補うための様々な改良手法が開発されています。これらの改良手法は、学習の安定性を高めたり、収束速度を向上させたりする効果があります。機械学習の進歩は、これらのアルゴリズムの進化と密接に関係しています。より複雑な問題を解決し、より高度な予測モデルを構築するためには、確率的勾配降下法の理解が不可欠です。今後も、確率的勾配降下法は機械学習の中心的な手法であり続け、更なる発展が期待されます。

| 項目 | 説明 |

|---|---|

| 手法 | 確率的勾配降下法 |

| 目的 | 目的関数の最小値を探す |

| 利点 |

|

| 欠点 |

|

| 対策 | 適切な設定値を選ぶ(一度に処理する情報量、学習の進み具合調整など) |

| 改良手法 | 学習の安定性向上、収束速度向上 |

| 重要性 | 機械学習の中心的な手法、更なる発展が期待される |