生成系AIと誤情報の拡散

AIの初心者

先生、生成系AIの『誤情報の拡散』ってどういうことですか?難しくてよくわからないんです。

AI専門家

簡単に言うとね、今のAIはすごく精巧なニセ画像や動画を作れるようになったんだよ。まるで本物みたいに見えるから、それを事実のように広められてしまうことがあるんだ。例えば、選挙で実際には言っていないことを言ったように見せかける動画とかね。これが『誤情報の拡散』だよ。

AIの初心者

なるほど。でも、わざと作られたニセモノだけじゃなくて、AI自身が間違った情報を作ってしまうこともあるんですよね?

AI専門家

その通り!AIが作った情報が事実かどうかをAI自身も判断できないことがあるんだ。まるでAIが幻覚を見ているみたいだから『ハルシネーション』とも呼ばれているんだよ。これも誤情報の拡散につながるんだね。

誤情報の拡散とは。

近頃の人工知能は、まるで人間が作ったかのように精巧な画像や動画を作り出せるようになりました。そのため、偽物の画像や動画と本物を見分けるのが難しくなり、間違った情報が広まってしまう危険性があります。悪意を持って作られた偽物の動画や画像だけでなく、人工知能自身が間違った情報を作ってしまい、私たちが気づかずに広めてしまう可能性もあります(これを幻覚と呼びます)。このような間違った情報の拡散は、選挙活動や個人の評判を傷つけるなど、様々な問題を引き起こします。そのため、人工知能の使い方を法律で規制したり、情報が正しいかどうかを見分けるための知識を身につける必要があるでしょう。

精巧な偽造による混乱

近ごろ、人工知能による画像や動画の偽造技術が驚くほど進歩しています。以前は偽物だと簡単に見抜けたものも、今では本物と区別がつかないほど精巧になり、真偽を見分けることが非常に難しくなっています。

この技術の進歩は、便利な反面、悪用される危険性もはらんでいます。心無い人々がこの技術を悪用し、偽の情報を広める道具として使う可能性が高まっているのです。例えば、政治家の発言を偽って作った動画や、実際には起こっていない事件をでっち上げた画像などを作り、インターネットを通じて拡散すれば、社会全体に混乱と不信感を巻き起こすことは容易に想像できます。このような偽の情報操作は、民主主義の土台を揺るがす重大な問題と言えるでしょう。

もはや、自分の目で見たもの、耳で聞いたものさえも、本当に真実なのかどうか確信を持てない時代になってきました。情報の真偽を見極める目を養うことはもちろん重要ですが、それだけでは不十分です。情報の出どころはどこなのか、その情報源は信頼できるのかについても、注意深く吟味する必要があります。

また、偽情報を見抜くための対策も重要です。信頼できる情報源を複数確認する癖をつけたり、情報の内容に不自然な点がないか注意深く確認するなど、情報リテラシーを高める努力が私たち一人一人に求められています。技術の進歩は私たちの生活を豊かにする一方で、新たな脅威ももたらします。だからこそ、技術の進歩に合わせた適切な対策を講じ、健全な社会を維持していく必要があるのです。

| 問題点 | 対策 |

|---|---|

| AIによる画像・動画偽造技術の高度化により、真偽の見極めが困難に。 | 情報の真偽を見極める目を養う。情報源の信頼性を確認する。 |

| 偽情報による社会の混乱と不信感の増大。民主主義の土台を揺るがす危険性。 | 信頼できる情報源を複数確認する。情報の内容に不自然な点がないか確認する。情報リテラシーを高める。 |

| 技術の進歩に伴う新たな脅威の出現。 | 技術の進歩に合わせた適切な対策を講じる。 |

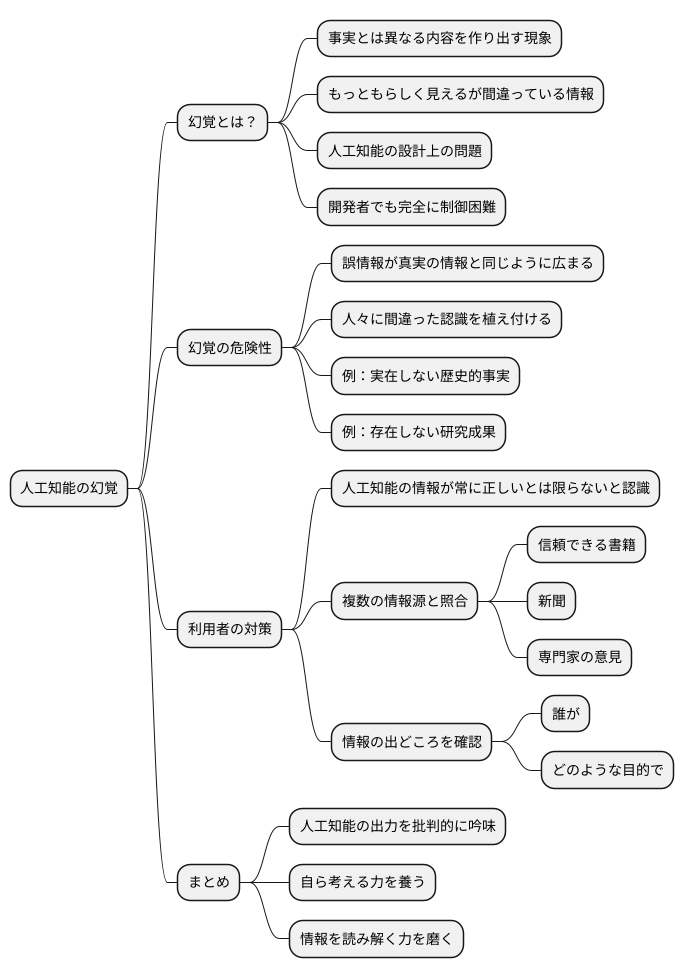

意図しない誤情報の生成

近頃話題の人工知能は、時として事実とは異なる内容を作り出してしまうことがあります。これは「幻覚」と呼ばれる現象で、人工知能が学習したデータに基づいて、もっともらしく見えるけれども、実際には間違っている情報を作り上げてしまうことを指します。故意に偽の情報を作るのとは違い、これは人工知能の設計上の問題であり、開発者でも完全に制御するのが難しい現状です。

この幻覚によって生み出された誤った情報は、真実の情報と同じように広まってしまう可能性があり、その結果、人々に間違った認識を植え付けてしまう危険性があります。例えば、歴史上の人物について人工知能に尋ねた際に、実在しない出来事を事実のように語ってしまうことがあります。あるいは、最新の科学的発見について質問したところ、存在しない研究成果をあたかも真実のように提示してしまうかもしれません。このような誤情報は、特に専門知識を持たない人が目にすると、真実と見分けることが非常に困難です。

私たち利用者は、人工知能が作った情報が常に正しいとは限らないということを常に心に留めておく必要があります。人工知能が出した答えを鵜呑みにするのではなく、複数の情報源、例えば信頼できる書籍や新聞、専門家の意見などと照らし合わせるなどして、情報の真偽を確かめる習慣を身につけることが大切です。また、情報の出どころを確認することも重要です。誰が、どのような目的でその情報を作成・発信したのかを知ることで、情報の信頼性を判断する手がかりになります。

人工知能は便利な道具ですが、その出力結果を批判的に吟味し、自ら考える力を養うことが、情報社会を賢く生き抜く上で不可欠です。人工知能を使いこなし、その恩恵を最大限に受けるためにも、情報を読み解く力を磨いていく必要があると言えるでしょう。

選挙活動への影響

私たちの暮らしに欠かせないものとなった選挙は、公平で公正なものでなくてはなりません。しかし、偽の情報が広まることで、選挙活動に大きな影を落とす危険性があります。

例えば、ある立候補者が実際には言っていない言葉をでっちあげた動画が、インターネットを通して急速に広まったとしましょう。その動画を見た人たちは、立候補者について間違った印象を抱き、投票先を変えるかもしれません。このようなことは、立候補者にとって大きな不利益であり、公正な競争を阻害するものです。

また、特定の立候補者を応援するように仕向けるための、偽の情報も問題です。真実でない情報に惑わされた人々が、特定の立候補者に投票すれば、選挙の結果が歪められてしまう可能性があります。本来、選挙は民意を反映する場であるべきですが、偽の情報によって民意が操作されてしまうことは、民主主義の根幹を揺るがす重大な問題です。

さらに、偽の情報は、人々の政治への関心を低下させる可能性も懸念されます。何が真実で何が嘘かわからない状況では、人々は政治に無関心になり、選挙から遠ざかってしまうかもしれません。

公正な選挙を守るためには、私たち一人ひとりが、情報を読み解く力を養うことが大切です。インターネットや口コミなどで情報を得る際には、その情報の出どころや信ぴょう性を確認する習慣をつけましょう。もし、偽の情報を見つけた場合は、拡散しないように注意し、周りの人に伝えることも重要です。公正な選挙の実現のためには、私たち全員の協力が必要です。

| 問題点 | 具体的な例 | 影響 |

|---|---|---|

| 偽情報の拡散 | 立候補者が言っていない言葉をでっちあげた動画の拡散 | 立候補者への間違った印象、投票先変更の可能性、公正な競争の阻害 |

| 特定候補者への支持を促す偽情報 | 真実でない情報による特定候補者への投票 | 選挙結果の歪み、民意の操作、民主主義の根幹を揺るがす |

| 政治への無関心 | 真偽不明な情報による政治への不信感 | 政治への無関心、選挙離れ |

名誉毀損などの問題

人工知能が生み出す偽物の絵や動画は、人の評判を落とすために使われる危険性があります。まるで本物のように見えるため、悪意ある使い方をされると、大きな損害につながります。例えば、ある人が実際には行っていない悪い行いをしているかのような偽の動画を作り、それをインターネット上に広められたとします。多くの人がその動画を信じてしまうと、その人の信頼は一気に崩れ落ち、社会生活に大きな支障をきたすでしょう。仕事や人間関係を失ってしまうかもしれません。

このような事態を防ぐためには、人工知能を使う際のおきてをしっかり決める必要があります。どんな使い方をして良いのか、悪いのかを明確にし、悪い使い方をした人には厳しい罰を与えるようにするのです。また、人工知能で作られたものを見分ける技術を開発することも重要です。偽物と本物を簡単に見分けられるようになれば、だまされる人も減るでしょう。

私たち自身も、自分の情報がどのように扱われているかを意識する必要があります。不用意に個人情報をインターネット上に公開しない、怪しい話にひっかからないなど、一人ひとりが注意することで、被害を防ぐことができるはずです。また、もし自分の情報が悪用されていると感じたら、すぐに関係機関に相談することも大切です。

人工知能は便利な道具ですが、使い方を間違えると大きな害悪をもたらす可能性があります。皆で協力して、安全に使えるようにしていく必要があるでしょう。技術の進歩に合わせて、法整備や教育も進めていくことが重要です。そして、常に最新の情報に注意を払い、危険を察知する能力を養うことも必要です。

| 問題点 | 対策 | 個人としての対策 |

|---|---|---|

| AI生成の偽コンテンツによる風評被害 | AI利用ルールの制定と罰則化 偽コンテンツ判別技術の開発 |

個人情報の適切な管理 怪しい情報に注意 被害時の関係機関への相談 |

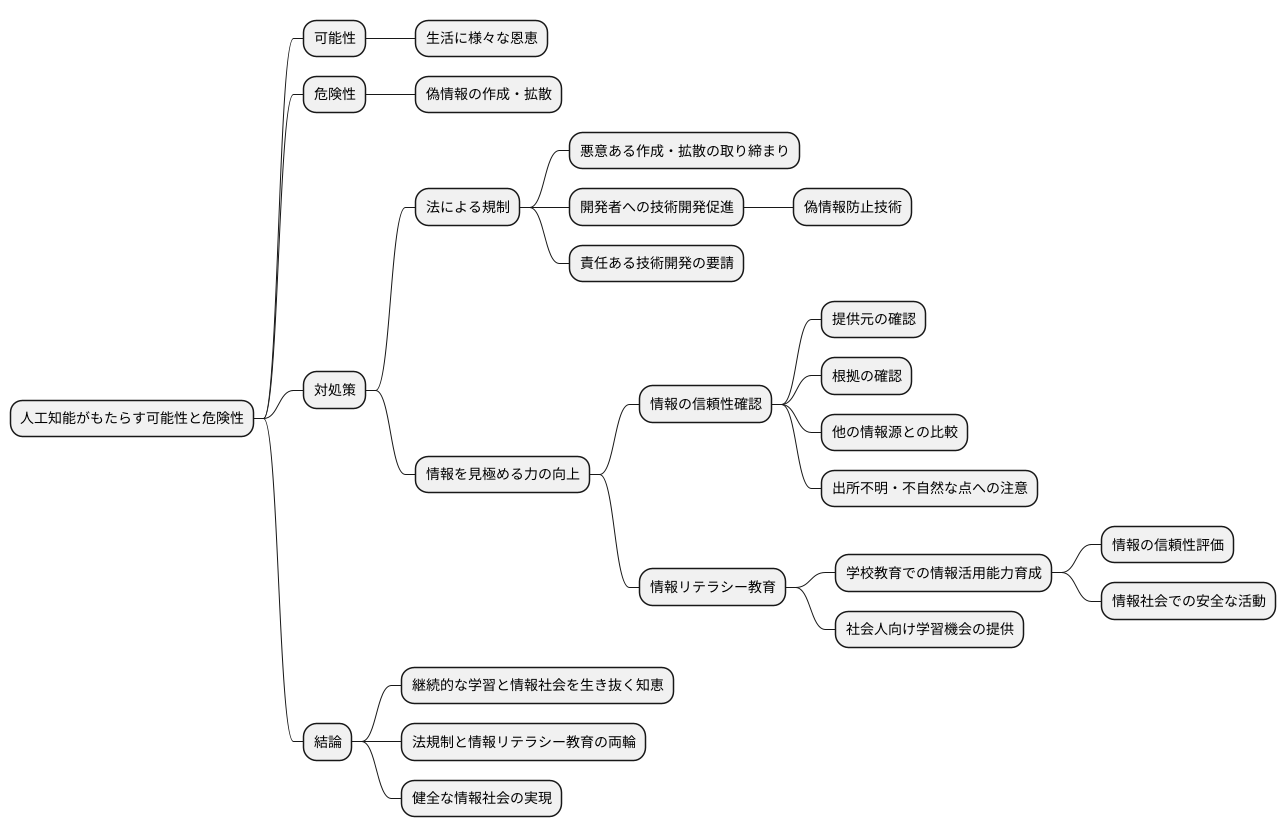

法規制と情報リテラシー

近頃話題となっている、文章や画像などを作り出す人工知能は、私たちの生活に様々な恩恵をもたらす可能性を秘めています。しかし、同時に偽の情報が簡単に作られ、広まってしまう危険性も孕んでいます。この問題に対処するには、法による規制と、私たち一人ひとりの情報を見極める力の向上が必要不可欠です。

まず、法による規制の整備は重要です。悪意を持って偽の情報を作成したり、広めたりする行為を取り締まる法律が必要です。また、人工知能の開発者に対しては、偽の情報が作られるのを防ぐ技術の開発を促す必要があります。開発者には、責任ある技術開発を行うよう求める必要があります。

同時に、私たち利用者も情報を見極める力を身に付ける必要があります。インターネット上には様々な情報が溢れていますが、その情報が本当に正しいのか、常に疑問を持つことが大切です。情報の提供元はどこなのか、情報の根拠は何か、他の情報源と比べて矛盾はないかなどを注意深く確認することで、情報の信頼性を確かめることができます。もし情報の出所が不明瞭な場合や、内容に不自然な点がある場合は、その情報は信頼できない可能性が高いと考え、安易に信じたり、拡散したりしないように気を付ける必要があります。

情報を見極める力を育む教育も、社会全体で取り組むべき重要な課題です。学校教育の場では、子どもたちに情報機器の使い方だけでなく、情報の信頼性を評価する方法や、情報社会で安全に活動するための知識や技能を教える必要があります。また、大人に対しても、情報リテラシーに関する学習機会を提供し、誰もが情報社会を賢く生き抜くための力を身に付けられるよう支援していく必要があるでしょう。

技術は日々進歩し、情報環境はますます複雑化しています。だからこそ、私たちは常に学び続け、情報社会を生き抜く知恵を磨くことが大切です。法規制と情報リテラシー教育の両輪で、健全な情報社会を実現していく必要があるでしょう。