マルコフ決定過程モデル:未来予測

AIの初心者

『マルコフ決定過程モデル』って、難しそうですね。今の状態だけで次の状態が決まるっていうのはなんとなくわかるんですが、普通のマルコフ過程モデルとの違いがよくわからないです。

AI専門家

そうですね。確かに似ていますね。普通のマルコフ過程モデルは、サイコロを振るように、現在の状態から次の状態へ確率的に変化していくだけなんです。一方、マルコフ決定過程モデルでは、ある状態において人が行動を選択すると、その行動に応じて次の状態へ確率的に変化します。つまり『行動』という要素が加わるんです。

AIの初心者

なるほど。例えば、今私が家にいるとして、次の状態は学校か公園か図書館だとします。マルコフ過程モデルだと、この3つのどれかに確率的に移動するんですよね。マルコフ決定過程モデルでは、私が『学校へ行く』という行動を選んだら学校へ、『公園へ行く』という行動を選んだら公園へ行く、ということですか?

AI専門家

まさにそうです!良い例えですね。そして、それぞれの行動によって、学校、公園、図書館へ行く確率も変わってくる可能性があります。つまり、行動が次の状態への遷移確率にも影響を与えるのです。これがマルコフ決定過程モデルです。

マルコフ決定過程モデルとは。

「人工知能」に関わる言葉である「マルコフ決定過程モデル」について説明します。マルコフ決定過程モデルとは、ある状況で何かの行動を選んだ時に、別の状況に変化していく仕組みのことです。まず、元となる「マルコフ過程モデル」は、未来の状況は過去の状況とは関係なく、今の状況と変化する確率によって決まるという仕組みです。マルコフ決定過程モデルは、これに「行動」という考え方を取り入れたものです。

はじめに

人は昔から、この先何が起こるかを知りたいと願ってきました。空模様や景気の動向、病気の経過など、未来を予想することは、私たちの暮らしに欠かせません。そうした中で、これから起こる不確かな出来事を踏まえて、より良い判断をするための方法として、マルコフ決定過程モデルというものに注目が集まっています。

このモデルは、現在の状況を把握し、それに基づいて最も良い行動を選ぶことで、将来の望ましい状態へ導くための指針を示してくれます。天気予報を例に考えてみましょう。明日の天気が晴れか雨かによって、傘を持っていくかどうかを判断します。現在の状況(今日の天気や気圧配置など)から明日の天気を予測し、雨が降る確率が高いと判断した場合、傘を持っていくという行動を選びます。これがマルコフ決定過程モデルの基本的な考え方です。

このモデルは、様々な分野で応用されています。ロボットの制御では、周囲の環境を認識し、最適な動作を選択することで目的を達成するために利用されます。また、在庫管理では、将来の需要を予測し、最適な発注量を決定することで在庫切れや過剰在庫を防ぎます。さらに、医療分野では、患者の状態に基づいて最適な治療方針を決定する際にも役立ちます。

マルコフ決定過程モデルの重要な特徴は、過去の履歴を考慮しないという点です。つまり、現在の状態だけに着目し、過去の状態は意思決定に影響を与えません。これは、過去の情報が必ずしも将来の予測に役立つとは限らないという考え方に基づいています。例えば、今日が晴れでも、明日が必ず晴れとは限りません。過去の天気の情報よりも、現在の気象状況を把握する方が、明日の天気を正確に予測するために重要です。このように、マルコフ決定過程モデルは、限られた情報からでも最適な意思決定を行うことを可能にする強力なツールと言えるでしょう。

| マルコフ決定過程モデル |

|---|

| 未来の不確かな出来事を踏まえて、より良い判断をするための方法 |

| 現在の状況を把握し、それに基づいて最も良い行動を選ぶことで、将来の望ましい状態へ導く |

| 過去の履歴を考慮しない(現在の状態だけに着目) |

| 例:天気予報(明日の天気を予測し、傘を持っていくか判断) |

| 応用分野:ロボット制御、在庫管理、医療など |

| 限られた情報からでも最適な意思決定を行うことを可能にする強力なツール |

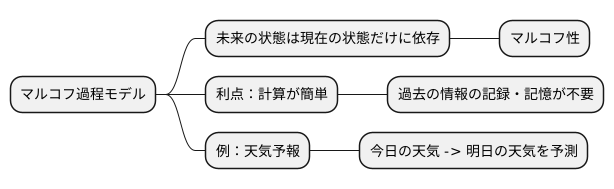

マルコフ過程モデルとは

「マルコフ過程モデル」とは、未来の状態を予測する際に、過去の状態ではなく、現在の状態だけを考慮すればよいという画期的な確率モデルです。 未来を占う水晶玉があると想像してみてください。この水晶玉は、過去の出来事には全く関心を示さず、現在の状態だけを映し出し、そこから未来を予測します。これがまさにマルコフ過程モデルの考え方です。

例えば、明日の天気を予測したいとします。天気予報士は、昨日の天気や一週間前の天気ではなく、今日の天気の様子、例えば気温や湿度、風向きなどを詳しく調べます。今日の状態が晴れならば、明日は晴れもしくは曇りの可能性が高く、今日の状態が雨ならば、明日は雨もしくは曇りの可能性が高いと考えます。つまり、明日の天気は、今日の天気という現在の状態に強く依存しているのです。これを「マルコフ性」と呼びます。

マルコフ過程モデルの利点は、過去のすべての情報を記録・記憶する必要がないため、計算が非常に簡単になることです。 従来の予測モデルでは、過去の膨大なデータを分析する必要がありました。しかし、マルコフ過程モデルでは、現在の状態だけを把握すれば良いので、計算の手間が大幅に省けます。まるで、分厚い歴史書をすべて読む代わりに、今日の新聞のだけを読めば未来が予測できるようなものです。

このように、マルコフ過程モデルは、未来の状態が現在の状態だけに依存するというマルコフ性という性質を持つことで、計算を簡略化し、未来予測を効率的に行うことができる強力なツールなのです。

マルコフ決定過程モデルの仕組み

マルコフ決定過程モデルは、不確実性を含む状況で、最適な行動手順を決めるための強力な道具です。これは、時間の流れとともに変化するシステムを、状態、行動、遷移確率、報酬という4つの要素で表現します。

まず、「状態」とは、システムの現在の状況を表すものです。例えば、ロボットの現在位置やバッテリー残量、天気予報などが状態として考えられます。次に、「行動」とは、各状態でシステムが取りうる選択肢のことです。ロボットであれば、前進、後退、回転などが行動に該当します。そして、「遷移確率」は、ある状態である行動をとった時に、次の状態へ移る確率を表します。例えば、ロボットが前進した時に、障害物にぶつかって停止する確率や、目標地点に到達する確率などです。最後に、「報酬」は、ある状態に遷移した際に得られる利益、または被る損失を表す数値です。ロボットが目標地点に到達すれば高い報酬が得られ、障害物に衝突すれば大きな損失を被ると設定できます。

マルコフ決定過程モデルの特徴は、「マルコフ性」と呼ばれる性質にあります。これは、次の状態への遷移確率が、現在の状態と行動のみに依存し、過去の履歴には影響を受けないというものです。つまり、未来の状態は現在の状態だけから予測でき、過去の状態を知る必要はないということです。

このモデルの目的は、将来にわたって得られる報酬の合計値を最大にする、あるいは損失の合計値を最小にするような、最適な行動戦略を見つけることです。最適な戦略は、各状態でどの行動をとるべきかを定めたものです。例えば、ロボット制御では、現在の位置と目標位置に基づいて、前進、後退、回転などの行動を適切に選択することで、効率的に目標地点に到達できます。このように、マルコフ決定過程モデルは、様々な分野で意思決定を最適化するための手段として広く活用されています。

| 要素 | 説明 | 例 |

|---|---|---|

| 状態 | システムの現在の状況 | ロボットの現在位置、バッテリー残量、天気予報 |

| 行動 | 各状態でシステムが取りうる選択肢 | 前進、後退、回転 |

| 遷移確率 | ある状態である行動をとった時に、次の状態へ移る確率 | ロボットが前進した時に、障害物にぶつかって停止する確率、目標地点に到達する確率 |

| 報酬 | ある状態に遷移した際に得られる利益、または被る損失 | 目標地点到達で高い報酬、障害物衝突で大きな損失 |

| マルコフ決定過程モデルの目的 |

|---|

| 将来にわたって得られる報酬の合計値を最大にする、あるいは損失の合計値を最小にするような、最適な行動戦略を見つけること |

応用例

マルコフ決定過程モデルは、不確実性を含む様々な状況で最適な行動を決めるための枠組みであり、多くの分野で活用されています。

機械の制御の分野では、ロボットが環境の変化に柔軟に対応するための行動計画を立てる際に役立ちます。例えば、周囲の障害物を避けながら目的地まで移動する経路を探索したり、部品の組み立て作業を最適化したりする際に、マルコフ決定過程モデルが利用されます。

自動運転技術の発展にも、マルコフ決定過程モデルは大きく貢献しています。周りの車の動きや道路状況、歩行者や信号といった様々な要素を考慮しながら、安全な運転を実現するための意思決定を行う必要があるためです。刻々と変化する状況の中で、適切な速度や進路を選択するために、マルコフ決定過程モデルが活用されています。

ゲームの世界でも、マルコフ決定過程モデルは活躍しています。敵の動きや盤面の状態といった情報をもとに、勝利に繋がる行動を選択する人工知能を開発するために利用されます。複雑な状況を分析し、最善手を導き出すことで、より高度なゲーム体験を提供することが可能になります。

商品の在庫管理にも、マルコフ決定過程モデルは応用されています。将来の需要予測に基づき、適切な量の商品を発注することで、在庫切れや過剰在庫といった問題を防ぐことができます。需要の変動を考慮しながら、効率的な在庫管理を実現するために、マルコフ決定過程モデルは重要な役割を果たします。

金融取引においても、マルコフ決定過程モデルは欠かせない存在です。市場の変動を予測しながら、リスクと収益のバランスを考慮した投資戦略を立てるために利用されます。常に変化する市場環境の中で、最適な投資判断を行うために、マルコフ決定過程モデルは必要不可欠です。

| 分野 | 目的 | マルコフ決定過程モデルの役割 |

|---|---|---|

| 機械の制御 | ロボットの行動計画 | 環境変化に柔軟に対応した経路探索、部品組み立て作業の最適化 |

| 自動運転技術 | 安全な運転 | 周囲の状況を考慮した適切な速度と進路の選択 |

| ゲーム | 勝利に繋がる行動選択 | 敵の動きや盤面の状態に基づいた最善手の導出 |

| 商品の在庫管理 | 効率的な在庫管理 | 需要予測に基づいた適切な発注量の決定 |

| 金融取引 | 最適な投資判断 | 市場の変動予測に基づいたリスクと収益のバランスを考慮した投資戦略 |

将来展望

マルコフ決定過程モデルは、未来を見据えた時、人工知能技術の進歩と共に、より洗練された姿へと進化していくと予想されます。特に、人間の脳の仕組みを模倣した深層学習との組み合わせは、これまで解けなかった複雑な問題を解く鍵となるでしょう。深層強化学習と呼ばれるこの技術は、膨大な量のデータから学習することで、従来の方法では難しかった複雑な状況における最適な判断を可能にするのです。

具体例を挙げると、自動運転システムへの応用が期待されます。様々な道路状況や天候の変化に対応できる、より高度な制御システムの開発につながるでしょう。例えば、急な雨や霧の中でも安全に走行できる自動車や、複雑な交差点でのスムーズな通行を実現する自動運転技術などが考えられます。これにより、交通事故の減少や交通渋滞の緩和など、私たちの生活はより安全で快適になるでしょう。

また、医療の分野においても、マルコフ決定過程モデルは大きな役割を果たすと考えられます。患者の状態に合わせた最適な治療方針を決定するシステムへの応用が期待されています。例えば、個々の患者の体質や病状に合わせて、最適な薬の種類や量を決定するシステムや、手術のタイミングや方法を判断するシステムなどが開発されるかもしれません。これにより、より効果的で安全な医療の実現に近づくことができるでしょう。このように、マルコフ決定過程モデルは、未来の社会を支える重要な技術として、さらなる発展を遂げ、様々な分野で活躍していくことが期待されます。

| 分野 | 応用例 | 効果 |

|---|---|---|

| 自動運転 |

|

|

| 医療 |

|

|

まとめ

マルコフ決定過程モデルは、不確実な状況で、どのように意思決定すれば良いかを示してくれる強力な手法です。未来がどうなるか分からない状況でも、今どのような行動を取れば良いのかを指し示してくれるのです。このモデルは、現在の状態、選択可能な行動、行動による状態の変化、そして各状態の価値という4つの要素で表現されます。

現在の状態に基づいて行動を選択すると、状態は変化します。そして、その変化に応じて価値が得られます。価値とは、その状態がどれくらい望ましいかを表す数値です。マルコフ決定過程モデルは、この価値を最大化するような行動の選択方法を導き出します。つまり、将来にわたって最も高い価値を得られるように、今どのような行動を取れば良いのかを教えてくれるのです。

例えば、ロボットの掃除を想像してみましょう。ロボットは部屋の状態(位置、ゴミの有無など)を認識し、掃除、移動などの行動を選択できます。行動の結果として部屋の状態が変わり、綺麗になった部屋には高い価値が割り当てられます。マルコフ決定過程モデルを使うことで、ロボットは最も効率的に部屋を掃除するための行動順序を決定できるようになります。

このモデルは、掃除ロボット以外にも様々な分野で応用されています。自動運転、在庫管理、金融取引など、不確実性を含む意思決定問題を解決する場面で広く活用されています。人工知能技術の進歩と共に、このモデルは更に進化を遂げ、より複雑な問題解決にも役立つと期待されています。将来の技術を理解する上で、マルコフ決定過程モデルは重要な鍵となるでしょう。

| 要素 | 説明 | 例(ロボット掃除) |

|---|---|---|

| 現在の状態 | 意思決定を行う時点の状態 | ロボットの位置、ゴミの有無など |

| 選択可能な行動 | 現在の状態から選択できる行動 | 掃除、移動など |

| 行動による状態の変化 | 行動によって状態がどのように変化するか | 掃除によってゴミがなくなる、移動によって位置が変わる |

| 各状態の価値 | 各状態の望ましさの度合い | 部屋の綺麗さ |