AIの解釈:ブラックボックスを開く

AIの初心者

「モデルの解釈」って難しそうだけど、一体どういうことですか?

AI専門家

簡単に言うと、AIがなぜそういう答えを出したのか、その理由を説明できるようにすることだよ。例えば、AIが画像を見て「猫」と判断したとして、なぜ「猫」だと思ったのか、根拠が分からなければ信用しづらいよね?

AIの初心者

確かに、理由が分からないと納得できませんね。AIが何を考えているか分かると便利そうです。

AI専門家

その通り!特に医療の分野などでは、AIの判断が人の命に関わることもあるから、判断の理由を明確にする「モデルの解釈」はすごく重要なんだ。

モデルの解釈とは。

人工知能における「モデルの解釈」について説明します。モデルの解釈とは、人工知能がどのように予測や判断に至ったのか、その理由を明らかにすることです。人工知能の中でも特に深層学習は、様々な分野で応用できる便利な技術ですが、その仕組みは複雑で、中身が分かりにくいという欠点があります。例えるなら、中身が見えない黒い箱のようです。医療のような分野では、判断の理由が説明できない限り、実際に現場で使われることは難しいです。そのため、人工知能がどのように予測したのかを目に見えるようにする技術の研究が進められています。例えば「グラッドカム」のような、説明可能な人工知能の研究です。これは、人工知能の判断根拠を分かりやすく示してくれる技術です。

解釈の必要性

近頃、人工知能、中でも深層学習は目覚ましい進歩を遂げ、様々な場所で活用されるようになりました。写真を見て何が写っているか判断する、人の言葉を理解する、病気の診断を補助するなど、活躍の場は実に様々です。しかし、その高い能力の裏には、判断の過程が分かりにくいという問題が隠されています。つまり、なぜ人工知能がそのような予測や判断をしたのか、その理由が人間には理解しづらいのです。これは「ブラックボックス」と呼ばれ、人工知能の信頼性や使える範囲を狭めてしまう大きな原因となっています。

例えば、人工知能が患者のレントゲン写真を見て「肺炎の疑いあり」と診断したとします。医師はその診断が正しいかどうかだけでなく、なぜ人工知能がそう判断したのかを知りたいはずです。もし人工知能が診断の根拠を示すことができれば、医師はそれを参考に最終的な判断を下すことができます。人工知能が単なる診断補助ツールではなく、医師と協力して医療の質を向上させるパートナーとなるためには、判断の根拠を説明できることが不可欠です。

また、お金に関することなど、人の暮らしや経済に直接関わる分野では、人工知能の判断根拠を明らかにすることが特に重要です。例えば、人工知能が融資の可否を判断する場合、なぜその判断に至ったのかを説明できなければ、融資を断られた人は納得できません。また、判断の過程に偏見や差別が潜んでいる可能性も否定できません。そのため、責任ある判断を行うためにも、人工知能の解釈性は避けて通れない課題となっています。人工知能の判断根拠を理解し、それを適切に活用することで、私たちはより良い社会を築くことができるはずです。

| 人工知能の現状 | 課題 | 解決策 | 利点 |

|---|---|---|---|

| 深層学習の進歩により様々な分野で活用 | 判断過程が不透明(ブラックボックス) 信頼性、活用範囲の制限 |

判断根拠の説明機能 |

|

| 医療診断の補助 | 診断の正しさだけでなく、根拠も重要 | 根拠提示による医師の判断支援 | 医療の質向上、医師とAIのパートナーシップ |

| 融資の可否判断 | 判断根拠の不明確さによる不信感、偏見や差別の可能性 | 説明可能なAIによる責任ある判断 | 納得感のある結果、公平性の確保 |

解釈の方法

人工知能がどのように物事を判断しているのかを理解する事は、人工知能をうまく活用するためにとても大切です。そのためには、色々な方法があります。

一つ目の方法は、入力された情報の中で、どの部分が判断に大きな影響を与えているのかを調べる方法です。例えば、画像を見て何かを判断する人工知能の場合、画像のどの部分に注目したのかを調べることができます。具体的な例を挙げると、写真を見て「猫」と判断した人工知能の場合、耳や目、しっぽといった猫の特徴的な部分に注目していたことが分かります。このように、どの情報が重要だったのかを分析することで、人工知能がどのように判断したのかを理解することができます。

二つ目の方法は、人工知能の内部構造を調べる方法です。人工知能、特に深層学習と呼ばれる技術を使った人工知能は、人間の脳のように複雑な繋がりを持っています。この繋がりの中で、どの部分が活発に働いているのかを調べることで、人工知能がどのように考えているのかをある程度理解することができます。これは、まるで人間の脳の活動を調べることで、思考過程を理解しようとする試みに似ています。

これらの方法は、人工知能がどのように判断しているのかを分かりやすく説明するための重要な手段となります。人工知能の判断過程を理解することで、より信頼して使うことができるようになりますし、問題点を見つけ出して改良することも容易になります。人工知能は複雑な仕組みですが、これらの方法を用いることで、その仕組みを少しずつ解き明かし、より良い活用に繋げることが期待されます。

| 方法 | 説明 | 例 |

|---|---|---|

| 入力情報の重要部分の調査 | 入力された情報の中で、どの部分が判断に大きな影響を与えているのかを調べる。 | 猫の画像認識AIの場合、耳、目、しっぽといった特徴部分に注目。 |

| 人工知能の内部構造の調査 | 人工知能(特に深層学習)の複雑な繋がりの中で、どの部分が活発に働いているかを調べる。 | 人間の脳の活動と思考過程の関係に類似。 |

説明可能なAI

近年、人工知能の分野で「説明可能な人工知能」という考え方が注目を集めています。これは、人工知能がどのように結論を導き出したのか、その理由を人間にも理解できるように説明することを目指すものです。人工知能、特に深層学習と呼ばれる手法は、しばしばブラックボックスと例えられます。これは、入力された情報から出力される結果までの過程が複雑で、人間には理解しにくいためです。そのため、たとえ正しい結果が出力されたとしても、なぜそのような結果になったのかが分からなければ、その人工知能の信頼性に疑問が生じてしまいます。例えば、医療診断支援の人工知能が、ある画像から病気を診断したとしても、その根拠が不明瞭であれば、医師は安心してその診断結果を参考にできません。説明可能な人工知能は、このような問題を解決するために研究されています。具体的には、人工知能の判断根拠を視覚化したり、自然言語で説明したりする技術が開発されています。「グラッドカム」と呼ばれる手法は、画像認識の人工知能が、画像のどの部分に着目して判断したのかを熱画像のように色で表現することで、視覚的に分かりやすく示すことができます。また、人工知能の判断過程を論理的な手順のように段階的に説明する技術も研究されています。これらの技術によって、人工知能の判断根拠を人間が理解できるようになれば、人工知能に対する信頼性が高まり、医療、金融、自動運転など、様々な分野への応用が促進されると期待されます。さらに、人工知能が出した結論が誤っていた場合でも、その原因を特定しやすくなるため、人工知能の改善にも繋がります。説明可能な人工知能は、人工知能が社会に広く受け入れられ、より安全に活用されるために不可欠な要素となるでしょう。

| 課題 | 説明可能なAIの目的 | 具体的な手法 | 期待される効果 |

|---|---|---|---|

| AI、特に深層学習はブラックボックス化しており、 入力から出力までの過程が複雑で人間には理解しにくい。 そのため、AIの信頼性に疑問が生じる。 |

AIがどのように結論を導き出したのか、 その理由を人間にも理解できるように説明する。 |

– 判断根拠の視覚化(例:グラッドカム – 熱画像のように色で表現) – 自然言語による説明 – 論理的な手順のように段階的な説明 |

– AIへの信頼性向上 – 医療、金融、自動運転など様々な分野への応用促進 – AIの改善(誤りの原因特定) – AIの社会への普及と安全な活用 |

解釈の応用

人工知能による解釈は、様々な分野で活用され、その応用範囲は広がり続けています。医療の現場では、人工知能による診断結果だけでなく、その根拠を分かりやすく示すことで、医師の診断を支えることができます。例えば、画像診断において、人工知能が病変部を特定した理由を説明することで、医師は人工知能の見解を理解し、自身の判断と組み合わせることで、より正確な診断につなげることができます。

金融の分野では、融資の判断を人工知能が行う際、その理由を明確にすることが重要です。これは、融資の判断における公平さと透明性を確保するために必要です。人工知能が、過去のデータに基づいて融資の可否を判断する場合、どのようなデータが重視され、どのように判断が下されたのかを説明することで、融資を受ける側も納得感を得ることができ、また、金融機関側も判断の妥当性を検証することができます。

自動運転の技術においても、人工知能の解釈は欠かせません。人工知能がどのように周囲の状況を認識し、判断しているのかを理解することは、安全性を高める上で非常に大切です。例えば、自動運転車がブレーキをかけた理由、あるいは車線変更を行った理由を明確にすることで、乗客は安心して乗車することができます。また、万が一事故が発生した場合にも、その原因を究明し、再発防止策を講じるために、人工知能の判断過程を理解することは不可欠です。

このように、人工知能の解釈は、様々な分野でその活用が進んでおり、人工知能をより安全で信頼できるものにするために重要な役割を果たしています。人工知能が私たちの生活に深く浸透していく中で、人工知能の判断過程を理解し、適切に利用していくことがますます重要になってきています。人工知能の解釈技術の更なる発展により、私たちは人工知能をより効果的に活用し、より良い社会を築いていくことができるでしょう。

| 分野 | 人工知能の解釈の活用例 | メリット |

|---|---|---|

| 医療 | 画像診断における病変部特定理由の説明 | 医師の診断支援、より正確な診断 |

| 金融 | 融資判断の根拠提示 | 融資判断の公平性・透明性確保、顧客の納得感向上、判断の妥当性検証 |

| 自動運転 | 周囲状況の認識・判断過程の提示(例:ブレーキ、車線変更の理由) | 乗客の安心感向上、事故原因究明、再発防止策の策定 |

今後の展望

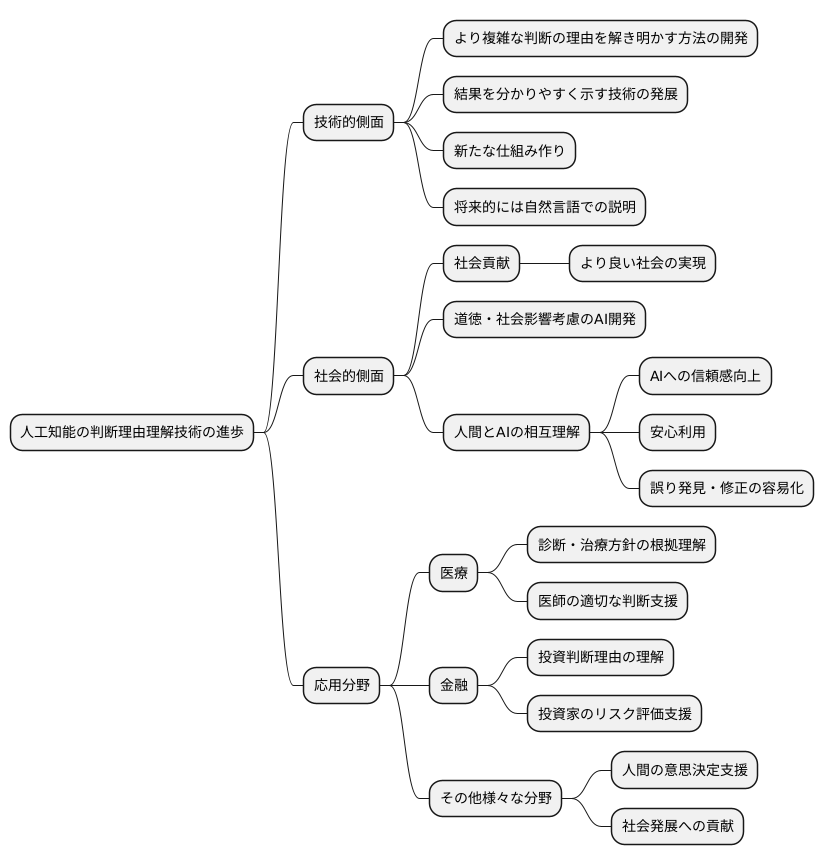

人工知能技術は目覚ましい発展を遂げており、それに合わせて、人工知能の判断の理由を理解する技術も進歩していくと考えられます。より複雑な判断の理由を解き明かす方法や、その結果を分かりやすく示す技術の発展が期待されます。また、人工知能の判断の理由を分かりやすくするための、新たな仕組み作りも重要な課題です。将来は、人工知能が自らの判断の理由を私たちが普段使っている言葉で説明できるようになるかもしれません。

人工知能の判断の理由を理解する技術の進歩は、人工知能を社会で広く役立てることに繋がり、より良い社会の実現に貢献すると考えられます。特に、道徳的な問題や社会への影響を考えた人工知能開発においては、判断の理由を理解できることがますます重要になってくるでしょう。人工知能が真に人間の役に立つ存在となるためには、人間と人工知能がお互いを理解し合うことが欠かせません。そして、そのための重要な鍵となるのが、人工知能の判断の理由を理解することです。人間が人工知能の判断の理由を理解できれば、人工知能への信頼感が高まり、安心して利用できるようになります。また、人工知能の誤りを発見し、修正することも容易になります。

人工知能の判断の理由を理解する技術は、様々な分野での応用が期待されます。例えば、医療分野では、人工知能が診断した病名や治療方針の根拠を理解することで、医師はより適切な判断を下すことができます。金融分野では、人工知能が投資判断をした理由を理解することで、投資家はリスクを適切に評価することができます。このように、人工知能の判断の理由を理解する技術は、様々な分野で人間の意思決定を支援し、社会の発展に貢献していくと考えられます。今後、人工知能の判断の理由を理解する技術の研究開発がますます重要になっていくでしょう。