AIプロジェクト、体制構築の鍵

AIの初心者

先生、「プロジェクト体制の構築」で、多様な人々でチームを作るべきとありますが、どうしてですか?

AI専門家

いい質問だね。AIは、学習データに含まれる偏り(バイアス)の影響を受けてしまうからなんだ。偏りのないAIを作るためには、様々な考え方を持つ人々でチームを構成することが大切なんだよ。

AIの初心者

なるほど。バイアスがあるとどうなるんですか?

AI専門家

例えば、アメリカの「COMPAS」というAIは、学習データに人種による偏りがあったため、有色人種の再犯率を高く予測してしまい、問題になったんだ。他にも、プライバシーに関わる問題も起こり得るから、開発段階からプライバシー保護についてよく考えておく必要があるんだよ。

プロジェクト体制の構築とは。

人工知能を使った事業を始めるにあたって、準備しておくべきことがあります。まず、人工知能は開発に関わる人の偏見の影響を受けやすい性質があるため、様々な背景を持つ人を集めた開発チームを作るのが大切です。例えば、アメリカで使われていた犯罪予測システム「コンパス」は、白人よりも有色人種の人を再び罪を犯しやすいと判断してしまい、大きな問題となりました。また、個人情報の保護については、システムが動き始めてから考えるのではなく、開発の最初の段階からしっかりと計画に組み込んでおく必要があります。これは「プライバシー・バイ・デザイン」と呼ばれる考え方です。

多様な視点を持つことの大切さ

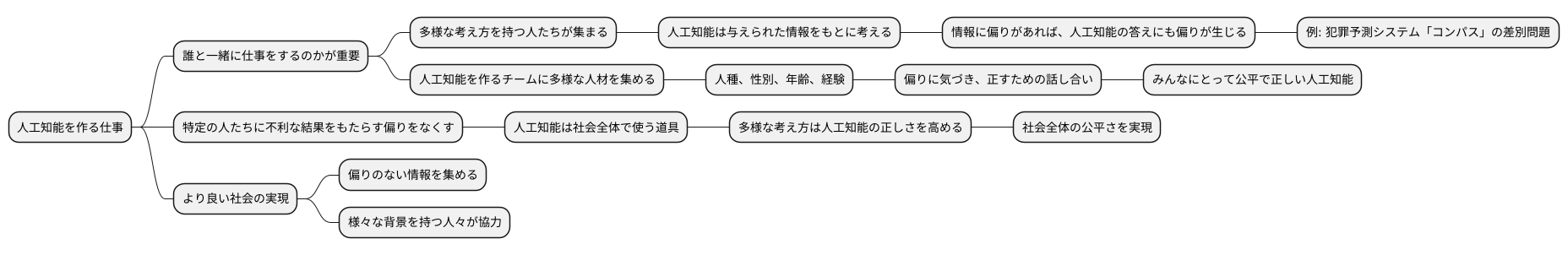

人工知能を作る仕事がうまくいくためには、誰と一緒に仕事をするのかがとても大切です。特に、色々な考え方を持った人たちが集まることが欠かせません。なぜなら、人工知能は、与えられた情報をもとに考えたり、これから起こることを予想したりするからです。もし、その情報に偏りがあれば、人工知能の答えにも同じ偏りが出てしまいます。

例えば、ある人種や性別について間違った情報で人工知能を学習させると、人工知能も同じように間違った考えを持つようになります。アメリカで使われていた犯罪の起こりやすさを予測するシステム「コンパス」は、肌の色が違う人に対して犯罪を起こしやすいと判断する傾向があり、差別につながると大きな問題になりました。このようなことを防ぐためには、人工知能を作るチームに色々な人種、性別、年齢、経験を持った人を集めることが大切です。色々な人が集まれば、偏りに気づき、正すための話し合いが活発になり、みんなにとって公平で正しい人工知能を作ることができます。

人工知能は社会全体で使う道具なので、特定の人たちに不利な結果をもたらす偏りはなくさなければなりません。色々な考え方は、人工知能の正しさを高めるだけでなく、社会全体の公平さを作るためにも必要です。偏りのない情報を集めること、そして、様々な背景を持つ人々が協力して人工知能を作ることで、より良い社会の実現につながると考えられます。

偏りを減らすための対策

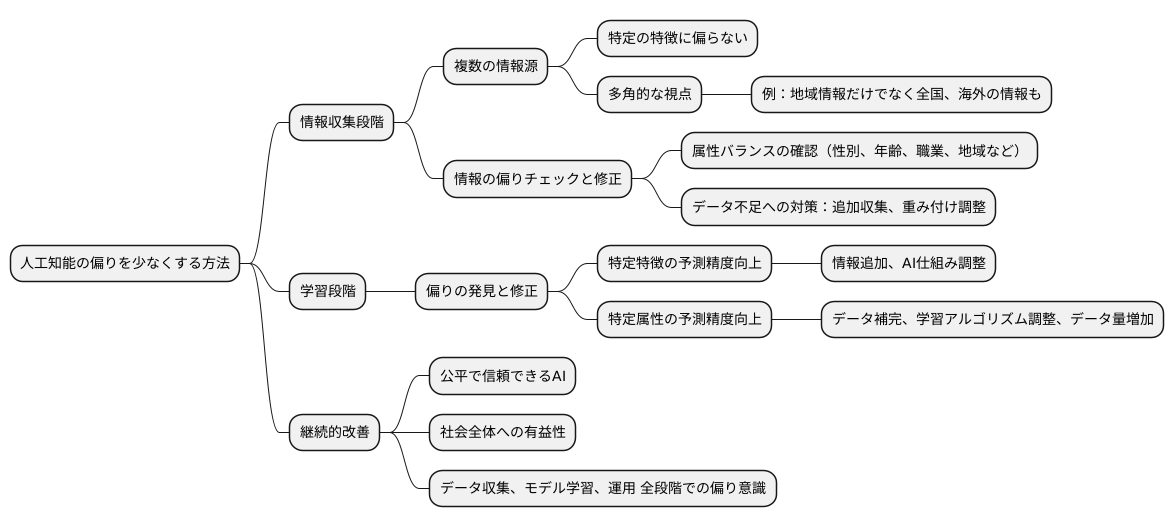

人工知能が持つ一方的なものの見方を少なくするためには、情報を集める最初の段階から対策を練ることが大切です。まず、情報を集めるところをいろいろにすることで、特定の特徴に偏らないように気を付ける必要があります。色々な場所から情報を集めることで、多角的な視点を取り入れることができます。例えば、ある地域の情報だけを集めるのではなく、全国各地の情報、さらには海外の情報も集めることで、より偏りの少ないデータセットを作ることができます。集めた情報に偏りがないかを確かめ、必要に応じて修正する作業も欠かせません。具体的には、性別、年齢、職業、地域など、様々な属性のデータがバランスよく含まれているかを確認します。もし特定の属性のデータが不足している場合は、追加で収集したり、データの重み付けを調整するなどの対策が必要です。人工知能の学習の過程でも、偏りを発見し修正するための技術を使うことが効果的です。例えば、特定の特徴に対する予測の正確さが低い場合は、その特徴に関する情報をもっと集めたり、人工知能の仕組みを調整することで改善を目指します。これは、特定の属性に対する予測精度が低い場合、その属性のデータが不足しているか、モデルがその属性を適切に学習できていない可能性があるためです。不足している場合はデータを補完し、モデルが学習できていない場合は、学習アルゴリズムを調整したり、より多くのデータで学習させることで改善を図ることができます。このようにして対策を続けることで、人工知能が持つ一方的なものの見方を最小限に抑え、もっと公平で信頼できる仕組みを作ることが可能になります。偏りのない人工知能は、社会全体にとって有益であり、その実現のためには、データ収集からモデルの学習、運用に至るまで、あらゆる段階で偏りを意識し、適切な対策を講じる必要があります。継続的な改善努力が、信頼できる人工知能の実現につながります。

プライバシー保護の考え方

人工知能を使った事業を進める上で、個人の情報を守ることはとても大切です。この情報の保護は、システムを作り終えてから考えるのではなく、設計の最初の段階から考えなくてはなりません。「設計段階からの情報保護」という考え方が、まさにそれを表しています。システム開発の初期段階から情報の保護を考えて作ることで、個人情報の適切な扱いが保証され、利用者の信頼を得ることができます。

具体的には、まず個人情報を集める目的をはっきりさせ、必要な範囲で最小限の情報の収集にとどめることが重要です。集めた情報は、決められた目的以外には使ってはいけません。そして、集めた情報の安全な保管方法と、不要になった情報の適切な処分方法を決めておくことも大切です。

また、利用者に対して、どのような情報をどのように使うのかを分かりやすく伝え、同意を得る必要があります。同意を得る際には、利用者が理解しやすい言葉で説明し、同意しない場合の影響についても明確に示すことが重要です。

情報保護は、人工知能システムを倫理的に運用するために欠かせない要素です。責任ある人工知能開発のためには、技術的な側面だけでなく、個人情報の保護や倫理的な側面についても常に配慮する必要があります。情報保護の考え方をシステム開発全体に浸透させることで、利用者の信頼を築き、より良い人工知能社会を実現できるでしょう。

| 人工知能開発における情報保護の重要性 |

|---|

| 設計段階からの情報保護 |

|

| 情報保護は倫理的なAI運用に不可欠 |

| 技術面だけでなく、個人情報保護や倫理面にも配慮 |

継続的な改善の重要性

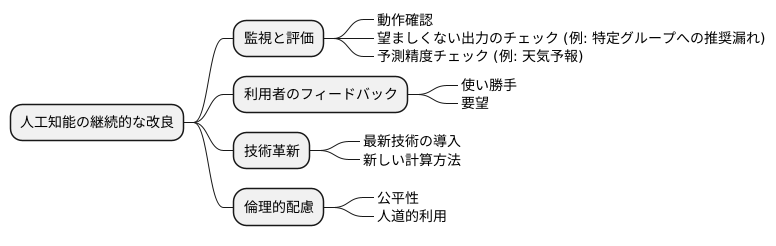

人工知能の仕組みは、一度作って終わりではありません。継続的に改良していくことがとても大切です。作った後も、きちんと動いているか、変な答えを出していないか、常にチェックする必要があります。例えば、ある商品をおすすめする人工知能があったとします。しかし、特定のグループの人には全くおすすめしない、といったおかしなことが起こるかもしれません。このような偏りがないか、常に気を配る必要があります。また、予測が外れていないかも確認が必要です。明日の天気は晴れと予測したのに、実際は雨が降った、といった間違いを減らす努力が重要です。

さらに、実際に人工知能を使う人たちの意見を聞くことも大切です。使いにくいところや、もっとこうしてほしいといった要望を、システムの改良に役立てなければなりません。利用者の声を聞くことで、より良い人工知能を作ることができるのです。人工知能の世界は常に進化しています。新しい技術や計算方法が次々と開発されています。ですから、最新の技術に常に目を向け、システムに取り入れることが重要です。

こうした継続的な改善によって、人工知能の正확성と信頼性を高めることができます。より役に立つ人工知能を作ることができるのです。そして、人工知能が社会の役に立つためには、倫理的な面も忘れてはいけません。人々の生活をより良くするために作られたはずの人工知能が、誰かを傷つけたり、不平等を生み出したりするようなことがあってはなりません。常に倫理的な視点を持って、人工知能を開発し、改良していく必要があります。

責任ある体制作り

人工知能を使った事業を始めるにあたって、体制作りは技術的なことだけでなく、倫理的な側面も大事にしなければなりません。人工知能の仕組みを作って動かすことには、大きな責任が伴います。人工知能による結論が人々の暮らしに影響を与えることを忘れずに、責任ある行動をとることが大切です。

人工知能の開発において、倫理的な問題にしっかり向き合うために、専門の担当者を置くことが大切です。倫理的な問題が起こった場合は、すぐに対策を講じる必要があります。例えば、人工知能が差別的な判断をした場合、その原因を調べ、是正するための対策を素早く行う必要があります。また、人工知能が間違った情報を生成した場合、その情報を修正し、再発を防ぐための対策を講じなければなりません。

人工知能を正しく使い、社会に役立てるためには、倫理的な配慮は欠かせません。倫理的な配慮を怠ると、人工知能が人々に不利益を与える可能性があります。例えば、採用活動において人工知能を利用する場合、性別や年齢などで差別的な判断をしないように注意する必要があります。また、個人のプライバシーを侵害するような情報の収集や利用は避けるべきです。

人工知能の開発チームは、多様な背景を持つ人々で構成することが重要です。多様な視点を取り入れることで、倫理的な問題に気づきやすくなり、より公正で偏りのない人工知能を開発することに繋がります。開発チームは、倫理的なガイドラインを定め、それを遵守するための研修なども実施する必要があります。

責任ある人工知能開発を通して、より良い未来を作ることは、私たちの使命です。人工知能技術は急速に進歩しており、社会に大きな影響を与える可能性を秘めています。だからこそ、倫理的な側面を常に意識し、責任ある体制のもとで人工知能を開発していく必要があります。そうすることで、人工知能を人々の幸福に貢献する力に変えることができるでしょう。

| 項目 | 説明 |

|---|---|

| 倫理的な責任 | AIの結論が人々の暮らしに影響を与えることを理解し、責任ある行動をとる。 |

| 倫理担当者 | 倫理的な問題に迅速に対応するため、専門の担当者を置く。 |

| 倫理的な配慮 | AIが人々に不利益を与えないよう、倫理的な配慮を怠らない。例:差別、プライバシー侵害 |

| 多様な開発チーム | 多様な視点を取り入れ、公正で偏りのないAI開発を行う。倫理ガイドラインを定め、研修を実施。 |

| 責任ある体制 | 倫理的な側面を常に意識し、責任ある体制のもとでAIを開発。 |