倫理的なAI活用への成熟度モデル

AIの初心者

先生、「倫理的AI成熟度モデル」って、一体何ですか?難しそうです…

AI専門家

簡単に言うと、AIを使う上で、それが倫理的に問題ないか、人々に害を与えないかを確認するためのものです。 例えば、AIが人種や性別で差別的な判断をしていないか、個人の情報を勝手に漏らしていないかなどをチェックするための枠組みです。

AIの初心者

なるほど。でも、なぜそんなものが必要なんですか?AIは便利な道具なので、倫理とか気にしなくてもいいのでは?

AI専門家

確かにAIは便利ですが、使い方を間違えると、人に危害を加えたり、社会に悪影響を与える可能性があります。倫理的AI成熟度モデルは、そうした問題を防ぎ、AIを安全に正しく使うために必要なのです。

倫理的AI成熟度モデルとは。

人工知能を使う上での倫理的な問題について、組織がどのくらいきちんと対応できているかを測るための『倫理的な人工知能の成熟度モデル』という考え方があります。このモデルは、組織が人工知能技術を倫理的に使うための方法を評価し、改善するための枠組みを提供します。具体的には、組織の現状を評価し、より責任ある信頼できる人工知能の利用へと導くための道筋を示してくれます。このモデルは、透明性、公平性、データのプライバシー保護、説明責任、そして予測の偏りといった問題を扱っています。

はじめに

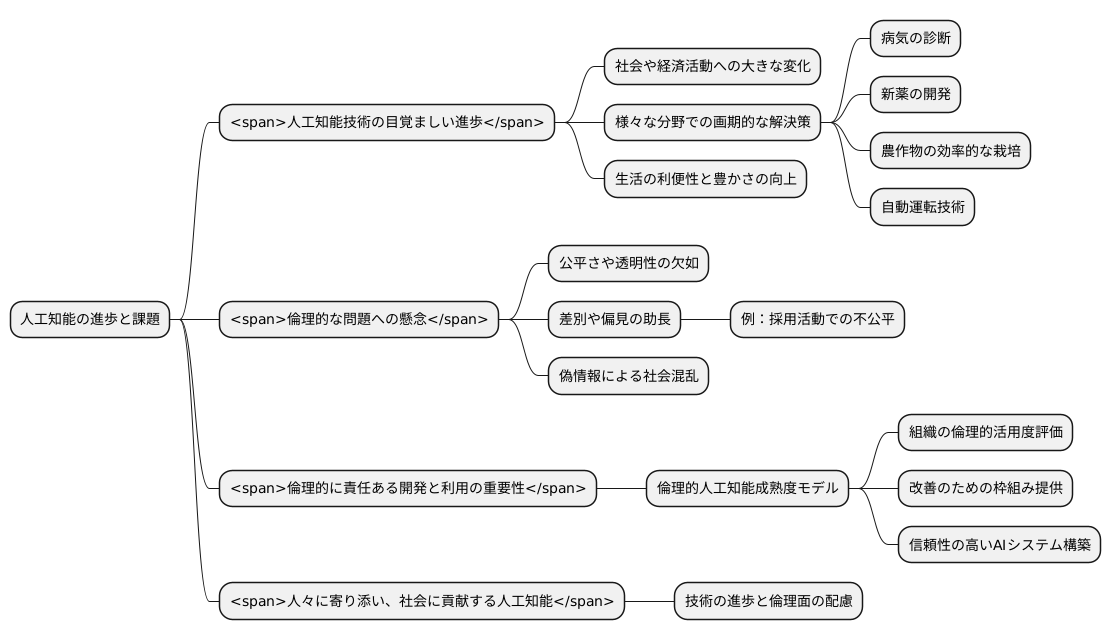

近頃、人工知能(じんこうちのう)という技術が、目覚ましい進歩を遂げています。この技術は、私たちの社会や経済活動に、大きな変化をもたらしています。様々な分野で、これまでになかった画期的な解決方法を提供してくれるのです。例えば、病気の診断や新薬の開発、農作物の効率的な栽培、そして自動運転技術など、私たちの生活をより便利で豊かにする可能性を秘めています。

しかし、それと同時に、倫理的な問題についても目を向けなければなりません。人工知能は、公平さや透明性を欠く場合があり、差別や偏見を助長してしまう可能性も懸念されています。例えば、採用活動において、人工知能が過去のデータに基づいて特定の属性を持つ人々を不利に扱ってしまうといった問題が考えられます。また、人工知能が生成した偽の情報が社会に混乱をもたらす危険性も指摘されています。

だからこそ、人工知能という技術を、倫理的に責任ある方法で開発し、導入し、利用していくことが、今、非常に重要になっています。倫理的な人工知能を実現するために、様々な取り組みが行われています。その一つが、「倫理的人工知能成熟度モデル」です。これは、組織が人工知能技術を倫理的に活用できているかを評価し、改善するための枠組みを提供するものです。このモデルは、組織が倫理的な人工知能の実践において、どの段階にあるのかを評価し、より責任ある信頼性の高い人工知能システムを構築するために、進むべき道を示してくれる羅針盤のような役割を果たします。目指すのは、人々に寄り添い、社会に貢献する人工知能です。そのためにも、技術の進歩だけでなく、倫理的な側面にもしっかりと配慮していく必要があると言えるでしょう。

モデルの構成要素

人工知能の倫理に関する成熟度を示すモデルは、一般的に段階的に構成されています。このモデルは、組織が人工知能の倫理に関して、どの程度まで理解し、実践しているかを測るためのものです。各段階は、組織における人工知能倫理への取り組みの成熟度を表しており、段階が上がるにつれて、より高いレベルの倫理的な実践が求められます。

最初の段階では、組織は人工知能倫理についてほとんど認識がなく、具体的な対策も何も行われていない状態です。いわば、人工知能倫理という概念自体が、組織内で認識されていない段階と言えます。この段階では、人工知能技術の活用に潜む倫理的な問題点について、組織全体で認識を深めることが重要になります。

次の段階に進むと、組織は人工知能倫理に関する問題点を認識し始め、基本的な対策を講じ始めます。例えば、倫理的な指針を作成したり、担当者を配置したりといった取り組みが行われます。しかし、これらの取り組みは限定的であり、組織全体への浸透は不十分な状態です。

さらに上の段階では、組織は人工知能倫理に関する指針を策定し、具体的な行動計画を立てて実行します。教育研修プログラムを実施することで、従業員の倫理意識向上を図るなど、組織全体で倫理的な人工知能開発に取り組む姿勢が見られます。また、人工知能システムの運用における透明性を高め、公平性を確保するための仕組みづくりも進められます。

そして、最も成熟した段階では、人工知能倫理は組織文化に深く根付いており、継続的な改善が行われています。倫理的な人工知能開発は、組織の重要な価値観として認識され、すべての意思決定に反映されます。また、外部の専門家との連携や、社会全体の動向を踏まえた見直しなどを通して、常に倫理基準の向上に努めています。

これらの各段階には、透明性、公平性、説明責任、情報の秘匿性、人間の管理といった重要な要素が含まれています。透明性とは、人工知能の意思決定過程を分かりやすく説明できることであり、公平性とは、偏見や差別のない公正な結果を生み出すことです。説明責任とは、人工知能の行動に対する責任を明確にすることであり、情報の秘匿性とは、個人情報などの機密情報を適切に管理することです。人間の管理とは、人工知能が人間の管理下で運用されるようにすることです。これらの要素は、人工知能システムが倫理的に問題がないかを評価するための重要な基準となります。

| 段階 | 説明 | 主な取り組み | 倫理的要素 |

|---|---|---|---|

| 第1段階 (認識なし) |

AI倫理についてほとんど認識がなく、対策もなし。 | AI倫理の概念の組織内での認識向上。 | 透明性、公平性、説明責任、情報の秘匿性、人間の管理 |

| 第2段階 (認識開始) |

AI倫理の問題点を認識し始め、基本的な対策を開始。 | 倫理指針の作成、担当者配置など。 | |

| 第3段階 (実践段階) |

AI倫理に関する指針を策定し、具体的な行動計画を実行。 | 教育研修、透明性・公平性の確保のための仕組みづくり。 | |

| 第4段階 (統合段階) |

AI倫理が組織文化に根付き、継続的な改善を実施。 | 倫理基準の向上、外部専門家との連携、社会全体の動向を踏まえた見直し。 |

透明性の確保

人工知能の仕組みを分かりやすく示すことは、使う人の信頼を得る上でとても大切です。また、気づかないうちに偏った判断をしていないかを見つけるためにも欠かせません。透明性とは、人工知能がどのように働き、どんな情報をもとに結論を出すのかを明らかにすることです。これは、人工知能の計算方法を分かりやすく説明できるだけでなく、情報の由来や使い方も公開することを意味します。透明性を高めることで、人工知能に対する信頼感を強め、責任ある使い方を促すことができます。

人工知能がどのように答えを導き出すのか、その道筋を示すことで、使う人は安心して利用できます。例えば、ある商品をおすすめする人工知能の場合、過去の購買履歴や閲覧履歴だけでなく、年齢や性別などの情報も加味して判断しているかもしれません。これらの情報がどのように使われ、最終的なおすすめにどう影響しているのかが分かれば、使う人は納得感を持って商品を選ぶことができます。また、もしおすすめが的外れだった場合でも、その理由を理解しやすくなります。

情報の由来を明らかにすることも重要です。人工知能は大量の情報を学習することで賢くなりますが、その情報の質が結果に大きく影響します。偏った情報で学習させた人工知能は、偏った判断を下す可能性があります。例えば、ある特定の地域の人々に関するネガティブな情報ばかりで学習させた人工知能は、その地域の人々に対して不当な評価を下してしまうかもしれません。情報の由来を公開することで、このような偏りを早期に発見し、修正することができます。

さらに、透明性を確保することは、問題発生時の対応をスムーズにします。人工知能が予期せぬ動作をした場合、その原因を特定し、適切な対策を講じる必要があります。もし人工知能の仕組みがブラックボックス化されていれば、原因究明に時間がかかり、対応が遅れる可能性があります。透明性を確保していれば、問題の原因を素早く特定し、修正することで、被害を最小限に抑えることができます。このように、人工知能の透明性を高めることは、信頼性の向上だけでなく、問題発生時の迅速な対応にもつながります。そのため、人工知能の開発や運用において、透明性を最優先に考えるべきです。

| 項目 | 説明 |

|---|---|

| 透明性の定義 | AIがどのように働き、どんな情報をもとに結論を出すのかを明らかにすること。計算方法の説明だけでなく、情報の由来や使い方も公開する。 |

| 透明性のメリット | AIへの信頼感向上、責任ある使い方の促進、納得感のある利用、問題発生時の迅速な対応 |

| 説明の具体例 | 商品推薦AIの場合、購買履歴、閲覧履歴、年齢、性別などの情報がどのように使われ、最終的なおすすめにどう影響しているのかを明らかにする。 |

| 情報の由来の重要性 | 情報の質が結果に大きく影響するため、偏った情報で学習すると偏った判断を下す可能性がある。由来を公開することで偏りを早期に発見・修正可能。 |

| 問題発生時の対応 | 透明性を確保していれば、原因を素早く特定し修正することで被害を最小限に抑えることが可能。 |

公平性の原則

人工知能は、誰に対しても分け隔てなく、偏った考え方を助長するようなことがあってはなりません。公平であるということは、人工知能が全ての人に等しく使われ、生まれ持った性質や育った環境などで異なる結果を生み出さないように作られ、動かされるということを意味します。

人工知能の学習に使う情報の偏りを正すことは、とても大切です。学習に使った情報に偏りがあると、人工知能も偏った判断をしてしまいます。ですから、人工知能を作る過程で、偏りのない情報を選び、偏った結果が出ないように注意深く調整していく必要があります。これは、まるで料理人が、様々な材料を吟味し、適切な味付けをして、美味しい料理を作るようなものです。人工知能を作る人々は、注意深く情報を吟味し、人工知能が正しい判断をできるように調整する必要があります。

また、人工知能が影響を与える人々の多様性を考えることも重要です。例えば、異なる年齢、性別、文化、生活習慣を持つ人々がいることを忘れてはいけません。様々な立場の人々の意見を聞き、多様な考え方を理解することで、より多くの人にとって公平な人工知能を作ることができます。これは、まるで街を作るようなものです。様々な人々が住みやすいように、色々な施設や設備を整える必要があります。人工知能も同様に、様々な人々が使いやすいように、多様な考え方を考慮して設計する必要があります。

公平性をしっかりと守ることで、人工知能は社会全体のためになるものとなり、誰もが同じようにチャンスを得られるようになります。人工知能が正しく使われれば、私たちの生活はより豊かで便利なものになるでしょう。しかし、公平性を無視すれば、一部の人々に不利益をもたらし、社会の格差を広げてしまうかもしれません。だからこそ、人工知能を作る人々は、常に公平性を念頭に置き、責任ある行動をとる必要があります。これは、未来を担う子供たちのために、より良い社会を作っていくための大切な責任です。

| 人工知能の公平性 | 具体的な行動 | 例え |

|---|---|---|

| 偏りのない人工知能 | 学習データの偏りを修正し、注意深く調整する | 様々な材料を吟味し、適切な味付けをする料理人 |

| 多様性への配慮 | 様々な立場の人々の意見を聞き、多様な考え方を理解する | 様々な人々が住みやすい街づくり |

| 公平性の重要性 | 常に公平性を念頭に置き、責任ある行動をとる | 未来を担う子供たちのためにより良い社会を作る |

責任の所在

人が作った考える機械を使う時の、責任の所在をはっきりさせることはとても大切です。これは、この機械を作る人、使う人、そしてその間に関わる全ての人が、自分の役割と責任をきちんと理解し、正しい行動をとることを意味します。

まず、この機械がどのように動くか、その責任は誰にあるのかをはっきりさせなければなりません。例えば、機械が何か問題を起こした場合、誰がどのように対応するのかを前もって決めておく必要があります。何かあった時にすぐに対処できる人がいることで、大きな問題になるのを防ぐことができます。また、この機械を使うかどうかを決める時の話し合いや、その決定の内容を記録に残しておくことも重要です。こうすることで、後からどのような経緯でその決定に至ったのかを確認することができます。

次に、この機械を使う上での決定は、全て記録に残し、追跡できるようにする必要があります。これは、問題が起きた時に原因を調べたり、責任の所在を明らかにしたりするのに役立ちます。誰が、いつ、どのような理由でこの機械を使ったのか、また、その結果どうなったのかが分かれば、問題の解決策を見つけやすくなります。さらに、このような記録を残すことは、この機械を使う人たちの行動をより注意深くさせ、責任感を持たせることにも繋がります。

責任の所在をはっきりさせることで、この機械を使うことに対する透明性と信頼性を高めることができます。つまり、この機械がどのように作られ、どのように使われているのかが誰にでも分かるようにすることで、人々の不安を取り除き、安心して使えるようにするのです。透明性が高ければ、問題が起きた時にも迅速に対応できますし、原因の究明も容易になります。このように、責任の所在をはっきりさせることは、この機械を安全に、そして効果的に使う上で非常に重要な要素となります。

| 項目 | 説明 |

|---|---|

| 責任所在の明確化 | AI開発、利用、関連者全員の役割と責任の理解と適切な行動 |

| AIの動作責任の明確化 | 問題発生時の対応策と担当者の事前決定、迅速な問題解決 |

| 意思決定プロセスの記録 | AI利用に関する議論、決定内容の記録、事後検証 |

| AI利用記録の追跡 | 問題発生時の原因究明、責任所在の明確化、解決策の発見 |

| 利用者の責任感向上 | 記録による行動の注意深化、責任感の醸成 |

| 透明性と信頼性の向上 | AI開発・利用の透明化、利用者の安心感向上、迅速な問題対応 |

データの保護

人工知能システムは、個人情報や企業秘密といった大切な情報を適切に守ることが求められます。昨今、様々な場面で人工知能が活用され、多くの情報を取り扱うため、情報の安全を守ることは非常に重要です。情報保護とは、個人情報や秘密情報が許可なく見られたり、使われたり、公開されたりすることを防ぐことを意味します。

人工知能システムは、学習や判断のために大量の情報を必要とします。そのため、情報の安全を確保するための対策をしっかりと行う必要があります。具体的には、情報を集める時、使う時、保管する時のそれぞれにおいて、適切な安全対策を講じる必要があります。例えば、情報を暗号化したり、アクセスできる人を制限したりするなど、様々な方法があります。

また、情報保護に関する法律や規則を守ることが不可欠です。法律や規則は、情報の安全を守るための最低限の基準を示しています。人工知能システムを開発・運用する者は、これらの基準を遵守し、責任ある行動をとる必要があります。

さらに、情報をどのような目的で使うのかを明確にし、情報提供者の同意を得ることも大切です。情報提供者は、自分の情報がどのように使われるのかを知る権利があり、同意なく利用されるべきではありません。利用目的を明確にし、同意を得ることで、情報提供者との信頼関係を築き、安心して情報を提供してもらえる環境を作ることができます。

情報保護を徹底することで、個人情報や企業秘密の流出や不正利用といった危険を減らし、社会全体の信頼を維持することに繋がります。人工知能システムの開発・運用において、情報保護は最も重要な要素の一つであり、常に意識して取り組む必要があります。

| 項目 | 説明 |

|---|---|

| 情報の保護の重要性 | AIシステムは多くの情報を取り扱うため、個人情報や企業秘密などを守る対策が必要。 |

| 情報保護の対策 | 情報の収集・利用・保管の各段階で適切な安全対策(暗号化、アクセス制限など)を実施。 |

| 法令遵守 | 情報保護に関する法律や規則を遵守し、最低限の基準を満たす。 |

| 利用目的の明示と同意 | 情報提供者に対し、利用目的を明確にし、同意を得る。 |

| 情報保護の成果 | 情報漏洩や不正利用のリスク軽減、社会全体の信頼維持。 |