AIを欺く攻撃:敵対的攻撃とは?

AIの初心者

先生、「敵対的な攻撃」ってどういう意味ですか?よくわからないです。

AI専門家

そうですね。「敵対的な攻撃」とは、人工知能をだますような悪意のある行為のことです。たとえば、人工知能が画像を見てそれが何かを判断する際に、人間にはわからないようなわずかな変化を加えた画像を見せることで、人工知能に間違った判断をさせるような攻撃です。

AIの初心者

人間の目にはわからないような変化で人工知能をだませるんですか?具体的にどんなことをするんですか?

AI専門家

例えば、パンダの画像にノイズと呼ばれる、人間には見えないくらい小さな点をたくさん加えます。すると、人工知能はパンダを他の動物だと誤認識してしまうことがあります。これが敵対的な攻撃の一例です。このように、人工知能の弱点をついた攻撃なんです。

敵対的な攻撃とは。

人工知能をだます攻撃について説明します。この攻撃は、人工知能の判断を狂わせることを狙った悪意のある行為です。具体的には、人工知能になりすましたり、システムの弱点を探して不正に侵入したりといった方法があります。このような攻撃を「敵対的な攻撃」と呼びます。

人工知能を狙う新たな脅威

私たちの暮らしの中に、まるで空気のように溶け込み始めた人工知能。自動車の自動運転や病気の診断など、様々な場面で活躍しています。しかし、便利な道具であると同時に、思いもよらない危険性も潜んでいるのです。その危険性のひとつが「敵対的な攻撃」です。これは、人工知能の判断能力を狂わせ、間違った動作をさせる悪意のある攻撃です。

人工知能は、大量の情報から学び、見つけた規則性を使って判断します。敵対的な攻撃は、この学習方法や規則性を見つける能力の弱点を突いてきます。例えば、画像を見分ける人工知能の場合を考えてみましょう。私たち人間には全くわからない程度の、ごく小さなノイズを画像に混ぜると、人工知能が全く違うものだと勘違いしてしまうことがあります。これは、自動運転システムで考えると、標識を間違えて認識し、事故につながる危険性があります。

もう少し具体的に説明すると、停止の標識に、人間には見えない模様を貼ることで、人工知能がそれを制限速度の標識だと誤認識してしまうのです。この結果、車は停止せずに進んでしまい、事故につながる可能性があります。また、医療診断の画像にノイズを混ぜることで、人工知能が病気を誤診する危険性も考えられます。このように敵対的な攻撃は、私たちの安全を脅かす可能性があるのです。

敵対的な攻撃は、人工知能の信頼性と安全性を揺るがす重大な問題です。そのため、人工知能を守るための対策が急がれています。人工知能の学習方法を改良したり、敵対的な攻撃を検知する技術を開発したりするなど、様々な対策が研究されています。人工知能が安全に使えるように、対策をより一層強化していく必要があるでしょう。

| 敵対的攻撃とは | 人工知能の判断能力を狂わせ、間違った動作をさせる悪意のある攻撃 |

|---|---|

| 攻撃方法 | 人工知能の学習方法や規則性を見つける能力の弱点を突く 例:画像に人間には見えないノイズを混ぜる |

| 具体例 |

|

| 影響 | 人工知能の信頼性と安全性を揺るがす |

| 対策 | 人工知能の学習方法の改良、敵対的攻撃検知技術の開発など |

見えない攻撃:その仕組み

巧妙に仕組まれた目に見えない攻撃は、人工知能の判断を狂わせる危険な罠です。まるで魔法のように、ほんの少しだけデータに手を加えることで、人工知能は本来とは全く異なる判断を下してしまうのです。

例えば、画像を考えてみましょう。人の目には全くわからない程度の、ごくわずかなノイズを加えるだけで、人工知能は画像に写っているものを全く別のものと認識してしまう可能性があります。これは、人間の視覚では認識できないほどの変化が、人工知能の認識システムには大きな影響を与えることを示しています。音声データの場合も同様です。人間には聞こえないほどのノイズを混入させることで、人工知能は音声を誤認識してしまうことがあります。また、文章データにおいては、特定の言葉を巧妙に置き換えることで、人工知能が文章の意味を全く違うものとして解釈してしまう可能性があります。

これらの攻撃は、人工知能の仕組みの弱点をつくように綿密に設計されています。人工知能は、大量のデータから学習し、そのデータに基づいて判断を行います。攻撃者は、人工知能の学習内容や判断基準を分析し、その弱点を突くようなデータ操作を行います。具体的には、画像認識の人工知能であれば、特定の画素の値をわずかに変更することで、画像全体の認識を誤らせることが可能です。

このような見えない攻撃は、特定の人工知能を狙ったものと、広範囲の人工知能に影響を与えるものの二種類に分けられます。特定の人工知能を狙った攻撃は、その人工知能の弱点を利用して、特定の動作をさせたり、誤動作させたりすることを目的としています。一方、広範囲の人工知能に影響を与える攻撃は、多くの種類の人工知能に共通する弱点を利用して、広範囲に混乱を引き起こすことを目的としています。どちらの攻撃も、人工知能の正常な動作を妨げ、深刻な問題を引き起こす可能性があります。人工知能の安全性を確保するためには、このような見えない攻撃への対策が不可欠です。

| 攻撃の種類 | 対象 | 目的 | 例 |

|---|---|---|---|

| 特定の人工知能を狙った攻撃 | 特定の人工知能の弱点 | 特定の動作・誤動作 | 特定の画素値の変更 |

| 広範囲の人工知能に影響を与える攻撃 | 多くの種類の人工知能に共通する弱点 | 広範囲の混乱 | – |

攻撃の種類と目的

人工知能を狙った攻撃は、その狙いややり方によって様々な種類に分けられます。まず、人工知能の判断を狂わせる攻撃です。例えば、画像認識の人工知能に猫の画像を見せて犬と誤認識させるといった具合です。これは、人工知能の分類機能を狂わせる「誤分類攻撃」と呼ばれます。

次に、人工知能に特定の行動をさせる攻撃があります。これは「標的型攻撃」と呼ばれ、例えば、迷惑メールの判別をする人工知能に特定のメールを「安全」と判断させ、受信箱に届くように仕向けるといったものです。特定の動作をさせることで、システム全体を混乱させる狙いがあります。

さらに、攻撃を隠す攻撃もあります。これは「隠蔽攻撃」と呼ばれ、人工知能が攻撃を検知できないように巧妙に偽装する高度な技術です。まるで忍者が敵に見つからないように行動するかのようです。

これらの攻撃は、システムへの不正侵入や情報の盗み取り、サービスの妨害など、様々な悪意ある目的に利用される恐れがあります。例えば、顔認証システムを騙して他人のふりをして侵入したり、迷惑メールフィルターをすり抜けて大量の迷惑メールを送信したり、自動運転システムを操作して事故を起こしたりするなど、その影響は広範囲に及びます。

また、これらの攻撃は単独で行われるとは限りません。複数の攻撃を組み合わせて行うことで、より大きな被害をもたらす可能性があります。例えば、隠蔽攻撃で人工知能の監視をすり抜けながら、標的型攻撃でシステムを特定の動作に誘導するといった具合です。このように、人工知能を狙った攻撃は複雑化・巧妙化しており、その脅威は深刻さを増しています。そのため、人工知能の安全性を高める対策が急務となっています。

| 攻撃の種類 | 説明 | 例 |

|---|---|---|

| 誤分類攻撃 | 人工知能の判断を狂わせる攻撃。人工知能の分類機能を狂わせる。 | 画像認識AIに猫の画像を見せて犬と誤認識させる。 |

| 標的型攻撃 | 人工知能に特定の行動をさせる攻撃。システム全体を混乱させる狙いがある。 | 迷惑メールの判別AIに特定のメールを「安全」と判断させ、受信箱に届くように仕向ける。 |

| 隠蔽攻撃 | 攻撃を隠す攻撃。人工知能が攻撃を検知できないように巧妙に偽装する。 | (具体的な例は示されていないが、AIによる検知を回避する高度な技術) |

対策と課題:安全なAI実現に向けて

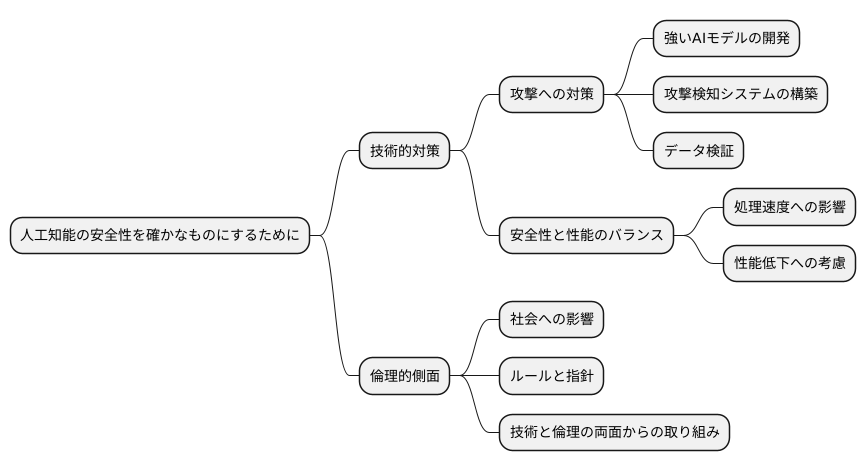

人工知能の安全性を確かなものにするためには、様々な課題を乗り越え、対策を講じていく必要があります。昨今では、悪意ある攻撃から人工知能を守るための研究開発が盛んに行われています。具体的には、攻撃の影響を受けにくい強い人工知能モデルの開発や、攻撃をいち早く見つける検知システムの構築、人工知能に入力されるデータの正しさを確かめる検証作業などが挙げられます。

しかし、これらの対策を講じても、人工知能への攻撃手法も常に進化を続けているため、完璧な防御策を作ることは容易ではありません。攻撃者は、まるで盾と矛の戦いのごとく、常に新たな弱点を探し求めており、防御側も絶えず対応を迫られています。この状況は、まるでいたちごっこであり、人工知能の安全性を保つことは、終わりなき挑戦と言えるでしょう。

また、安全対策を実際に導入する際には、処理速度や性能への影響も無視できません。例えば、安全性を高めるための処理を追加すると、計算に時間がかかったり、本来の性能が低下する可能性があります。そのため、安全性と性能のバランスをうまくとれた対策が求められます。限られた資源の中で、どこに重点を置くか、慎重な判断が必要です。

人工知能の安全性を確保するためには、技術的な対策だけでなく、倫理的な側面も考慮に入れなければなりません。人工知能が社会に与える影響を正しく理解し、人々の生活を豊かにするために、どのようなルールや指針が必要なのかを考え、技術と倫理の両面から包括的な取り組みを進めることが重要です。人工知能は、私たちの生活を大きく変える可能性を秘めていますが、その力を正しく使うためには、継続的な努力と責任ある行動が求められます。

私たちの未来を守るために

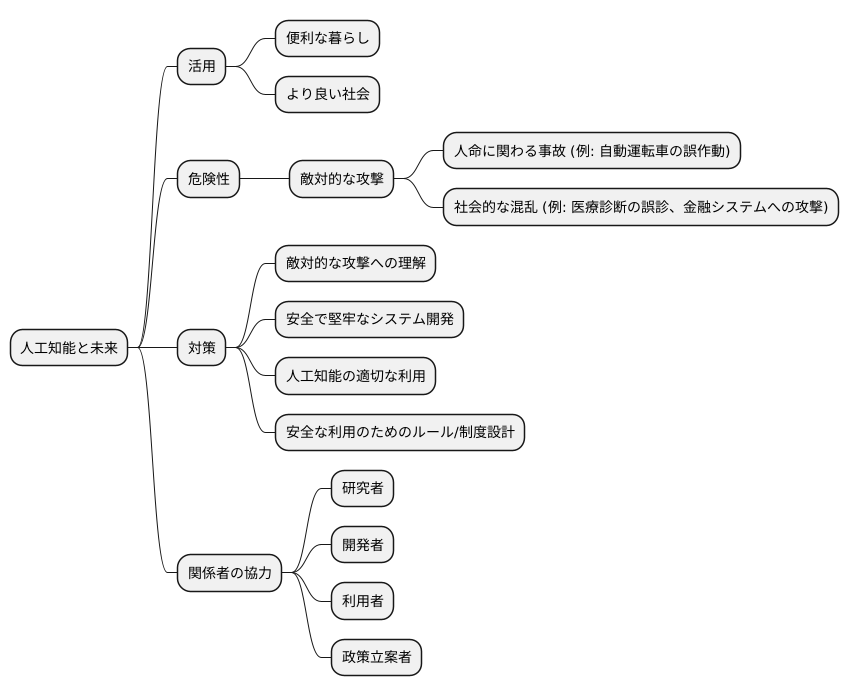

私たちの未来は、人工知能技術と切っても切り離せない関係になりつつあります。便利な暮らしやより良い社会の実現に向けて、人工知能は様々な場面で活用が進んでいます。しかし、その進歩の裏には、予期せぬ危険も潜んでいます。人工知能に対する悪意ある攻撃、いわゆる敵対的な攻撃は、その危険の一つであり、深刻な問題となる可能性があります。

人工知能は、自動運転や医療診断、金融取引など、私たちの生活に密着した分野で既に利用が始まっています。もし、これらのシステムが敵対的な攻撃を受け、誤作動を起こした場合、人命に関わる事故や社会的な混乱を引き起こす可能性も否定できません。例えば、自動運転車が誤った認識をして事故を起こしたり、医療診断システムが誤診をしたりする危険性も考えられます。また、金融システムが攻撃されれば、経済的な損失だけでなく、社会全体の信用を失墜させることにもなりかねません。

こうした事態を防ぐためには、敵対的な攻撃に対する理解を深め、適切な対策を講じることが不可欠です。人工知能の研究者や開発者は、より安全で堅牢なシステムの開発に努める必要があります。また、利用者は、人工知能の特性や潜在的なリスクを理解し、適切な使い方をする必要があります。さらに、政策立案者は、人工知能の安全な利用を促進するためのルール作りや制度設計を進める必要があります。

人工知能技術は、私たちに多くの恩恵をもたらす可能性を秘めていますが、その恩恵を最大限に享受するためには、潜在的なリスクにも目を向け、適切な対策を講じる必要があります。研究者、開発者、利用者、政策立案者など、あらゆる関係者が協力し、人工知能の安全性を高めるための努力を継続していくことが、私たちの未来を守ることに繋がります。